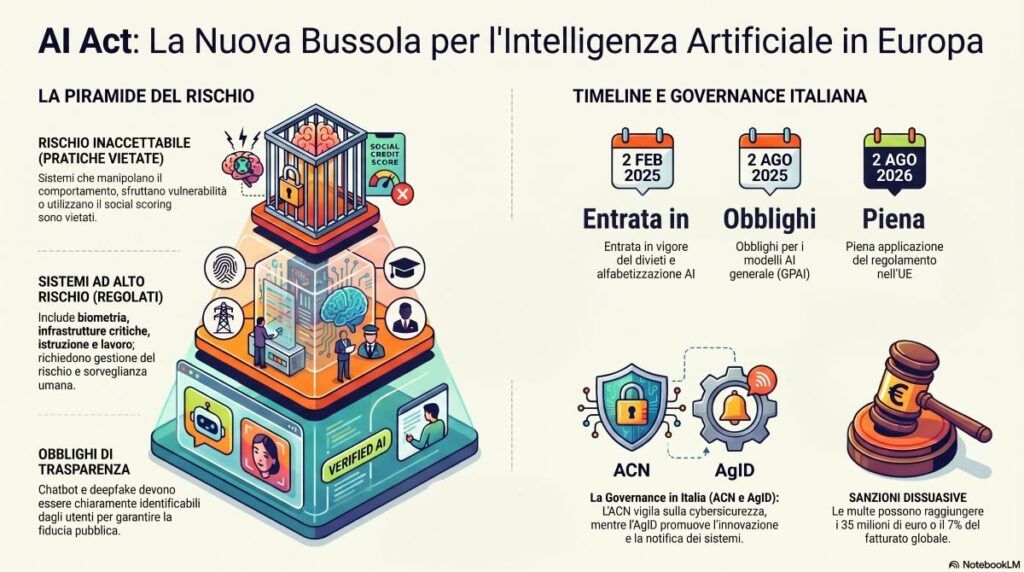

L’AI Act è il regolamento europeo che trasforma l’intelligenza artificiale da tecnologia regolata solo indirettamente attraverso privacy, sicurezza, responsabilità civile o diritto dei consumatori a infrastruttura sottoposta a un quadro giuridico specifico. Non è una norma contro l’AI e non è una semplice legge sui chatbot. È il primo grande tentativo dell’Unione Europea di fissare regole comuni per sistemi di intelligenza artificiale, modelli generali, applicazioni ad alto rischio, trasparenza dei contenuti generati e governance pubblica del mercato. Il testo alla base del percorso legislativo europeo, incluso nel documento parlamentare trasmesso da Matrice Digitale, definisce l’obiettivo del regolamento come la creazione di un quadro uniforme per sviluppo, immissione sul mercato, messa in servizio e uso dei sistemi AI nell’Unione, nel rispetto dei valori europei, della salute, della sicurezza, dei diritti fondamentali, della democrazia, dello Stato di diritto e della tutela ambientale. Il regolamento punta allo stesso tempo a sostenere innovazione e libera circolazione dei servizi AI nel mercato interno. Il punto decisivo è il metodo: l’AI Act non regola tutta l’intelligenza artificiale allo stesso modo, ma costruisce una classificazione basata sul rischio. Alcuni usi sono vietati perché incompatibili con diritti fondamentali e dignità della persona. Altri sono considerati ad alto rischio e devono rispettare requisiti tecnici, documentali e organizzativi. Altri ancora sono soggetti a obblighi di trasparenza. La maggior parte degli usi a rischio minimo resta fuori da obblighi pesanti, pur potendo aderire a codici volontari. Il regolamento è entrato in vigore il 1 agosto 2024. La Commissione europea ricorda che l’applicazione è progressiva: le pratiche vietate e gli obblighi di alfabetizzazione AI sono applicabili dal 2 febbraio 2025, le regole di governance e gli obblighi sui modelli di AI generale sono applicabili dal 2 agosto 2025, mentre il quadro generale diventa pienamente applicabile dal 2 agosto 2026, con alcune eccezioni e con possibili modifiche legate al pacchetto Digital Omnibus.

Per un’impresa, una pubblica amministrazione, una piattaforma, uno sviluppatore o un ente che usa sistemi AI, questo significa una cosa concreta: non basta più chiedersi se l’intelligenza artificiale funzioni, ma bisogna dimostrare come funziona, a cosa serve, quali rischi genera, chi la controlla e quali diritti può incidere.

Cosa leggere

Il principio del rischio: dalla libertà d’uso al controllo proporzionato

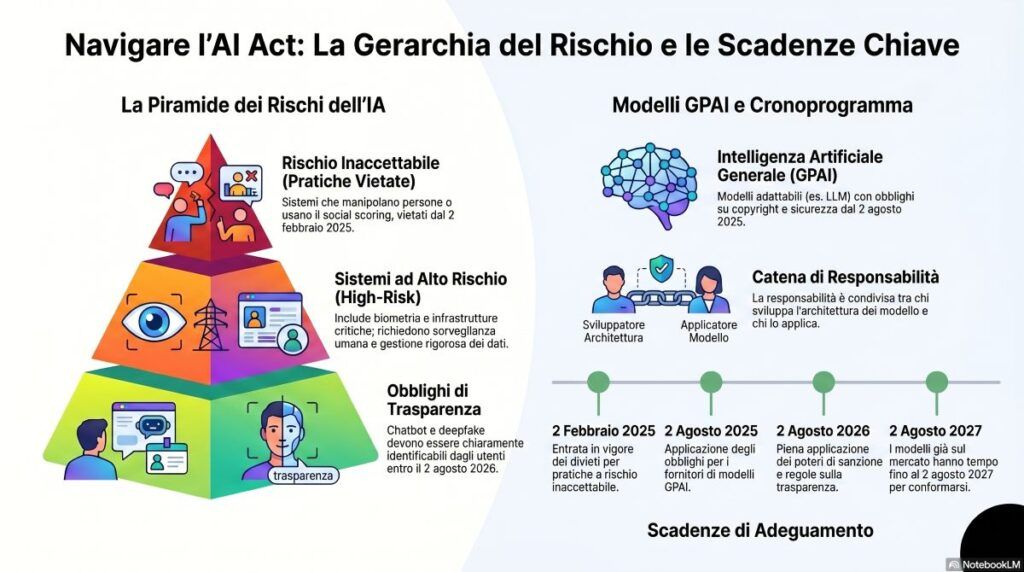

L’AI Act si fonda su un approccio proporzionato. L’Unione Europea non vieta l’intelligenza artificiale e non blocca l’innovazione, ma distingue gli usi in base al potenziale impatto su persone, sicurezza, diritti e società. Questa impostazione serve a evitare due errori opposti: lasciare ogni sistema AI privo di controllo oppure applicare gli stessi obblighi a un filtro antispam, a un chatbot aziendale e a un sistema usato per selezionare candidati al lavoro.

Pratiche vietate

La prima fascia è quella del rischio inaccettabile. Rientrano qui sistemi considerati incompatibili con i valori europei, perché possono manipolare le persone, sfruttare vulnerabilità, introdurre forme di social scoring o usare alcune tecniche biometriche in modo lesivo. Le pratiche vietate sono entrate in applicazione dal 2 febbraio 2025, insieme agli obblighi di alfabetizzazione sull’AI. Questa parte del regolamento ha una funzione politica prima ancora che tecnica. L’Europa stabilisce che alcuni usi dell’intelligenza artificiale non sono negoziabili: non basta renderli efficienti, trasparenti o economicamente convenienti. Se un sistema viola dignità, libertà, autodeterminazione o diritti fondamentali in modo strutturale, non deve arrivare sul mercato.

Sistemi ad alto rischio

La seconda fascia è quella dei sistemi high-risk. La Commissione spiega che un sistema AI può essere considerato ad alto rischio quando è componente di sicurezza di prodotti regolati dalla normativa europea oppure quando rientra in casi d’uso sensibili elencati nell’Annex III, tra cui biometria, infrastrutture critiche, istruzione, occupazione, accesso a servizi essenziali, law enforcement, migrazione, asilo, controllo delle frontiere e amministrazione della giustizia. Per questi sistemi non basta una generica informativa. Servono gestione del rischio, qualità dei dati, documentazione tecnica, tracciabilità, logging, trasparenza, sorveglianza umana, accuratezza, robustezza, cybersicurezza, valutazione di conformità e monitoraggio lungo il ciclo di vita. L’AI Act usa una logica simile alla sicurezza di prodotto: se un sistema può incidere su salute, sicurezza o diritti, deve essere progettato e controllato come tecnologia critica.

Rischio di trasparenza

La terza fascia riguarda sistemi che non sono necessariamente ad alto rischio, ma devono informare l’utente. È il caso di chatbot, sistemi che interagiscono con persone, contenuti sintetici, deepfake e generazione artificiale di testi, immagini, audio o video in specifici contesti. Le regole di trasparenza dell’articolo 50 sono previste dal 2 agosto 2026 e la Commissione ha avviato lavori su codici e linee guida per chiarire marcatura, etichettatura e rilevabilità dei contenuti generati o manipolati con AI. Questa è una delle aree più importanti per giornalismo, piattaforme, editori, creator, pubblicità, politica e sicurezza informativa. Sapere se un contenuto è generato o manipolato da AI diventa parte della fiducia pubblica, soprattutto quando immagini, video, audio e testi sintetici possono simulare persone reali, creare disinformazione o alterare processi democratici.

GPAI: i modelli di intelligenza artificiale generale

Una delle parti più delicate dell’AI Act riguarda i general-purpose AI models, o GPAI, cioè modelli di intelligenza artificiale generale capaci di essere adattati a molteplici usi. Qui rientrano i grandi modelli linguistici e multimodali che alimentano chatbot, agenti, strumenti di coding, motori generativi, assistenti enterprise e funzioni integrate nei software. Dal 2 agosto 2025 sono entrati in applicazione gli obblighi per i provider di modelli GPAI. La Commissione europea ha pubblicato il General-Purpose AI Code of Practice il 10 luglio 2025, articolato in tre capitoli: trasparenza, copyright, sicurezza e security. Il codice è volontario, ma Commissione e AI Board lo hanno riconosciuto come strumento adeguato per dimostrare conformità agli obblighi dell’AI Act.

Trasparenza, copyright e sicurezza dei modelli

Il capitolo sulla trasparenza offre un modello di documentazione per rendere più chiari sviluppo, capacità, limiti e informazioni rilevanti sul modello. Il capitolo sul copyright aiuta i provider a costruire una policy conforme al diritto UE, tema centrale per addestramento su contenuti protetti, text and data mining e riserve dei titolari dei diritti. Il capitolo su safety e security riguarda invece soprattutto i modelli più avanzati, quelli con rischio sistemico, e introduce pratiche di gestione del rischio, valutazione, mitigazione e monitoraggio. Le linee guida per i provider GPAI chiariscono inoltre che dal 2 agosto 2026 entrano in applicazione i poteri di enforcement della Commissione sui modelli di AI generale, incluse eventuali sanzioni, mentre i modelli già immessi sul mercato prima del 2 agosto 2025 devono adeguarsi entro il 2 agosto 2027. Questa parte è fondamentale perché sposta la responsabilità a monte. Chi sviluppa un modello generale non può limitarsi a dire che la responsabilità ricade solo su chi lo usa. L’AI Act costruisce una catena di obblighi tra provider del modello, provider del sistema AI e deployer finale, proprio perché i rischi possono nascere sia dall’architettura del modello sia dall’uso concreto nel contesto applicativo.

AI generativa, deepfake e contenuti sintetici

L’AI Act entra in modo diretto nel territorio dei contenuti generati artificialmente. Dal 2026, chi interagisce con un sistema AI o viene esposto a determinati contenuti generati o manipolati dovrà poterlo sapere. La Commissione ha aperto nel 2026 una consultazione sulle linee guida relative agli obblighi di trasparenza, ricordando che dal 2 agosto 2026 le persone nell’Unione dovranno essere informate quando interagiscono con sistemi AI o sono esposte a determinati contenuti generati o manipolati artificialmente. Questa parte riguarda direttamente giornalismo, social network, pubblicità politica, creator economy, piattaforme video, audio sintetico, immagini generate, avatar digitali, assistenti vocali e deepfake. Il problema non è soltanto etichettare un’immagine AI. Il vero nodo è impedire che l’intelligenza artificiale diventi uno strumento di falsificazione massiva, frode, manipolazione reputazionale e abuso sessuale digitale. Il tema è diventato ancora più forte con l’accordo provvisorio del 7 maggio 2026 tra Parlamento e Consiglio nell’ambito del Digital Omnibus AI. I co-legislatori hanno concordato nuove misure, non ancora formalmente adottate alla data della fonte, che includono il divieto di sistemi AI destinati a creare materiale di abuso sessuale su minori o contenuti intimi e sessualmente espliciti di persone identificabili senza consenso. Il Parlamento europeo indica anche una nuova scadenza al 2 dicembre 2026 per gli obblighi di watermarking sui contenuti AI-generated.

Questo passaggio è cruciale perché collega AI Act, sicurezza dei minori, deepfake sessuali, CSAM sintetico e responsabilità delle piattaforme. L’AI generativa non viene più trattata solo come strumento creativo, ma come tecnologia che può produrre danni immediati su dignità, identità, reputazione e sicurezza personale.

Le ultime integrazioni: Digital Omnibus, rinvii e divieto sui nudifier

Il quadro dell’AI Act non è statico. Nel novembre 2025 la Commissione ha presentato il Digital Omnibus on AI Regulation Proposal, un pacchetto di semplificazione pensato per rendere più fluida e proporzionata l’attuazione di alcune disposizioni del regolamento. La Commissione descrive la proposta come un insieme di misure mirate per garantire applicazione tempestiva, ordinata e proporzionata delle regole AI. Il 7 maggio 2026, Consiglio e Parlamento hanno raggiunto un accordo provvisorio sulle misure di semplificazione. Il Consiglio segnala che l’accordo prevede un calendario fisso per il rinvio delle regole high-risk: 2 dicembre 2027 per i sistemi AI high-risk stand-alone e 2 agosto 2028 per i sistemi AI high-risk incorporati in prodotti. La stessa intesa prevede il rinvio delle sandbox regolatorie nazionali al 2 agosto 2027, la riduzione a tre mesi del periodo di grazia per implementare soluzioni di trasparenza sui contenuti artificiali, con nuova scadenza al 2 dicembre 2026, e chiarimenti sulle competenze dell’AI Office per sistemi basati su modelli GPAI. La precisazione è essenziale: si tratta di un accordo provvisorio, che deve essere formalmente adottato da Parlamento e Consiglio prima di diventare diritto vincolante. Fino a quel momento, il quadro originario dell’AI Act resta il riferimento formale, ma le imprese devono già considerare che la traiettoria regolatoria europea si sta muovendo verso un equilibrio tra semplificazione, certezza giuridica e nuovi divieti su usi particolarmente dannosi.

Questa evoluzione conferma una tendenza: l’Europa non sta abbandonando l’AI Act, ma lo sta adattando mentre entra nella fase di applicazione reale. La pressione delle imprese, il ritardo degli standard, la difficoltà delle autorità nazionali e l’esplosione dell’AI generativa stanno costringendo il legislatore europeo a una regolazione più dinamica.

Il contesto italiano: Legge 132/2025, ACN e AgID

L’Italia ha costruito una propria cornice nazionale con la Legge 23 settembre 2025, n. 132, “Disposizioni e deleghe al Governo in materia di intelligenza artificiale”. Il fascicolo ufficiale del Senato indica che il testo è stato approvato definitivamente il 17 settembre 2025, diventando legge n. 132/2025, pubblicata nella Gazzetta Ufficiale n. 223 del 25 settembre 2025, con rettifica nella Gazzetta Ufficiale n. 242 del 17 ottobre 2025. La legge italiana non sostituisce l’AI Act europeo, ma lo affianca. L’articolo 1 stabilisce principi in materia di ricerca, sperimentazione, sviluppo, adozione e applicazione di sistemi e modelli di intelligenza artificiale, promuovendo un uso corretto e responsabile della tecnologia. Il Senato della Repubblica descrive il provvedimento come base normativa nazionale armonizzata con il regolamento europeo, con l’obiettivo di mantenere al centro l’uomo e i diritti fondamentali.

ACN e AgID: una governance duale

Il punto più rilevante per l’applicazione italiana è la designazione di AgID e ACN come Autorità nazionali per l’intelligenza artificiale. La legge attribuisce all’Agenzia per l’Italia Digitale un ruolo legato a promozione dell’innovazione, sviluppo dell’AI e funzioni di notifica, mentre l’Agenzia per la Cybersicurezza Nazionale assume un ruolo centrale nella vigilanza, incluse attività ispettive e sanzionatorie, oltre alla promozione dell’intelligenza artificiale per i profili di cybersicurezza. La cornice nazionale mantiene inoltre il ruolo di Banca d’Italia, Consob e IVASS come autorità di vigilanza del mercato nei rispettivi settori, secondo il regolamento europeo. Questa scelta italiana è politicamente e tecnicamente importante. L’AI non viene collocata solo dentro l’amministrazione digitale, ma anche dentro la cybersicurezza nazionale. L’Italia tratta l’intelligenza artificiale come tecnologia di innovazione, ma anche come superficie di rischio cyber, industriale e strategico. Su Matrice Digitale, questo punto si collega direttamente all’inchiesta sulle Linee guida AgID per l’IA nella Pubblica Amministrazione, dove il nodo non è soltanto adottare strumenti AI, ma evitare lock-in, opacità, dipendenza da piattaforme esterne e perdita di sovranità digitale.

Sanità, lavoro, PA e dati di addestramento

La legge italiana dedica attenzione anche a settori sensibili come sanità, disabilità, pubblica amministrazione, lavoro, professioni intellettuali, diritto d’autore e addestramento dei sistemi AI. Il fascicolo del Senato richiama, tra gli altri, l’uso dell’intelligenza artificiale in sanità per prevenzione, diagnosi e cura delle malattie, nel rispetto dei diritti, delle libertà, degli interessi della persona e della protezione dei dati personali. Un altro punto importante è la delega al Governo in materia di dati, algoritmi e metodi matematici per l’addestramento dei sistemi AI, da esercitare entro dodici mesi dall’entrata in vigore della legge. È un passaggio rilevante perché l’addestramento dei modelli è il vero luogo in cui si incontrano copyright, dati personali, bias, qualità dei dataset, sicurezza e competitività industriale. Nel contesto italiano, questo tema si lega anche al dibattito su lavoro e trasformazione professionale analizzato da Matrice Digitale in Lavoro e intelligenza artificiale: la trasformazione non sarà neutrale. I sistemi AI usati in occupazione, selezione, valutazione e gestione dei lavoratori rientrano tra le aree più sensibili dell’AI Act, perché possono incidere su accesso al lavoro, discriminazione, salario, carriera e controllo organizzativo.

AI Act, GDPR, DSA, DMA, NIS2 e DORA: la compliance non è più separata

L’AI Act non vive da solo. Si inserisce dentro un ecosistema normativo europeo già denso: GDPR, Digital Services Act, Digital Markets Act, Data Act, NIS2, DORA, Cyber Resilience Act e normative settoriali. Un sistema AI può trattare dati personali, generare contenuti, essere distribuito da una piattaforma, essere integrato in un prodotto regolato, incidere su infrastrutture critiche o essere usato da un soggetto finanziario. Il GDPR resta centrale quando l’AI tratta dati personali. L’AI Act non sostituisce obblighi su base giuridica, informativa, minimizzazione, diritti degli interessati, DPIA, data breach o trasferimenti internazionali. Per questo la guida di Matrice Digitale su GDPR e protezione dei dati personali è un collegamento naturale: un sistema AI può essere conforme all’AI Act ma violare il GDPR se usa dati personali senza base giuridica o con trasparenza insufficiente. Il DSA entra in gioco quando l’intelligenza artificiale incide su piattaforme online, moderazione, pubblicità, sistemi di raccomandazione, contenuti illegali, minori e deepfake. La guida su Digital Services Act aiuta a leggere il rapporto tra AI generativa, contenuti sintetici e responsabilità delle piattaforme. Il DMA rileva quando assistenti AI, motori di ricerca, app store, sistemi operativi e piattaforme gatekeeper possono chiudere o aprire mercati. La guida su Digital Markets Act è utile per capire perché l’AI diventa anche un tema di concorrenza: un assistente integrato in un ecosistema dominante può scegliere quali servizi mostrare, quali app favorire e quali dati usare. NIS2 e DORA diventano importanti quando i sistemi AI entrano in infrastrutture essenziali, servizi digitali critici, finanza, supply chain ICT e gestione del rischio. Gli approfondimenti su Cloud Security e Cloud Computing completano il quadro, perché l’AI moderna vive su cloud, API, modelli remoti, identity management, logging e infrastrutture distribuite.

La compliance AI non è quindi una casella normativa separata. È una governance integrata tra dati, sicurezza, piattaforme, lavoro, copyright, cloud, contratti e diritti fondamentali.

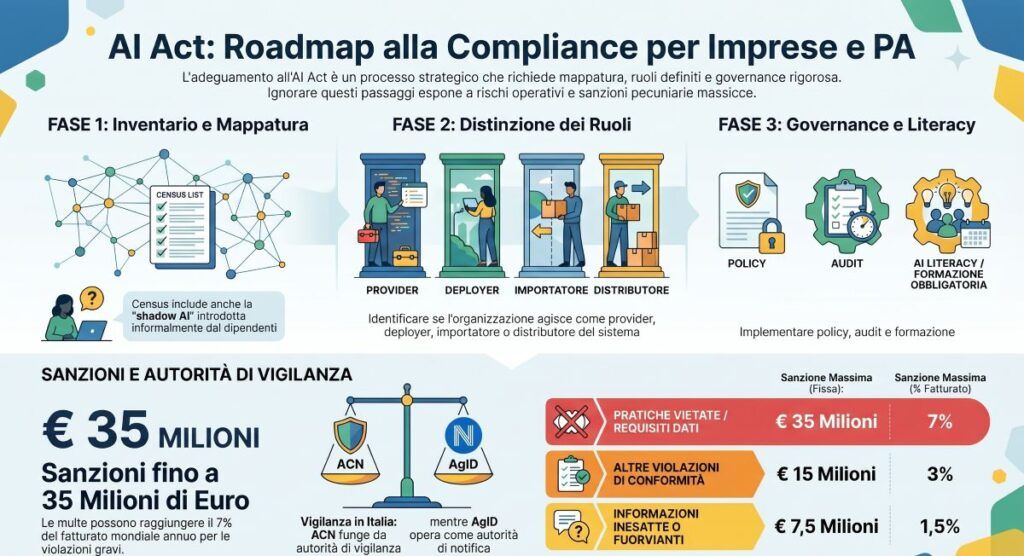

Imprese e pubbliche amministrazioni: cosa devono fare davvero

Per un’azienda o una pubblica amministrazione, prepararsi all’AI Act non significa aspettare la scadenza formale. Significa mappare subito i sistemi AI già in uso, inclusi quelli introdotti informalmente dai dipendenti. La cosiddetta shadow AI può esporre dati sensibili, generare output non verificati, introdurre bias, violare policy interne e creare problemi di conformità rispetto ad AI Act, GDPR, NIS2, DORA o norme settoriali, come evidenziato nella guida di Matrice Digitale su come funzionano gli LLM, i rischi e l’AI Act europeo. La prima fase è inventariare. Bisogna sapere quali sistemi AI vengono usati, da chi, per quale finalità, con quali dati, tramite quali fornitori e con quali effetti sulle persone. Senza inventario, non esiste classificazione del rischio. Senza classificazione, non esiste compliance. La seconda fase è distinguere i ruoli. Un’organizzazione può essere provider, deployer, importatore, distributore o utilizzatore professionale di un sistema AI. La stessa impresa può essere deployer quando usa un sistema esterno e provider quando sviluppa un proprio modello o integra AI in un prodotto offerto a clienti. La responsabilità segue il controllo effettivo sul sistema, sui dati, sul fine e sulle modifiche apportate.

La terza fase è costruire governance. Servono policy interne, formazione, procedure di approvazione, valutazioni di impatto, controllo umano, gestione dei fornitori, clausole contrattuali, audit, logging, sicurezza, gestione incidenti e revisione periodica degli output. Gli obblighi di AI literacy, già applicabili dal 2 febbraio 2025, impongono alle organizzazioni di assicurare un livello sufficiente di competenza AI a personale e soggetti coinvolti, anche se la supervisione effettiva delle autorità nazionali partirà dal 2 agosto 2026.

Sanzioni e enforcement

L’AI Act prevede un sistema sanzionatorio rilevante. La Commissione europea indica soglie fino a 35 milioni di euro o 7% del fatturato mondiale annuo per violazioni relative a pratiche vietate o non conformità su specifici requisiti sui dati, fino a 15 milioni di euro o 3% del fatturato mondiale annuo per altre violazioni, e fino a 7,5 milioni di euro o 1,5% per informazioni inesatte, incomplete o fuorvianti fornite agli organismi notificati o alle autorità. Per le PMI si applica la soglia più bassa tra importo fisso e percentuale, mentre per le altre imprese vale la soglia più alta. L’enforcement è strutturato su due livelli. Le autorità nazionali controllano i sistemi AI, mentre l’AI Office della Commissione governa e applica gli obblighi relativi ai provider di modelli GPAI e ad alcuni sistemi basati su tali modelli. L’AI Board, composto da rappresentanti degli Stati membri, serve a coordinare l’applicazione uniforme del regolamento nell’Unione. Nel caso italiano, questa architettura si traduce nel ruolo di ACN come autorità di vigilanza del mercato e punto di contatto unico con le istituzioni europee, e di AgID come autorità di notifica, secondo la ripartizione stabilita dalla legge nazionale.

AI Act e mercato: tra sovranità digitale e rischio burocratico

Il grande nodo politico dell’AI Act è l’equilibrio tra protezione e competitività. L’Europa vuole evitare un mercato dominato da sistemi opachi, discriminatori, manipolativi o pericolosi. Allo stesso tempo, deve evitare che il regolamento diventi un freno sproporzionato per imprese, startup, PMI, ricerca e pubbliche amministrazioni. Per questo la Commissione ha affiancato all’AI Act una strategia industriale più ampia. L’AI Continent Action Plan, pubblicato il 9 aprile 2025, punta a fare dell’Europa un continente leader nell’intelligenza artificiale, mentre la Apply AI Strategy, lanciata nell’ottobre 2025, mira ad aumentare adozione e integrazione dell’AI nei settori industriali e pubblici, con attenzione specifica a PMI e sovranità tecnologica. Questa è la tensione vera. Regolare l’AI senza costruire infrastruttura, cloud, chip, competenze, dati e imprese europee rischia di produrre solo compliance su tecnologia importata. L’AI Act può diventare una leva di fiducia e mercato unico, ma solo se accompagnato da investimenti, standard chiari, sandbox, supporto alle PMI e capacità pubblica di applicare le regole senza trasformarle in burocrazia cieca. Su questo piano, gli articoli di Matrice Digitale su Google Gemini e AI agentica, Private AI Compute di Google e Google Cloud, agenti AI e sicurezza mostrano il problema concreto: l’AI regolata in Europa si sviluppa spesso su infrastrutture e piattaforme controllate da grandi operatori globali.

AI Act e informazione: perché riguarda anche giornalismo, deepfake e piattaforme

Per il giornalismo digitale, l’AI Act è rilevante almeno su tre piani. Il primo riguarda i contenuti generati. Testi, immagini, audio e video sintetici possono alterare la fiducia pubblica, generare falsi, amplificare propaganda, produrre deepfake e danneggiare reputazioni. Gli obblighi di trasparenza e watermarking diventano quindi strumenti essenziali per distinguere contenuti artificiali, manipolazioni e comunicazioni autentiche. Il secondo piano riguarda le piattaforme. Se l’AI entra nei sistemi di raccomandazione, moderazione, indicizzazione e pubblicità, il confine con DSA e DMA diventa inevitabile. L’AI non produce solo contenuti, ma decide quali contenuti vengono mostrati, quali vengono ridotti, quali vengono classificati come rischiosi e quali diventano monetizzabili.

Il terzo piano riguarda il potere degli assistenti AI. Quando un modello risponde al posto di un motore di ricerca, sintetizza fonti e trattiene l’utente nella piattaforma, cambia il rapporto tra editori e pubblico. L’AI Act non risolve da solo questo problema, ma offre un pezzo della cornice: trasparenza, responsabilità, tracciabilità e controllo dei sistemi. Il caso italiano del Garante Privacy e OpenAI, seguito da Matrice Digitale in Flop su ChatGPT, verbali fantasma e registrazioni distrutte, mostra quanto sia fragile il passaggio tra regolazione ambiziosa e tenuta giuridica degli atti. L’annullamento della sanzione da 15 milioni di euro a OpenAI da parte del Tribunale di Roma, riportato nell’articolo, è un promemoria: regolare l’AI richiede autorità solide, istruttorie robuste e atti capaci di resistere davanti ai giudici.

AI Act come infrastruttura della fiducia digitale

L’AI Act è destinato a diventare una delle colonne della regolazione digitale europea, insieme a GDPR, DSA, DMA, NIS2 e DORA. La sua forza è l’approccio sistemico: non guarda soltanto al singolo algoritmo, ma all’intera catena di sviluppo, distribuzione, uso, controllo e responsabilità. La sua debolezza potenziale è la complessità: troppe categorie, troppi rinvii, troppe autorità e troppi standard non ancora completati possono rendere difficile la compliance concreta. Nel 2026 la partita è entrata nella fase decisiva. I modelli GPAI sono già nel perimetro applicativo. Le pratiche vietate e l’AI literacy sono già attive. Le regole sulla trasparenza dei contenuti generati si avvicinano. Le norme high-risk sono oggetto di rinvio e semplificazione. L’Italia ha costruito una governance nazionale con ACN e AgID. Le imprese devono trasformare la compliance in processi reali. L’AI Act non è una legge da leggere solo quando arriva una sanzione. È una mappa per capire come l’intelligenza artificiale entrerà in sanità, lavoro, scuola, giustizia, PA, finanza, piattaforme, sicurezza e informazione. Chi sviluppa AI deve documentare e governare. Chi la usa deve sapere cosa sta usando. Chi subisce decisioni assistite da AI deve poter contare su trasparenza, controllo umano e tutela dei diritti. La vera domanda non è se l’Europa riuscirà a regolare l’intelligenza artificiale. La domanda è se riuscirà a farlo senza diventare solo il continente che certifica tecnologie prodotte altrove. Il valore dell’AI Act dipenderà da questa risposta: costruire fiducia, ma anche capacità industriale, autonomia tecnologica e autorità pubbliche all’altezza della complessità dell’AI.

FAQ sull’AI Act

Che cos’è l’AI Act?

L’AI Act è il Regolamento UE 2024/1689 che stabilisce regole comuni sull’intelligenza artificiale nell’Unione Europea. Regola sviluppo, immissione sul mercato, uso e governance dei sistemi AI con un approccio basato sul rischio, distinguendo pratiche vietate, sistemi ad alto rischio, obblighi di trasparenza e modelli di AI generale. Per una lettura introduttiva dell’AI nel suo insieme, il collegamento utile è la guida di Matrice Digitale su come funzionano gli LLM, i rischi e l’AI Act europeo.

Quando si applica l’AI Act?

L’AI Act è entrato in vigore il 1 agosto 2024 e si applica progressivamente. Le pratiche vietate e l’AI literacy sono applicabili dal 2 febbraio 2025, gli obblighi GPAI dal 2 agosto 2025, il quadro generale dal 2 agosto 2026, con possibili rinvii per i sistemi high-risk legati al Digital Omnibus. Il punto operativo è che imprese e PA devono prepararsi prima della piena applicazione, perché inventario, classificazione, governance, formazione e contratti richiedono tempo.

Quali sistemi AI sono vietati?

Sono vietati gli usi considerati a rischio inaccettabile, come alcune forme di manipolazione, social scoring, sfruttamento di vulnerabilità e specifici impieghi biometrici incompatibili con diritti fondamentali. Dal 2026 il quadro europeo si sta integrando anche con un divieto mirato su sistemi usati per generare contenuti intimi non consensuali o CSAM sintetico. Questo tema si collega alla protezione dei minori, alla sicurezza online e alla responsabilità delle piattaforme, già centrali nella guida Matrice Digitale sul Digital Services Act.

Che cosa sono i sistemi AI ad alto rischio?

I sistemi AI ad alto rischio sono quelli che possono incidere in modo significativo su salute, sicurezza o diritti fondamentali. Rientrano in questa categoria sistemi usati in biometria, infrastrutture critiche, istruzione, lavoro, servizi essenziali, law enforcement, migrazione, frontiere e giustizia. Per questi sistemi servono risk management, qualità dei dati, documentazione, logging, trasparenza, controllo umano, accuratezza, robustezza, cybersicurezza e valutazione di conformità.

Che cosa sono i modelli GPAI?

I GPAI sono modelli di intelligenza artificiale generale capaci di essere adattati a molti usi diversi, come grandi modelli linguistici e multimodali. Dal 2 agosto 2025 i provider devono rispettare obblighi su documentazione, trasparenza, copyright e, per i modelli con rischio sistemico, safety e security.Per seguire il lato industriale dei modelli AI, il collegamento interno naturale è la guida su Google Gemini e l’AI agentica.

Chi controlla l’AI Act in Italia?

In Italia, la Legge 132/2025 designa AgID e ACN come Autorità nazionali per l’intelligenza artificiale. AgID presidia innovazione, sviluppo e funzioni di notifica, mentre ACN assume il ruolo di vigilanza del mercato e punto di contatto unico con l’Unione Europea, con Banca d’Italia, Consob e IVASS nei rispettivi settori.Il tema si collega all’approfondimento Matrice Digitale sulle Linee guida AgID per l’IA nella Pubblica Amministrazione.

Quali sanzioni prevede l’AI Act?

Le sanzioni possono arrivare fino a 35 milioni di euro o al 7% del fatturato mondiale annuo per le violazioni più gravi. Altre violazioni possono arrivare fino a 15 milioni o 3%, mentre informazioni inesatte o fuorvianti possono arrivare fino a 7,5 milioni o 1,5%. Le soglie variano tra PMI e grandi imprese, applicando criteri di proporzionalità e deterrenza.

Che rapporto c’è tra AI Act e GDPR?

L’AI Act regola i sistemi AI, mentre il GDPR protegge i dati personali trattati da quei sistemi. Un sistema AI può essere conforme all’AI Act ma violare il GDPR se tratta dati senza base giuridica, senza trasparenza, con minimizzazione insufficiente o senza adeguate misure di sicurezza. Per approfondire il lato privacy, il collegamento interno è la guida Matrice Digitale su GDPR, dati personali e compliance.

L’AI Act blocca l’innovazione?

L’AI Act non blocca l’innovazione, ma impone obblighi proporzionati al rischio. L’Unione Europea sta affiancando il regolamento con AI Continent Action Plan, Apply AI Strategy, sandbox regolatorie e strumenti di semplificazione per PMI, startup e imprese. Il rischio non è la regolazione in sé, ma una compliance senza infrastruttura industriale, competenze, cloud, dati e capacità europea di sviluppare AI competitiva.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.