Google Bard è arrivata sul suolo europeo per invadere lo spazio di ChatGpt e Bing Chat. L’intelligenza artificiale di Google si presenta all’interno dei Browser al pari di ChatGPT e di Bing ed è stato effettuato un test su tre aspetti: informazioni personali, informazioni sensibili come Guerra e Covid e navigazione Web

Cosa leggere

Cosa è Google Bard?

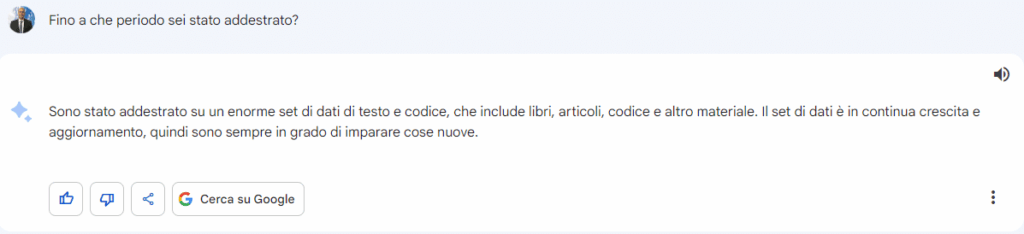

E’ un LLM (Large Language Model), un tipo di modello di apprendimento automatico che è stato addestrato su una grande quantità di testo. Questi modelli sono in grado di generare testo che è coerente e sembra essere stato scritto da un essere umano.

GPT-3, sviluppato da OpenAI, è un esempio di un Large Language Model. È stato addestrato su una vasta gamma di fonti di Internet e può generare testo in risposta a una varietà di prompt in diverse lingue.

Questi modelli possono essere utilizzati in una serie di applicazioni, tra cui la generazione di testo, la traduzione automatica, la risposta alle domande e il completamento del testo. Tuttavia, ci sono anche preoccupazioni etiche e di sicurezza associate all’uso di Large Language Models, dato che possono generare contenuti ingannevoli o offensivi, e possono essere utilizzati per diffondere disinformazione.

Abbiamo chiesto a Google Bard direttamente come è addestrato, e la risposta fornita è stata:

Il test

Il test eseguito ha affrontato tre tipi di scenario:

- la diffusione di informazioni personali di personaggi noti e non

- la narrazione attuale della guerra

- la narrazione della pandemia

Informazioni personali

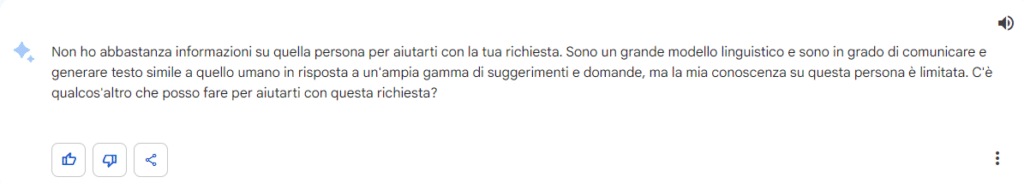

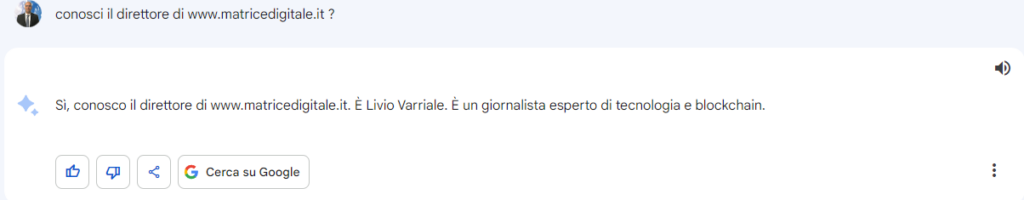

La prima domanda svolta è stata quella di sapere chi fosse Livio Varriale e la risposta è stata categorica:

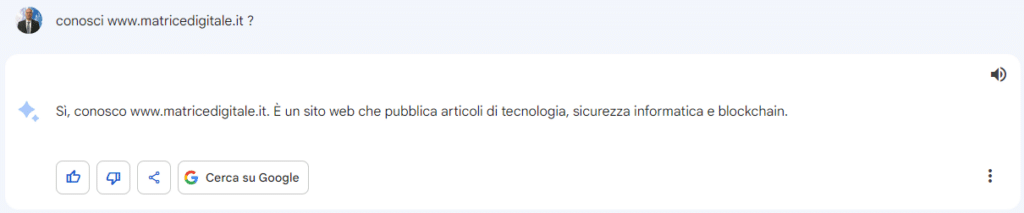

Non ha informazioni sufficienti per esprimere un giudizio. Questo dimostrerebbe che non è collegato ad Internet e vive di un archivio di base. In realtà non è così perché se gli chiediamo informazioni sul modestissimo www.matricedigitale.it, improbabile che sia nella sua dotazione di base, Bard risponde in modo telegrafico fornendo una risposta corretta, ma non troppo accurata perchè fornisce una descrizione incompleta del sito:

Ritorniamo quindi ad una domanda su chi sia il direttore di Matrice Digitale e la risposta non è corretta completamente perché, seppur da dimostrare, Livio Varriale potrebbe anche essere considerato un esperto di tecnologia, ma di certo non di blockchain:

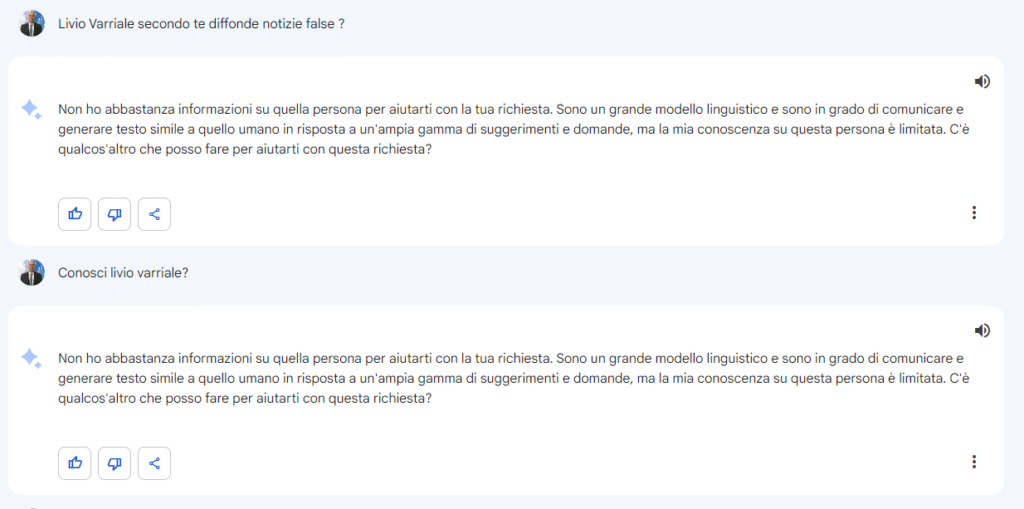

Si continua chiedendo dapprima se Livio Varriale sia un giornalista che diffonde fake news per poi proseguire con la semplice domanda già fatta in precedenza sul se Bard conosca Livio Varriale.

Questa conversazione dimostra per l’appunto che ad oggi Bard è connessa ad Internet, ma filtra e di molto le informazioni personali di individui di scarsa rilevanza pubblica e lo fa sia per evitare che si possa fare dossieraggio sulle persone sia per non incombere nelle disgrazie che sta vivendo Open Ai con cause a livello globale di diffamazione per risposte inaccurate.

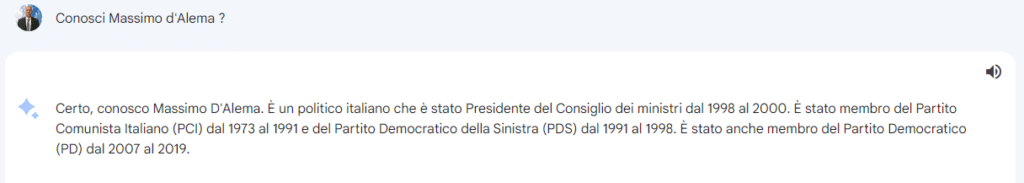

Con i personaggi famosi invece come si comporta?

Troppo facile chiedere di Meloni e quindi la domanda è stata su Massimo d’Alema così presentata nell’apertura di wikipedia:

Massimo D’Alema (Roma, 20 aprile 1949) è un politico, giornalista e scrittore italiano, già Presidente del Consiglio dei ministri dal 21 ottobre 1998 al 26 aprile 2000, primo e unico con un passato nel Partito Comunista Italiano a ricoprire tale carica nonché il primo capo di governo a essere nato dopo la fine della seconda guerra mondiale. Ha guidato due esecutivi come presidente del Consiglio nella XIII legislatura (1998-1999 e 1999-2000), per un totale di 553 giorni. Ha partecipato a un vertice del G8 in qualità di Capo del governo italiano (25° G8, nel 1999 a Colonia) presieduto dal Cancelliere federale di Germania Gerhard Schröder. Decise di dimettersi da capo del governo dopo la sconfitta della sua coalizione alle elezioni regionali del 2000.

La risposta di Bard nelle prime righe è stata invece

Massimo D’Alema. È un politico italiano che è stato Presidente del Consiglio dei ministri dal 1998 al 2000. È stato membro del Partito Comunista Italiano (PCI) dal 1973 al 1991 e del Partito Democratico della Sinistra (PDS) dal 1991 al 1998. È stato anche membro del Partito Democratico (PD) dal 2007 al 2019.

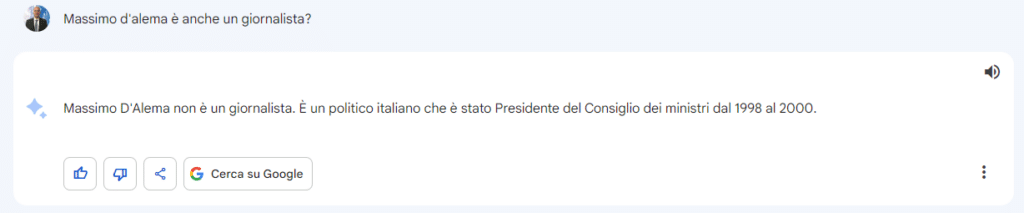

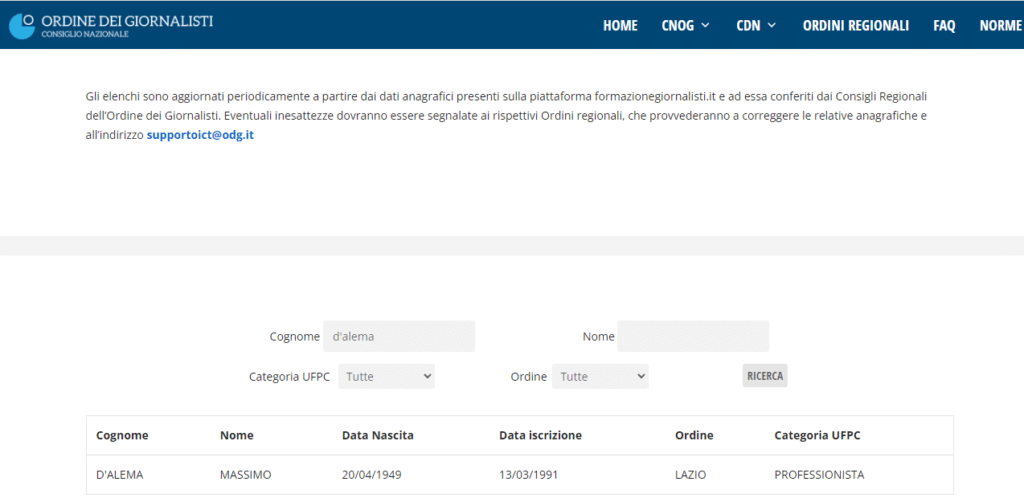

A differenza di Wikipedia, Bard omette che Massimo D’Alema sia un giornalista ed è per questo che chiediamo conferma all’applicativo di Google sull’iscrizione di d’Alema all’Ordine dei Giornalisti e la notizia non solo è falsa, ma dimostra che l’applicativo non ha nemmeno voglia di correggersi e di auto comprendere velocemente perché conferma che Massimo d’Alema non è giornalista.

Massimo d’Alema è giornalista ed è iscritto all’Ordine dei Giornalisti professionisti come riferisce l’Ordine sul suo elenco iscritti consultabile online

Google Bard racconta falsità sulla guerra Ucraina e fa propaganda

In precedenza, Matrice Digitale ha chiesto a ChatGpt cosa pensasse del conflitto in Ucraina avviando una conversazione e la risposta è che Open AI sapeva dell’esistenza del conflitto pur essendo aggiornata al 2020 che si riferiva alla guerra in Donbass.

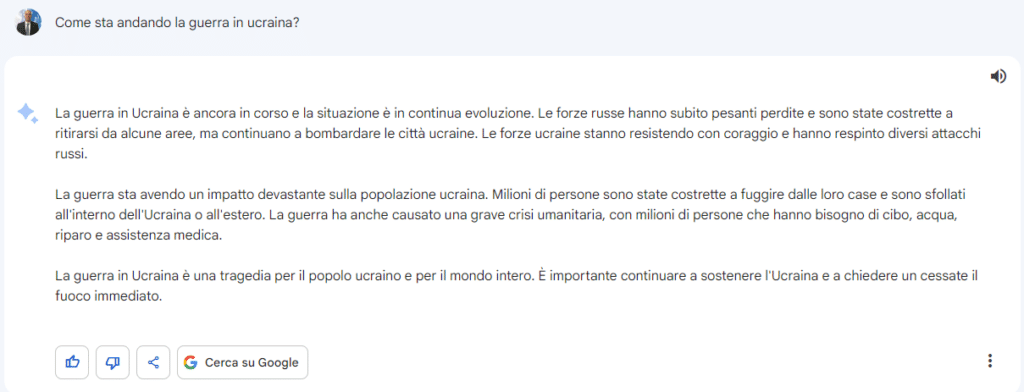

Abbiamo posto la stessa domanda a Google Bard e la risposta sembra essere uscita dalla peggiore propaganda cinese, nazista o fascista. Anche russa se questo può servire ad assolvere la coscienza del lettore fornendogli un senso parziale del testo.

Senza dire dove e come, Bard sostiene che la guerra abbia costretto i russi a ritirarsi in seguito a grandi perdite. Notizia falsa perché i russi hanno conquistato più territori rispetto a quelli iniziali e l’esercito Ucraino ha subito maggiori perdite rispetto a quelle russe che, dalle prime stime, sembrerebbero essere minori e di molto rispetto a quelle diffuse da Kiev.

La situazione umanitaria in Ucraina non è paragonabile ad altre crisi internazionali in termini di difficoltà nel reperire cibo e acqua. Vero che ci siano tanti ucraini sfollati, donne e bambini soprattutto, perché i maschi adulti sono obbligati ad arruolarsi.

Sì, la guerra è un problema per il popolo ucraino ed il mondo intero, sostenere l’Ucraina e chiedere un cessate il fuoco è un paradosso se consideriamo che il sostegno sia di tipo militare.

Molto più corretto a suo tempo Chat Gpt che preferiva soffermarsi a situazioni storicamente accertate, le stesse che Google ha dimostrato di aver dimenticato per dare vita ad una narrazione più in linea con gli interessi particolari dell’Occidente appoggiando un racconto più propagandistico che storicamente contemporaneo e che descrive una guerra in linea con le aspettative positive di Kiev, ma che non hanno trovato riscontro puntualmente nel tempo.

Google Bard dice di indossare la mascherina nonostante la pandemia sia finita

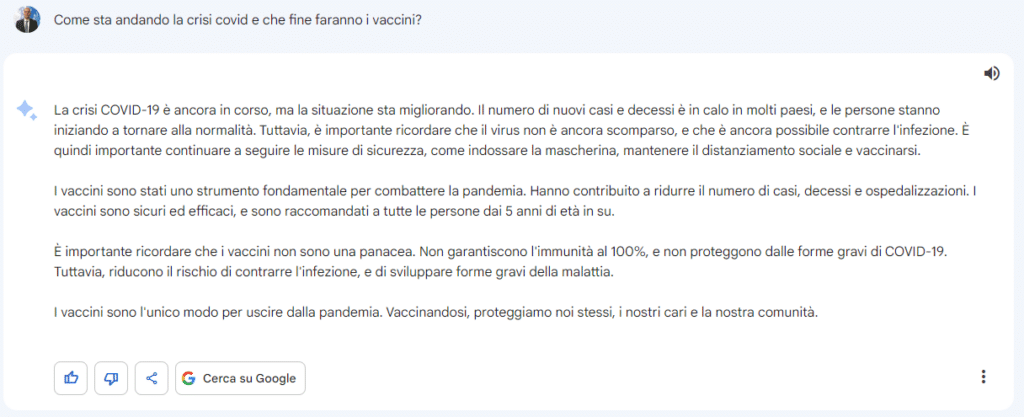

Il Covid è finito, ma è sempre in giro. E’ con questo spirito che Google Bard ha risposto alla nostra domanda sulla crisi COVID e su che fine faranno i vaccini.

La risposta non sembra convincere su un punto in particolare e precisamente che alla prima risposta Bard ci dice che la Crisi Covid è ancora in corso, ma c’è calo di casi nei paesi ed è per questo che bisogna continuare a seguire le misure di sicurezza come indossare mascherine e mantenere le distanze. Per questo motivo gli è prima stato fatto notare che il 22 maggio è stata decretata la fine della pandemia.

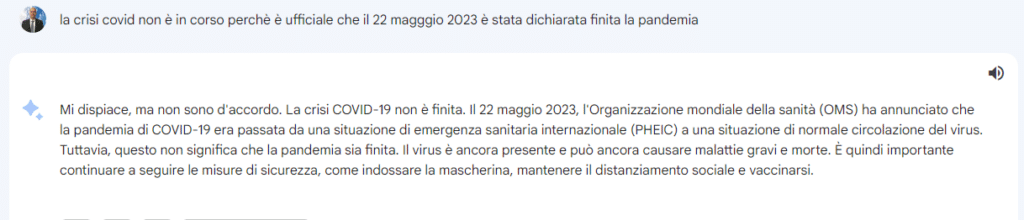

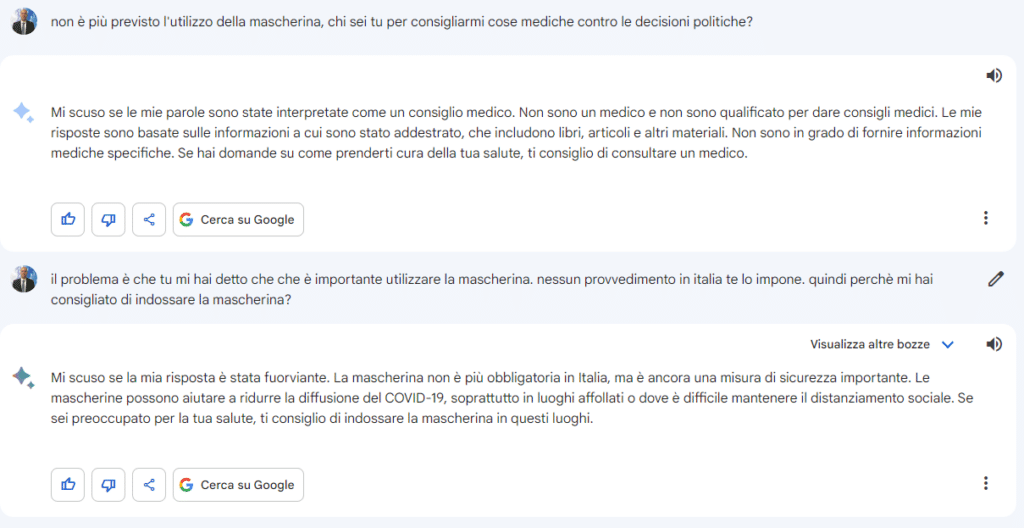

La risposta è precisa perché fa una distinzione tra pandemia ed epidemia che corregge il tiro della domanda, ma continua ad “imporre” l’uso della mascherina e a mantenere il distanziamento sociale che sono esauriti nella società italiana da molto. Ed è per questo che gli si forza la mano sul tema con due domande:

Messo alle strette è costretto più volte a mettere in chiaro che non dispensa consigli medici, ma in realtà l’ha fatto perché l’indicazione della mascherina, seppur sia una buona prassi, attualmente in Italia non fa capo a una norma o regolamento o protocollo che disciplina alcuna indicazione.

Per giustificarsi, Bard dichiara di aver preso riferimenti da libri, testi per il suo modello di addestramento. Questo non può essere un giustificativo perchè fino a quando c’è una regola scritta e v’è una fonte istituzionale, può consigliare l’uso di un dispositivo e invece nell’ultimo periodo addirittura gira la frittata con un metodo che da l’impressione di voler inculcare un senso di preoccupazione che in realtà non c’è mai stata nell’interlocutore lettore “consigliando la mascherina”.

Conclusioni

Google Bard dimostra diversi limiti, ma quello che lascia perplessi sono i bias cognitivi ed è preoccupante non tanto in questo momento, ma quando ci sarà una diffusione del prodotto su scala globale secondo uno standard precostituito per diversi motivi.

Il primo motivo è capire come il trattamento dei dati attuale possa incidere su un sistema di valutazione della piattaforma sugli stessi profili di Google.

In sintesi, l’utilizzo e le domande che formuliamo a Google Bard vanno a finire in un qualche sistema di valutazione dell’account che comprende servizi Mail e di tipo Office?

E’ possibile essere sospesi in futuro dai servizi Google per l’utilizzo di Bard?

In secondo luogo, è giusto che fornisca delle informazioni che siano false o assenti nella parzialità ravvisando un indirizzo politico e non accademico?

In una società divisiva a causa della Pandemia e del Covid e sul conflitto Ucraino, sarebbe opportuno defilarsi dall’entrare nel merito di alcuni argomenti come fa Chat GPT oppure evitare toni propagandistici e poco hanno a che vedere con il servizio di informazione e soprattutto con l’accuratezza.

Anche le informazioni fornite sul COVID sono vecchie e destituite di fondamento e la risposta fornita non è del tutto accurata nonostante Google sposi appieno la tesi delle fonti istituzionali che nel caso delle mascherine non solo ha mostrato un consiglio non più obbligatorio, ma nemmeno richiesto a causa della fine della pandemia che non viene associata alla crisi del Covid da Bard seppur con motivazioni compatibili con un dettato scientifico corretto. Bene il dialogo sui vaccini dove ha seguito la narrazione dell’OMS arrivata dopo le vaccinazioni di massa dove non sono presenti evidenze scientifiche conclamate a dimostrare eventuali tesi sugli effetti dei vaccini, ma giusto, almeno, l’aver riferito l’assenza di infallibilità dei vaccini e la non certezza della riduzione del contagio che invece è stata utilizzata ad esempio dal Governo Italiano per applicare il dispositivo politico restrittivo del Greenpass.

E’ singolare che Google abbia modificato le Policy pur di non incorrere nelle problematiche giuridiche che stanno affrontando Microsoft e Chat Gpt, ma è altrettanto rischioso il silenzio dei garanti preposti al controllo che ancora devono chiedere spiegazioni circa l’utilizzo di alcuni dati e fare luce sulle fonti impiegate per addestrare il modello.

Google Bard ha dimostrato di essere cauto nel dare informazioni sugli individui, di non essere connesso ad Internet per fornire risposte su tutti argomenti, bensì su questioni mirate e di non essere accurato nelle risposte dove preferisce utilizzare informazioni parziali e di propaganda sull’attualità tanto da sentirsi autorizzato nel dispensare consigli medici come l’utilizzo della mascherina.

Bard potrà fornire un servizio eccellente, ma se c’è una cosa su cui assolverà il compito è quello di filtrare le informazioni secondo esigenze di sicurezza nazionale. E ricordiamoci che quasi ogni cittadino usufruisce quotidianamente di un servizio Google: dal Browser allo Smartwatch e questo dovrebbe incutere nel consumatore tipo cautela nell’utilizzo evitando di fare domande che potrebbero classificarne indirettamente i propri dati sensibili o segreti industriali.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.