Recenti rapporti rivelano sviluppi innovativi nei servizi di messaggistica per gli utenti Samsung Galaxy S24 sia su WhatsApp sia su Google Messages, ampliando le capacità di comunicazione e interazione in diverse lingue.

Cosa leggere

Galaxy S24: Traduzione del Testo in Tempo Reale su WhatsApp

Nuove Caratteristiche AI di Galaxy S24

Samsung ha introdotto diverse nuove funzionalità AI per la serie Galaxy S24, alimentate da potenti NPU presenti nei processori Exynos 2400 e Snapdragon 8 Gen 3. Tra queste, spicca la traduzione del testo in tempo reale durante le chiamate vocali e i messaggi.

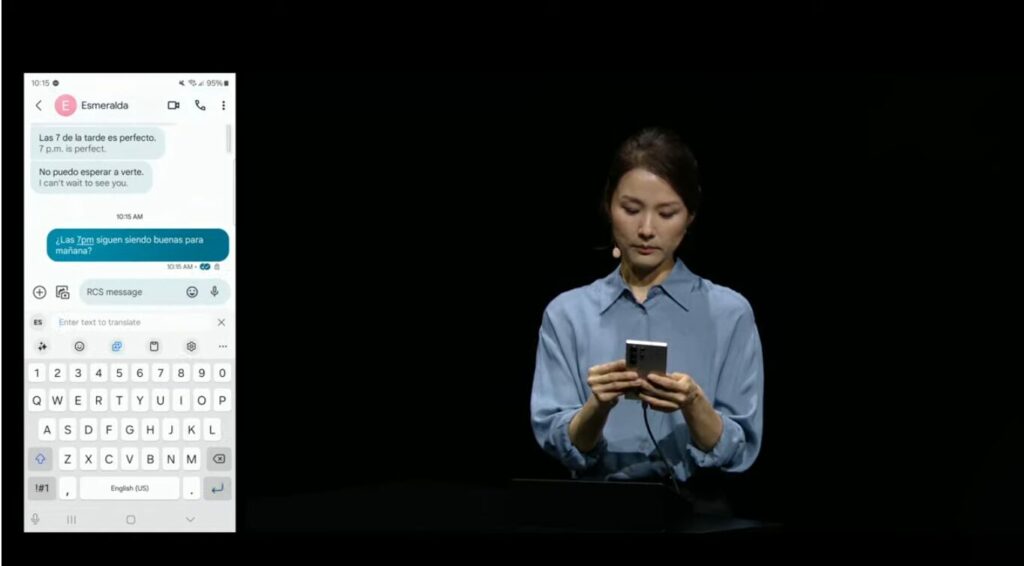

Traduzione su WhatsApp

Sebbene Samsung abbia mostrato la traduzione di testo tramite l’app Messaggi integrata, SamMobile riporta che questa funzionalità funziona anche con WhatsApp. Gli utenti possono aspettarsi traduzioni rapide e in tempo reale, anche senza connessione Internet attiva.

Google Messages: Integrazione con l’AI Bard

Bard in Google Messages

Assemble Debug segnala che l’app Google Messages potrebbe presto includere Bard, il chatbot AI di Google. La funzionalità è stata individuata nell’ultima versione beta dell’app e permetterà agli utenti di avviare chat RCS con Bard.

Capacità di Bard

Bard sarà in grado di aiutare gli utenti a scrivere messaggi, tradurre lingue, identificare immagini ed esplorare altri interessi. Studierà la posizione e le chat passate dell’utente per fornire risposte appropriate. Tuttavia, a differenza di altre chat RCS, le conversazioni con Bard non saranno crittografate end-to-end.

Sicurezza e Privacy

Google sottolinea che i dati delle chat con Bard saranno salvati per 18 mesi e consiglia agli utenti di non scrivere messaggi che non vorrebbero fossero visti da un revisore. I dati possono essere gestiti e cancellati manualmente dall’utente.

Impatto sulla Comunicazione Digitale

Questi sviluppi in Samsung Galaxy S24 (Compralo su Amazon) e Google Messages rappresentano passi significativi nell’integrazione dell’intelligenza artificiale nella comunicazione quotidiana, offrendo agli utenti strumenti avanzati per superare le barriere linguistiche e migliorare l’interazione digitale.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.