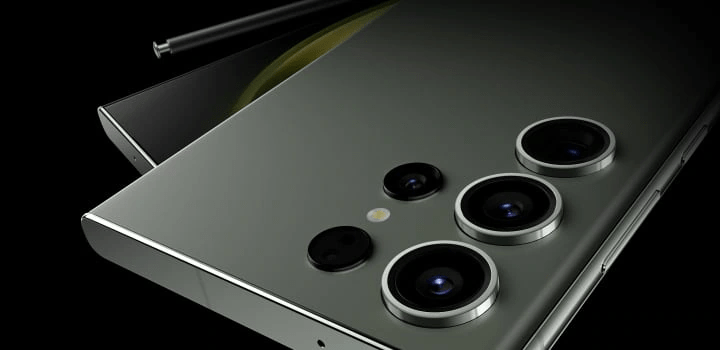

Samsung ha recentemente svelato la serie Galaxy S24, introducendo diverse funzionalità alimentate dall’intelligenza artificiale (AI), tra cui la traduzione in tempo reale durante le chiamate vocali, la sintesi delle note, l’assistenza grammaticale durante la messaggistica e la modifica delle immagini guidata dall’AI. Solitamente, alcune nuove funzionalità vengono rilasciate anche sui telefoni Galaxy esistenti, ma Samsung non aveva specificato se queste funzionalità AI sarebbero state disponibili sui dispositivi di fascia alta già in commercio.

Tuttavia, ora abbiamo alcune informazioni in merito. Secondo il sito web di Samsung, il Galaxy S23 Ultra riceverà alcune funzionalità alimentate dall’AI, tra cui Circle To Search, Live Translation, Note Assist e Photo Assist. Il sito indica che queste funzionalità arriveranno presto, sebbene non fornisca una tempistica specifica. In una tabella comparativa, Samsung suggerisce che queste funzionalità AI potrebbero non arrivare sul Galaxy S22 Ultra, sul Galaxy Z Flip 4 e sul Galaxy Z Fold 4. È probabile che queste funzionalità AI non saranno disponibili nemmeno sul Galaxy A34 e sul Galaxy A54.

Samsung potrebbe rilasciare queste funzionalità AI per la serie Galaxy S23 con l’aggiornamento One UI 6.1. L’azienda sudcoreana aveva menzionato che l’aggiornamento One UI 6.1 sarebbe stato rilasciato su smartphone e tablet compatibili prima della fine del primo semestre di quest’anno.

Circle to Search è una funzionalità che consente di cercare qualsiasi cosa corrispondente al contenuto in qualsiasi parte dello schermo. È alimentata da Google ed è estremamente simile a Google Lens, ma funziona più velocemente. Questa funzionalità è stata rilasciata sulla serie Pixel 8 pochi giorni fa. Live Translation permette la traduzione in tempo reale durante le chiamate vocali e può tradurre una lingua in un’altra per i chiamanti da entrambi i lati della chiamata.

La funzionalità Note Assist può riassumere il testo all’interno di Samsung Notes e organizzarlo in modelli facili da leggere. La funzionalità Photo Assist utilizza l’AI per consentire di regolare l’angolazione delle immagini e riempire lo spazio vuoto con contenuti AI generativi per adattarsi alla scena. Consente anche di raccogliere oggetti in un’immagine e regolarne la posizione o le dimensioni, oltre a consentire di rimuovere oggetti o persone indesiderati dall’immagine. Dopo questa notizia, potrebbe essere conveniente valutare un Galaxy S23 Ultra risparmiando dei soldi godendo allo stesso tempo dei servizi AI.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.