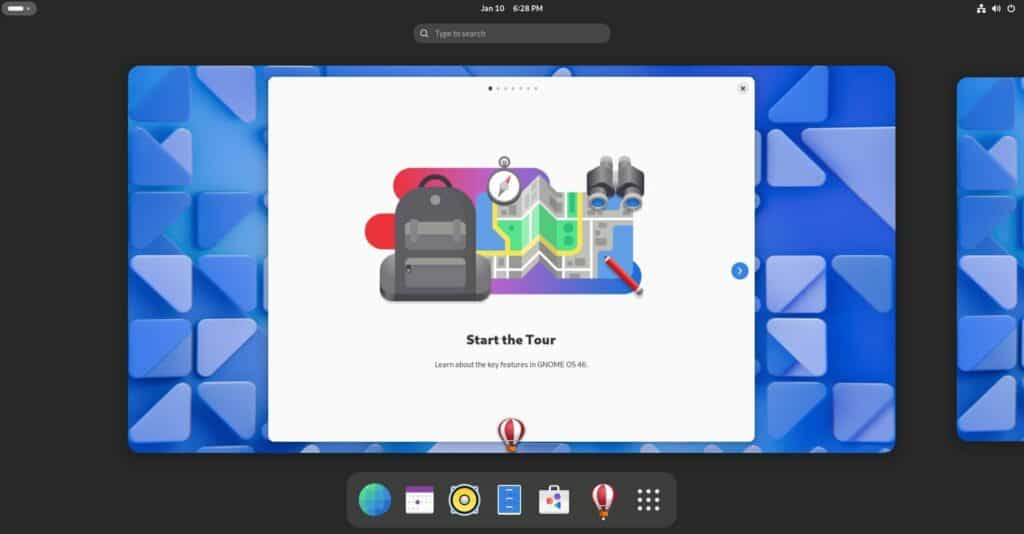

GNOME 46, la prossima versione del popolare ambiente desktop, introdurrà finalmente il supporto sperimentale per la variabile refresh rate (VRR), una caratteristica molto attesa che arriva dopo oltre tre anni di sviluppo da parte dei creatori di Mutter, il gestore delle finestre e compositore di GNOME.

Questa novità, pur essendo in fase sperimentale e non visibile di default agli utenti, potrà essere attivata mediante un comando specifico da eseguire in un emulatore di terminale, seguito da un riavvio della sessione. Una volta attivata, la funzionalità VRR permetterà di modificare il refresh rate del monitor attraverso la sezione Display nelle impostazioni di GNOME, garantendo un’esperienza visiva più fluida e senza interruzioni, soprattutto in contenuti dinamici come i videogiochi.

Al momento dell’annuncio, il supporto VRR in GNOME 46 presenta alcune limitazioni, tra cui la possibilità di incontrare scatti nel movimento del cursore in presenza di client a schermo intero che si aggiornano passivamente. Si spera che tali limiti vengano superati con l’aggiornamento successivo, GNOME 47, previsto per settembre 2024.

La richiesta di merge !1154 su GitLab per il progetto GNOME / mutter introduce il supporto per la variabile refresh rate (VRR) come caratteristica sperimentale in GNOME. Questa funzionalità, attesa da tempo, richiede l’attivazione manuale attraverso il comando:

arduinoCopy code

gsettings set org.gnome.mutter experimental-features "['variable-refresh-rate']"

Dopo aver eseguito il comando, è necessario riavviare la sessione per abilitare il VRR. Questa implementazione permette ai monitor compatibili di adattare il loro refresh rate al frame rate dei contenuti, migliorando così l’esperienza visiva in situazioni come i giochi, riducendo lo stuttering o il tearing.

Tuttavia, ci sono alcune limitazioni, come il potenziale stuttering nel movimento del cursore con client a schermo intero che si aggiornano passivamente. Questa limitazione deriva dall’API atomic KMS che non permette aggiornamenti del cursore più frequenti del contenuto visualizzato. Come soluzione parziale, il refresh rate del cursore non scenderà sotto i 30 Hz, anche se questa soglia potrebbe essere percepita come insufficiente da alcuni utenti.

Al momento, non esiste un protocollo Wayland che permetta di annunciare il supporto per VRR ai client, quindi si assume che tutte le finestre Wayland e X11 siano compatibili con VRR. Questo potrebbe causare problemi di compatibilità con applicazioni che non gestiscono bene il VRR.

La richiesta di merge !1154 è accompagnata da altre richieste correlate che affrontano vari aspetti tecnici per migliorare l’integrazione e la performance del VRR in GNOME.

Il rilascio di GNOME 46 è previsto per il 20 marzo 2024 e porterà con sé importanti novità come una modalità di Ricerca Globale dedicata per il gestore di file Nautilus, supporto per l’autenticazione tramite smart card PKCS #11 in Epiphany, nuove e riorganizzate impostazioni, maggiori porting a GTK4 e un’ampia gamma di applicazioni aggiornate.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.