Nel 2023, Google ha fornito approfondimenti preziosi su diversi aspetti cruciali del panorama digitale, tra cui la sicurezza degli annunci, l’evoluzione delle minacce zero-day e l’impiego dell’intelligenza artificiale per rafforzare le politiche pubblicitarie. Questi rapporti sottolineano l’impegno di Google nel promuovere un ecosistema online sicuro e trasparente, evidenziando al contempo l’importanza di tecnologie avanzate come l’IA nell’affrontare sfide complesse.

Cosa leggere

Rapporto di Google Rivela Aumento degli Exploit Zero-Day nel 2023

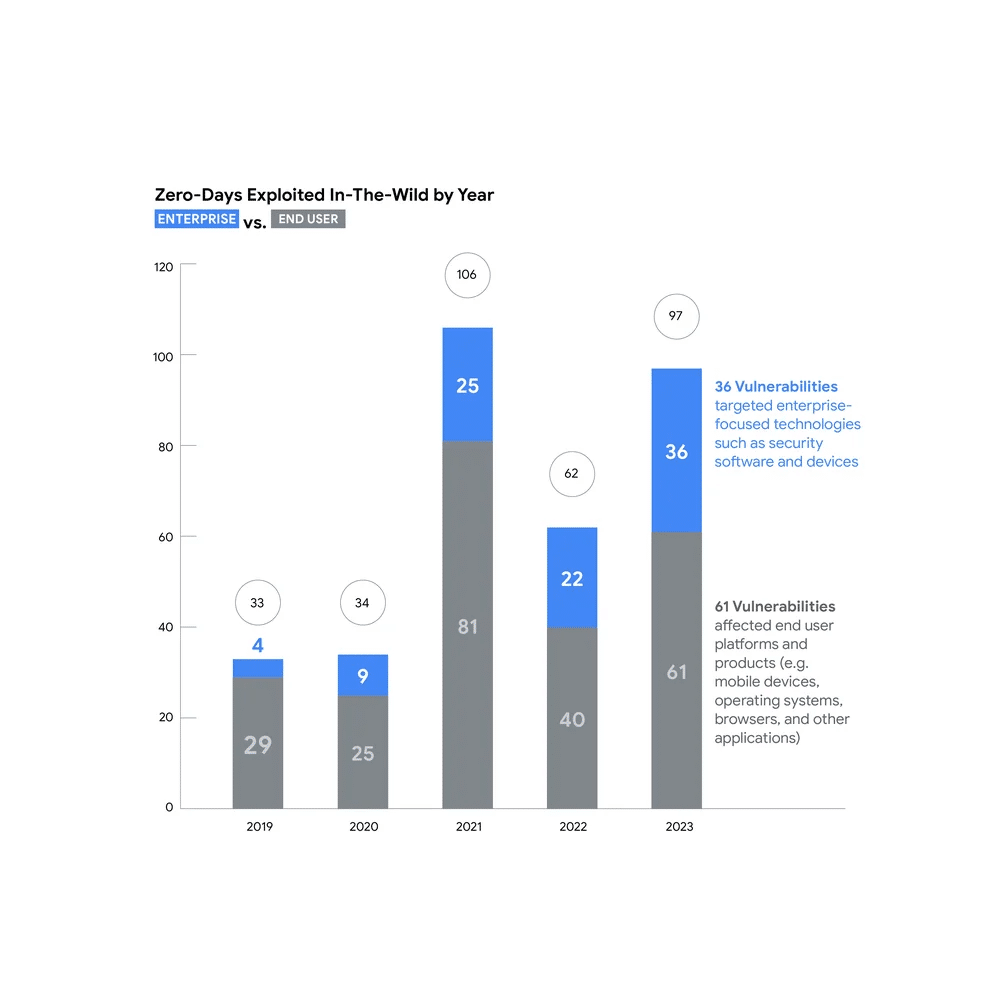

Google ha pubblicato il suo quinto rapporto annuale sugli exploit zero-day individuati “in-the-wild” nel 2023, mostrando un significativo aumento rispetto all’anno precedente. Nel 2023, sono state osservate 97 vulnerabilità zero-day sfruttate attivamente, segnando un incremento di oltre il 50% rispetto al 2022, ma ancora al di sotto del record del 2021 di 106. Questo è il primo rapporto congiunto tra il Google Threat Analysis Group (TAG) e Mandiant.

Panoramica del Rapporto

Il rapporto, intitolato “We’re All in this Together: A Year in Review of Zero-Days Exploited In-the-Wild in 2023” offre una panoramica approfondita degli exploit zero-day, includendo sia le piattaforme e i prodotti utilizzati dagli utenti finali (come dispositivi mobili, sistemi operativi, browser e altre applicazioni) sia le tecnologie orientate alle imprese, quali il software di sicurezza e gli apparecchi di rete.

Importanza del Rapporto

Attraverso l’analisi combinata di TAG e Mandiant, il rapporto non solo fornisce una valutazione più ampia della situazione, ma offre anche linee guida chiare per coloro che sono impegnati a garantire la sicurezza nel mondo digitale. L’obiettivo è fornire una comprensione più profonda delle minacce e stimolare un’azione collettiva per affrontare le vulnerabilità zero-day.

Raccomandazioni

La crescente tendenza degli exploit zero-day sottolinea l’importanza di una collaborazione continua e di un impegno condiviso tra gli attori del settore per rafforzare la sicurezza digitale. Il rapporto di Google funge da importante risorsa per comprendere le dinamiche correnti delle minacce e per orientare gli sforzi verso una maggiore resilienza contro gli attacchi zero-day.

Trend degli Exploit Zero-Day nel 2023: Un’Analisi Dettagliata

Nel 2023, il panorama della sicurezza informatica ha osservato un significativo aumento degli exploit zero-day, con un totale di 97 vulnerabilità sfruttate rispetto alle 62 del 2022. Questa analisi emerge dal primo rapporto congiunto tra il Google Threat Analysis Group (TAG) e Mandiant, sottolineando un’escalation nell’uso di queste minacce avanzate, pur rimanendo al di sotto del picco di 106 zero-day registrato nel 2021.

Punti Chiave del Rapporto

Il rapporto delinea due principali categorie di vulnerabilità zero-day: quelle relative a piattaforme e prodotti destinati agli utenti finali, come dispositivi mobili, sistemi operativi e browser, e quelle che riguardano tecnologie focalizzate sulle imprese, come il software di sicurezza e gli apparecchi di rete.

Tra le principali scoperte del rapporto figurano:

- Gli investimenti in sicurezza da parte dei fornitori stanno rendendo più difficili certi attacchi.

- Vi è un crescente targeting di componenti di terze parti, che influisce su più prodotti.

- L’obiettivo verso le imprese è in aumento, con un focus maggiore sul software di sicurezza e sugli apparecchi di rete.

- I fornitori di sorveglianza commerciale guidano gli exploit di browser e dispositivi mobili.

- La Repubblica Popolare Cinese rimane il principale sfruttatore statale di zero-day.

- Le attacchi motivati finanziariamente sono diminuiti in proporzione.

Casistiche rilevanti del 2023

Il rapporto evidenzia tre casi di exploit zero-day che hanno avuto un impatto significativo nel 2023:

- Barracuda ESG (CVE-2023-2868): una vulnerabilità zero-day nel Barracuda Email Security Gateway è stata attivamente sfruttata da ottobre 2022. L’attore di minaccia cinese UNC4841 è stato identificato come responsabile degli attacchi, che facevano parte di una campagna di spionaggio a favore della Repubblica Popolare Cinese.

- VMware ESXi (CVE-2023-20867): UNC3886, un gruppo di spionaggio cibernetico cinese, ha sfruttato un zero-day in VMware ESXi come parte di uno sforzo continuo per eludere le soluzioni di sicurezza e rimanere non rilevato.

- MOVEit Transfer (CVE-2023-34362): una vulnerabilità critica zero-day nel software di trasferimento file MOVEit Transfer è stata attivamente sfruttata per il furto di dati fin dal 27 maggio 2023. Inizialmente attribuita ad UNC4857, l’attività è stata successivamente associata a FIN11 sulla base di sovrapposizioni di targeting, infrastruttura e certificati.

Nonostante la difficoltà di difendersi dagli exploit zero-day, adottare un approccio multistrato alla sicurezza può aiutare a mitigarne l’impatto. Le organizzazioni dovrebbero concentrarsi sulla gestione delle vulnerabilità, sulla segmentazione della rete, sul principio del minimo privilegio e sulla riduzione della superficie di attacco. Inoltre, è consigliabile condurre una caccia alle minacce proattiva e seguire le linee guida e le raccomandazioni fornite dalle organizzazioni di sicurezza.

Gli exploit zero-day rappresentano una minaccia importante e diffusa, come dimostrato dai casi discussi. È fondamentale che i fornitori continuino a investire nella sicurezza per ridurre i rischi per utenti e clienti, e che le organizzazioni di tutti i settori rimangano vigili. Gli attacchi zero-day possono comportare significative perdite finanziarie, danni alla reputazione, furto di dati e altro ancora.

Uno sguardo al Futuro Digitale

I dati rivelano un aumento significativo degli exploit zero-day nel 2023, con Google e Mandiant che evidenziano la necessità di una collaborazione settoriale per contrastare efficacemente queste minacce. Parallelamente, l’IA sta rivoluzionando il modo in cui Google gestisce la sicurezza degli annunci, migliorando l’accuratezza e l’efficacia dell’enforcement delle politiche. Questi sviluppi riflettono il costante impegno di Google nel migliorare la sicurezza e l’esperienza utente online, utilizzando le tecnologie più avanzate per affrontare le sfide emergenti.

Rapporto sulla sicurezza degli annunci di Google 2023 rivela l’impatto delle AI

Nel suo rapporto sulla sicurezza degli annunci del 2023, Google svela come le grandi reti neurali basate sull’IA (Large Language Models, LLM) stiano rivoluzionando l’efficacia nell’applicazione delle politiche pubblicitarie, garantendo una piattaforma più sicura per gli utenti. Questo progresso rappresenta un salto qualitativo rispetto ai tradizionali modelli di machine learning, grazie alla capacità delle LLM di analizzare contenuti in grande volume e catturare sfumature importanti, consentendo decisioni di enforcement più precise su politiche complesse.

Avanzamenti nell’Enforcement

Per anni, i team di sicurezza di Google hanno utilizzato l’IA e il machine learning per far rispettare le politiche sugli annunci su vasta scala, bloccando miliardi di annunci inappropriati prima che potessero raggiungere gli utenti. Tuttavia, questi modelli tradizionali richiedevano un’estensiva fase di addestramento, basandosi su centinaia di migliaia, se non milioni, di esempi di contenuti violativi.

Le LLM, invece, possono rivedere e interpretare rapidamente un volume elevato di contenuti, migliorando significativamente l’efficacia dell’azione contro gli annunci che violano le direttive di Google. Questa capacità di analisi approfondita è particolarmente utile in contesti complessi, come la lotta contro le affermazioni finanziarie inaffidabili, inclusi gli annunci che promuovono schemi di arricchimento rapido.

Confronto con le Minacce Emergenti

Gli attori malintenzionati, specialmente nel settore finanziario, sono diventati sempre più sofisticati, adattando le loro tattiche e modellando gli annunci su nuovi servizi o prodotti finanziari per ingannare gli utenti. Sebbene i modelli tradizionali di machine learning siano addestrati per rilevare queste violazioni, la natura mutevole delle tendenze finanziarie può rendere difficile distinguere tra servizi legittimi e truffe.

Le LLM hanno dimostrato di essere particolarmente efficaci nel riconoscere rapidamente nuove tendenze nei servizi finanziari, identificare i modelli utilizzati dagli attori malintenzionati e differenziare tra un’attività commerciale legittima e uno schema di arricchimento rapido. Ciò ha reso i team di Google più agili nell’affrontare le minacce emergenti di ogni tipo.

Prospettive Future

L’uso delle LLM nella sicurezza degli annunci è ancora agli inizi. Con il lancio di Gemini, il modello di IA più avanzato di Google, l’azienda sta iniziando a integrare le sue capacità di ragionamento sofisticate negli sforzi di sicurezza e enforcement degli annunci. L’adozione di questa tecnologia promette di migliorare ulteriormente la sicurezza degli annunci su Google, affrontando efficacemente le minacce emergenti e garantendo un ambiente online più sicuro per tutti gli utenti.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.