Il fenomeno noto come LLMjacking sta emergendo come una nuova e significativa minaccia nel panorama della sicurezza informatica. Utilizzando credenziali cloud rubate, gli attaccanti hanno mirato a servizi AI basati su grandi modelli linguistici (LLM), generando costi ingenti per le vittime.

Cosa leggere

Dettagli dell’attacco LLMjacking

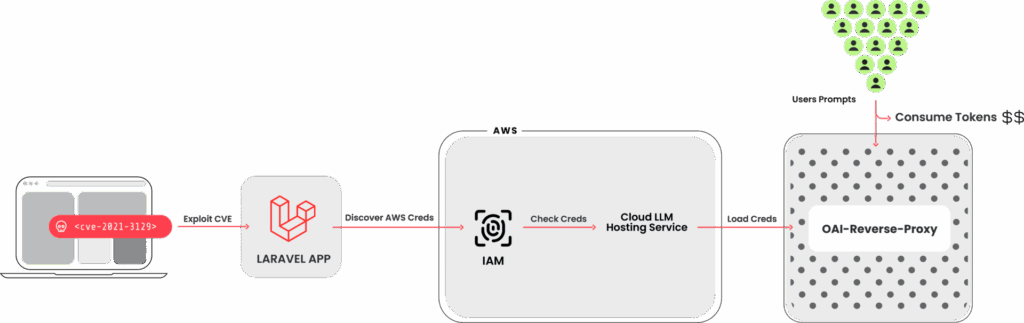

Recentemente, il team di ricerca di Sysdig ha identificato un attacco di LLMjacking che sfrutta credenziali cloud compromesse per accedere e manipolare servizi LLM ospitati su cloud. L’attacco ha sfruttato una vulnerabilità nel sistema Laravel, specificamente la CVE-2021-3129, per rubare le credenziali.

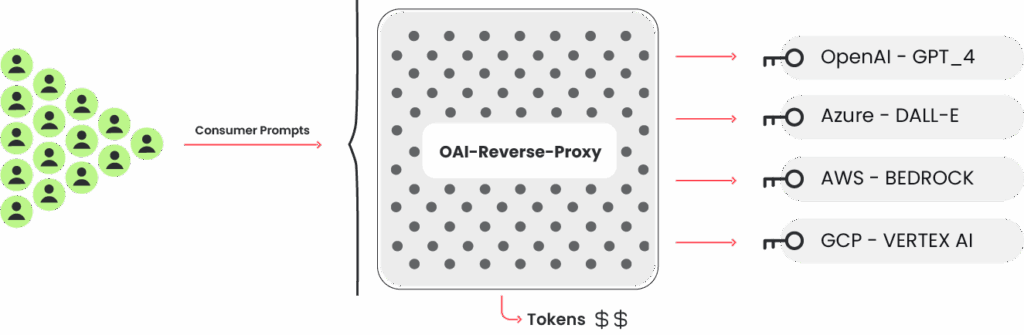

Una volta ottenuto l’accesso, gli attaccanti hanno mirato a modelli LLM locali ospitati da fornitori di cloud, tra cui modelli di Claude da Anthropic. Hanno esfiltrato ulteriori credenziali cloud e tentato di accedere a diversi servizi di AI tra cui AWS Bedrock, Azure e GCP Vertex AI, senza effettuare legittime richieste LLM ma piuttosto per valutare le capacità delle credenziali rubate.

Impatto economico e Operativo

Se non scoperti, gli attacchi di questo tipo possono comportare costi di consumo LLM superiori a $46,000 al giorno per le vittime. Inoltre, l’abuso di tali servizi può bloccare l’uso legittimo dei modelli da parte delle organizzazioni colpite, interrompendo le operazioni aziendali.

Strategie di difesa e prevenzione

La prevenzione di tali attacchi richiede una gestione attenta delle vulnerabilità e delle credenziali. Strumenti come la monitorizzazione dei log cloud e l’analisi comportamentale possono rivelare attività sospette, permettendo alle organizzazioni di rispondere prontamente. La configurazione di log dettagliati e l’uso di politiche di sicurezza adeguate sono essenziali per proteggere l’ambiente cloud. L’analisi approfondita di LLMjacking sottolinea la crescente sofisticazione degli attacchi cyber e l’importanza di robuste misure di sicurezza e monitoraggio per proteggere le risorse cloud e i dati sensibili.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.