I giochi di sparatutto in prima persona come Call of Duty sono noti per la tossicità delle loro lobby e chat vocali. La base di fan del franchise è stata definita la più negativa nel mondo dei videogiochi. Tuttavia, Activision sta cercando di affrontare questo problema e l’intelligenza artificiale potrebbe essere parte della soluzione.

Partnership con Modulate

Activision ha stretto una partnership con una società chiamata Modulate per introdurre una “moderazione della chat vocale in-game” nei loro titoli. Il nuovo sistema di moderazione, che utilizza una tecnologia AI chiamata ToxMod, lavorerà per identificare comportamenti come discorsi d’odio, discriminazione e molestie in tempo reale.

Rilascio di ToxMod

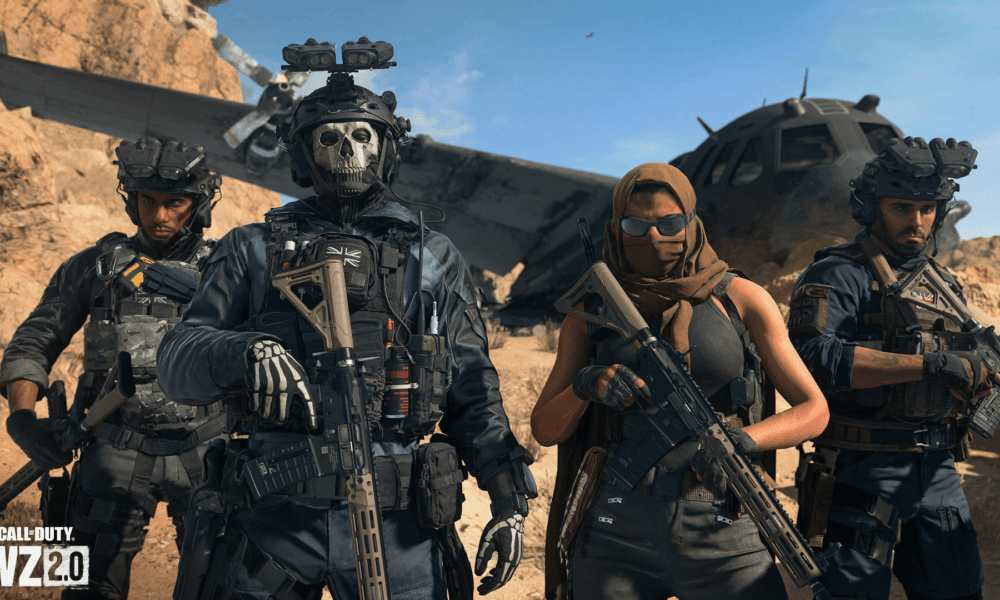

Il rollout iniziale in beta di ToxMod in Nord America ha avuto inizio oggi. È attivo all’interno di Call of Duty: Modern Warfare II e Call of Duty: Warzone. Un “rilascio completo a livello mondiale” (che non include l’Asia, come specificato nel comunicato stampa) seguirà il 10 novembre con il lancio di Call of Duty: Modern Warfare III, la nuova entrata di quest’anno nel franchise.

Come funziona ToxMod?

Il comunicato stampa di Modulate non fornisce molti dettagli su come funziona esattamente ToxMod. Tuttavia, sul sito web si nota che lo strumento “esamina la chat vocale per segnalare comportamenti scorretti, analizza le sfumature di ogni conversazione per determinare la tossicità e permette ai moderatori di rispondere rapidamente a ogni incidente fornendo un contesto rilevante e accurato”. Il CEO dell’azienda ha dichiarato in una recente intervista che lo strumento mira ad andare oltre la semplice trascrizione, prendendo in considerazione fattori come le emozioni e il volume del giocatore per distinguere le affermazioni dannose da quelle scherzose.

Azioni future

È importante notare che, almeno per ora, lo strumento non prenderà effettivamente provvedimenti contro i giocatori basandosi sui suoi dati, ma invierà semplicemente rapporti ai moderatori di Activision. L’intervento umano rimarrà probabilmente una salvaguardia essenziale, dato che le ricerche hanno dimostrato che i sistemi di riconoscimento vocale possono mostrare pregiudizi nel modo in cui rispondono agli utenti con diverse identità razziali e accenti.