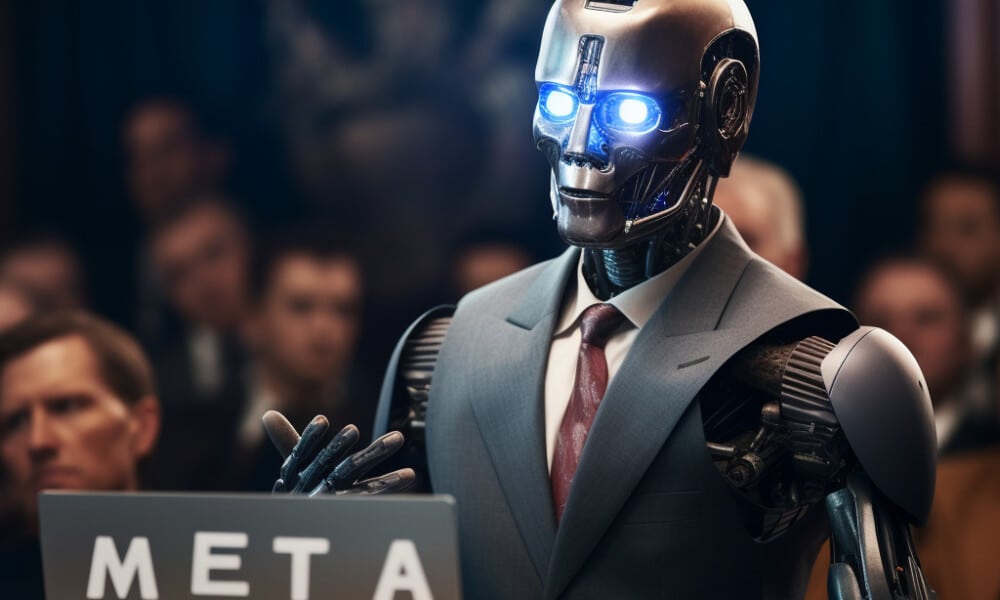

Il Consiglio di Sorveglianza, Board, di Meta ha definito “incoerente” la politica dell’azienda sui deep fake, sottolineando che si concentra troppo sul fatto che un video sia stato alterato tramite intelligenza artificiale, piuttosto che sul danno che potrebbe causare. Questa critica è emersa nonostante il Consiglio abbia sostenuto la decisione dell’azienda di permettere la circolazione sulla piattaforma di un video alterato del Presidente Joe Biden.

Il video in questione utilizza filmati reali di Biden che, seguendo le istruzioni della nipote adulta, posiziona un adesivo “Ho votato” sopra il petto di lei. Tuttavia, una versione modificata del video, che ripete il momento in cui la sua mano raggiunge il petto della nipote per far sembrare che l’abbia toccata in modo inappropriato, è stata diffusa online, con una versione che etichetta Biden come “pedofilo malato”.

Il Consiglio ha concordato con Meta che il video non violava la sua politica sui media manipolati perché le regole vietano solo di far sembrare che qualcuno abbia detto qualcosa che non ha detto, piuttosto che fare qualcosa che non ha fatto. Le regole, nella loro forma attuale, si applicano anche solo ai video creati con l’AI, non agli editing ingannevoli più semplici o ai loop.

Tuttavia, pur ritenendo che Meta abbia applicato correttamente le sue regole in questo caso, il Consiglio ha suggerito cambiamenti significativi alle stesse, citando l’urgenza delle elezioni del 2024. “La politica di Meta sui Media Manipolati manca di una giustificazione persuasiva, è incoerente e confusa per gli utenti, e non specifica chiaramente i danni che cerca di prevenire,” ha scritto il Consiglio. “In breve, la politica dovrebbe essere riconsiderata.”

Il Consiglio ha suggerito che la politica dovrebbe coprire i casi in cui video o audio vengono modificati per far sembrare che qualcuno abbia fatto qualcosa che non ha fatto, anche se non si basa sulle loro parole. Il gruppo ha anche detto di non essere “convinto” dalla logica di prendere tali decisioni in base a come un post è stato modificato, sia tramite AI che con trucchi di editing più basilari.

Il Consiglio di Sorveglianza, Board, è stato creato da Meta per rivedere le decisioni di moderazione dei contenuti a cui viene fatto appello per giudizi vincolanti e per fare raccomandazioni politiche che l’azienda può scegliere di implementare ed i deep fake rappresentano un vero problema in vista delle elezioni americane del 2024. Un portavoce di Meta ha dichiarato che l’azienda sta esaminando le raccomandazioni e risponderà pubblicamente entro 60 giorni, come richiesto dallo statuto.