Sommario

Un robot autonomo, MAMA BEAR, presso il College of Engineering della Boston University ha creato una forma assorbente di energia che nessun umano avrebbe mai potuto ideare. Questa innovazione ha implicazioni significative per la progettazione di caschi più sicuri, imballaggi, paraurti per auto e molto altro.

L’Innovazione di MAMA BEAR

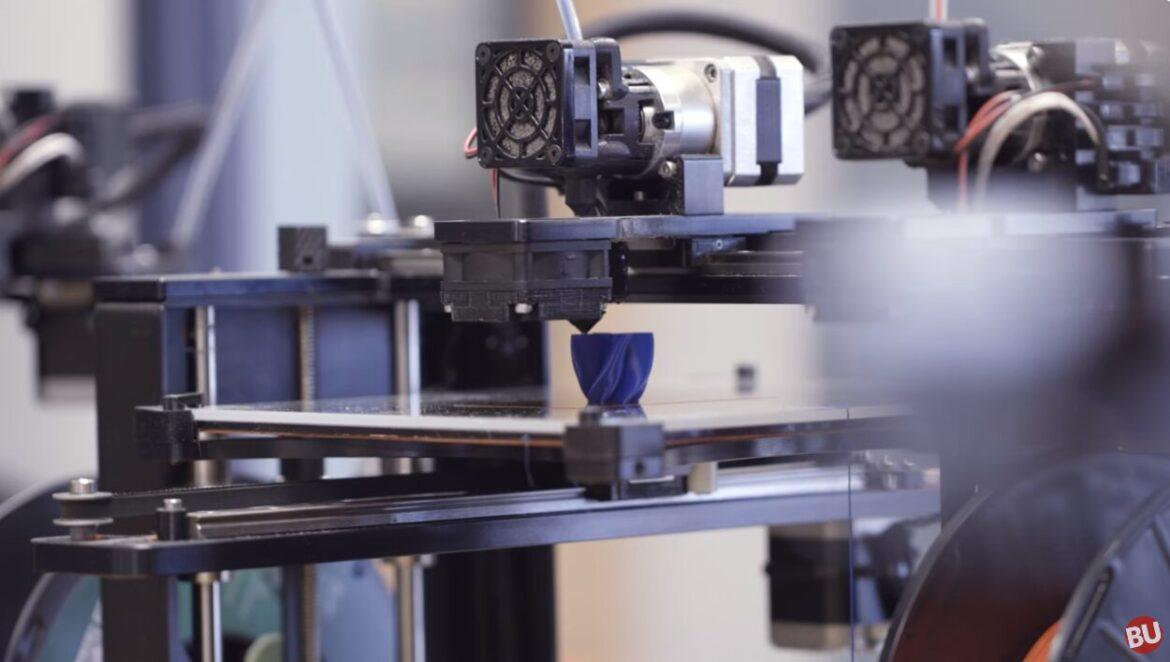

All’interno di un laboratorio della Boston University, un braccio robotico, chiamato MAMA BEAR (Mechanics of Additively Manufactured Architectures Bayesian Experimental Autonomous Researcher), esegue esperimenti autonomi per creare strutture di plastica stampate in 3D. Queste strutture sono progettate per assorbire l’energia in modo efficiente quando vengono schiacciate. MAMA BEAR utilizza un algoritmo di ottimizzazione bayesiana per migliorare progressivamente i design delle strutture basandosi sui risultati di migliaia di esperimenti precedenti.

Processo di esperimento

Il robot stampa una piccola struttura di plastica, ne registra la forma e la dimensione, e poi la schiaccia con una pressione equivalente al peso di un cavallo adulto che si appoggia su una moneta da 25 centesimi. Dopo aver misurato quanta energia la struttura ha assorbito e come la sua forma è cambiata, il robot registra tutti i dettagli in un vasto database. Ogni nuova struttura è leggermente diversa dalla precedente, con design e dimensioni modificati dall’algoritmo del robot.

Risultati rilevanti

- Efficienza Energetica: Prima di MAMA BEAR, la struttura migliore osservata aveva un’efficienza del 71% nell’assorbimento dell’energia. Nel gennaio 2023, il robot ha raggiunto un’efficienza del 75%, stabilendo un nuovo record.

- Applicazioni: Le strutture create da MAMA BEAR hanno un vasto potenziale, inclusi l’imbottitura per caschi, imballaggi per elettronica delicata, ginocchiere e protezioni per polsi per atleti. Attualmente, i dati raccolti vengono utilizzati per progettare nuovi inserti per caschi per i soldati dell’esercito statunitense.

Collaborazioni e Futuri Sviluppi

Il laboratorio KABlab della BU, guidato dal professore associato di ingegneria meccanica Keith Brown, continua a collaborare con altre istituzioni e ricercatori per espandere l’uso della ricerca autonoma. Il team sta anche esplorando modi per riciclare i materiali delle strutture schiacciate, riutilizzandoli per ulteriori esperimenti.

L’importanza della Ricerca Autonoma

La ricerca autonoma, come quella eseguita da MAMA BEAR, consente di condurre esperimenti in modo più rapido ed efficiente rispetto ai metodi tradizionali. Questo approccio non solo accelera il processo di scoperta, ma permette anche di raggiungere risultati che sarebbero stati troppo costosi e lunghi da ottenere con metodi convenzionali.