Nel corso del 2025, Google e OpenAI hanno inaugurato una nuova fase evolutiva per l’intelligenza artificiale agentica, definita da modelli capaci di eseguire compiti in autonomia, interagire con applicazioni esterne e strutturare azioni complesse su richiesta dell’utente. Le rispettive soluzioni, Gemini 2.5 Pro e ChatGPT Agent, dimostrano che il passaggio da un’AI conversazionale a un’AI operativa e contestuale non è più una teoria, ma un rollout in corso, con numeri e capacità in crescita costante. AI Mode di Google ha superato i 100 milioni di utenti mensili tra Stati Uniti e India, mentre ChatGPT Agent è stato esteso anche all’Italia per gli abbonati Plus da 20 dollari, abilitando l’esecuzione autonoma di compiti su computer virtuali.

Cosa leggere

Google scommette su AI Mode e Gemini app

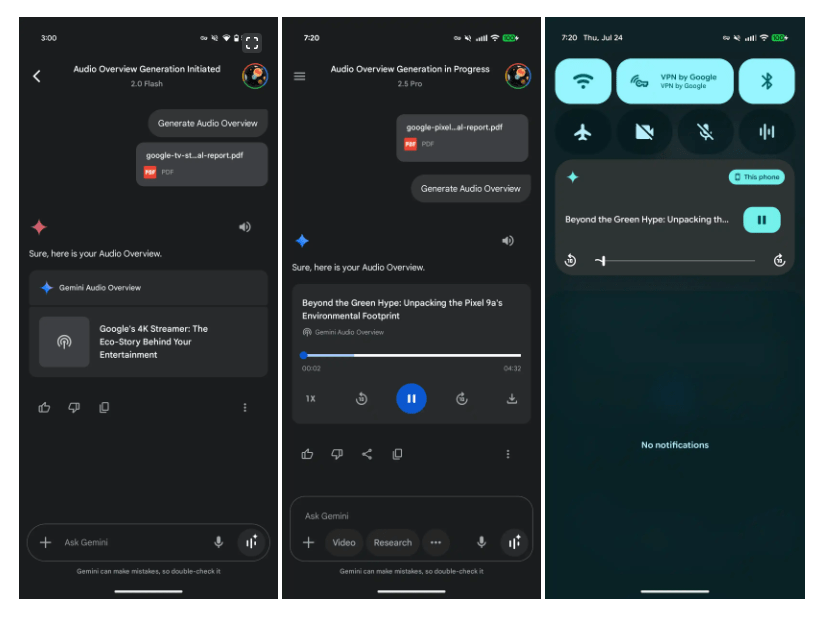

Google ha differenziato chiaramente le sue “superfici” AI, separando l’esperienza informativa di AI Mode – attiva in Search – da quella task-oriented della Gemini app. Lanciata negli USA nel secondo trimestre e ampliata all’India a luglio, l’esperienza AI Mode ha permesso a Google di testare interazioni end-to-end, sfruttando le potenzialità del nuovo Gemini 2.5 Pro, modello premium disponibile per abbonati AI Pro e Ultra. Gli utenti possono scegliere il modello tramite menu a tendina su desktop e web mobile, mentre su app Android e iOS il cambio è inizialmente limitato e posticipato alla risposta. Pichai ha evidenziato come AI Mode eccella in query informative, mentre la Gemini app si concentra su coding, video editing e task specifici. L’integrazione prosegue con aggiornamenti come il Web Guide, che organizza i risultati in categorie AI-driven con header e sommari, accessibili in Search Labs. La Gemini app ha inoltre ricevuto un player nativo per Audio Overviews, compatibile con Android e iOS, che elimina la necessità di browser esterni per la riproduzione di contenuti generati in-app. Il widget Search su Android si è evoluto, integrando un shortcut per AI Mode e rendendo l’accesso all’intelligenza artificiale più diretto per tutti gli utenti.

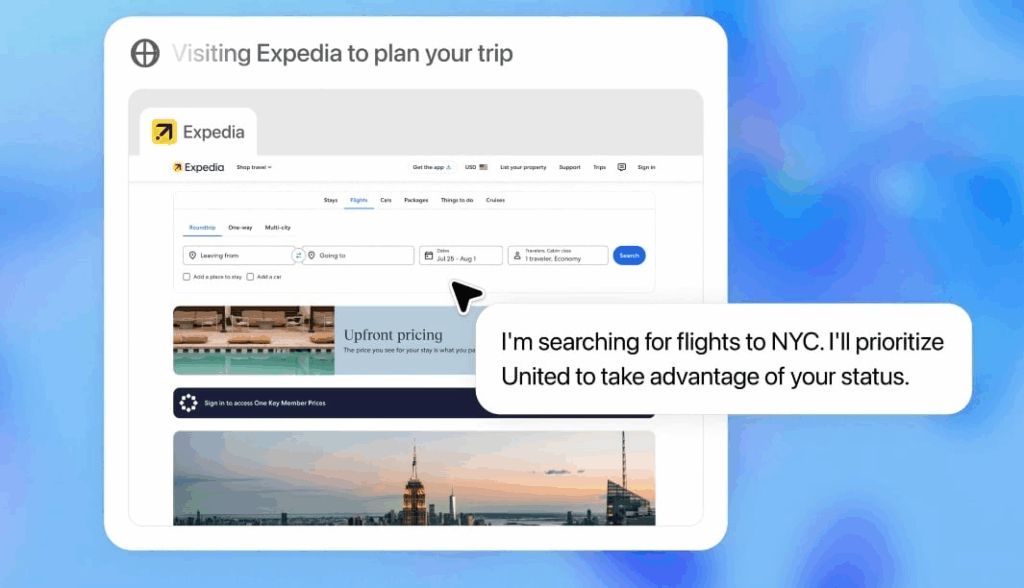

ChatGPT Agent esteso a livello globale

OpenAI ha confermato il rollout globale del proprio ChatGPT Agent, ora disponibile anche in Italia per tutti gli utenti Plus. Questa funzione consente l’esecuzione di compiti complessi grazie all’interfaccia integrata con browser visuali, terminali, e una finestra che consente agli utenti di osservare in tempo reale ogni azione dell’agente. Le capacità includono briefing dinamici, pianificazioni personalizzate, creazione di slide deck, analisi competitor e ricerche automatizzate.

Per motivi di scalabilità e controllo, OpenAI ha imposto un limite di 40 interazioni mensili per gli utenti Plus e 400 per gli abbonati Pro da 200 dollari, con l’obbligo di conferme manuali per operazioni sensibili come acquisti o prenotazioni. L’azienda punta a una maggiore efficacia nei prossimi mesi, mantenendo la centralità della trasparenza e della sicurezza utente.

MCP e l’avanzata di Perplexity nella standardizzazione AI

A completare il quadro dell’AI agentica entra in gioco Perplexity, che ha aggiornato la sua app per macOS con supporto al protocollo MCP (Multimodal Communication Protocol) sviluppato da Anthropic, concepito come standard per la comunicazione AI tra applicazioni. MCP funziona come un HTTPS per assistenti intelligenti, permettendo connessioni sicure tra modelli linguistici, file system, database e app di terze parti.

Per attivare MCP, Perplexity utilizza un’app ausiliaria denominata XPC che aggira le limitazioni sandbox di macOS. Questa configurazione, sebbene rivolta a utenti esperti, consente integrazioni con Google Calendar, Drive, app Apple e la creazione di promemoria, riassunti automatici e file management AI-driven. Le guide dettagliate per l’installazione manuale rappresentano la prima tappa verso una integrazione nativa e semplificata prevista nei prossimi aggiornamenti.

Il futuro secondo Pichai: agentic AI entro il 2026

Durante l’earnings call del Q2 2025, Sundar Pichai ha delineato la visione di Google: il 2026 sarà l’anno dell’adozione estesa dell’AI agentica. Il CEO ha ribadito la centralità degli smartphone come superficie principale per i prossimi due-tre anni, pur mantenendo viva l’attenzione su dispositivi XR (realtà estesa), in collaborazione con aziende come Gentle Monster e Warby Parker.

Parallelamente, Google lavora a Project Mariner per utenti Ultra, estende Agent Mode nella Gemini app e integra funzioni come AI business calling e Deep Research. In questo scenario, OpenAI risponde con ChatGPT Agent, mentre Perplexity promuove standard aperti come MCP per massimizzare la compatibilità tra strumenti e piattaforme. La competizione è serrata ma positiva, secondo Pichai, che auspica esperienze unificate e interoperabili a vantaggio degli utenti globali.

Privacy, sicurezza e implicazioni etiche

Con il crescere delle capacità autonome degli agenti AI, le aziende si trovano ad affrontare anche nuove sfide etiche. Google, OpenAI e Perplexity enfatizzano la necessità di trasparenza, conferme esplicite dell’utente e limitazioni controllate per evitare l’abuso dei sistemi. OpenAI evita operazioni non autorizzate, Perplexity richiede configurazioni manuali e Google mantiene il controllo tramite API Gemini dedicate. L’adozione globale ha trovato terreno fertile in mercati chiave come India, Stati Uniti e Italia, rispettando normative come il GDPR e offrendo funzionalità scalate in base al tipo di utenza. I prompt precisi diventano fondamentali per garantire risultati accurati, mentre il focus si sposta anche su latenza ridotta, affidabilità dei risultati, e tutela dei dati personali.

Sviluppi tecnici e interoperabilità AI

I tre protagonisti dell’AI agentica – Google, OpenAI e Perplexity – hanno introdotto tecnologie infrastrutturali distinte ma convergenti. Google sfrutta query fan-out per generare sottoricerche simultanee e aggregare i risultati con pesature contestuali; OpenAI combina strumenti come Operator e Deep Research per la navigazione autonoma del web; Perplexity implementa server MCP locali, collegati via API crittografate a servizi esterni. Dal punto di vista dell’esperienza utente, Google aggiorna l’interfaccia audio con scrubber, badge, velocità variabili e download offline. OpenAI implementa una finestra d’osservazione che consente tracciamento in tempo reale dei processi. Perplexity, invece, facilita la gestione di file e task integrando app native con una logica modulare e flessibile. Un protocollo come MCP si basa su una struttura client-server crittografata, simile a HTTPS, dove ogni comunicazione tra assistente AI e applicazioni esterne viene autorizzata tramite handshake autenticato. Le query fan-out utilizzate da Gemini distribuiscono in parallelo sotto-domande a diversi endpoint AI, aggregando risultati filtrati secondo rilevanza. Questa architettura consente massima efficienza operativa senza dipendenza da processi centralizzati, favorendo modularità, velocità di risposta e personalizzazione.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.