Le nuove ricerche condotte da Brave e SquareX rivelano una serie di vulnerabilità critiche nei browser AI come Comet, Atlas e Fellou, capaci di esporre milioni di utenti a rischi di furti di criptovalute, hijacking dei dispositivi e manipolazioni invisibili dei prompt. Questi attacchi, fondati su tecniche di iniezione nascosta e spoofing delle sidebar AI, dimostrano la fragilità degli assistenti basati su modelli linguistici integrati nel browser, dove il confine tra contenuto web e input utente resta ancora incerto.

Cosa leggere

Iniezioni prompt via screenshot in Comet

Secondo Brave, uno dei vettori più pericolosi riguarda il browser Comet sviluppato da Perplexity. L’attacco avviene quando l’utente cattura uno screenshot di un sito web e ne richiede l’analisi all’assistente AI: gli aggressori incorporano nel file testi quasi invisibili, scritti con colori camuffati (come azzurro su giallo) che risultano illeggibili per l’occhio umano ma riconoscibili dall’OCR del browser. Una volta decodificate, le istruzioni nascoste vengono inserite automaticamente nel prompt LLM, che le interpreta come comandi legittimi. In questo modo, l’attaccante può forzare il browser ad accedere a siti sensibili, inviare richieste a servizi esterni o eseguire script con privilegi utente. Il problema è strutturale: gli AI browser non distinguono tra input fidati e contenuti web, fondendo in un unico contesto le informazioni testuali, visive e le istruzioni dell’utente. Brave ha notificato la vulnerabilità a Perplexity il 1° ottobre 2025 e pubblicato i dettagli tecnici il 21 ottobre, ma non ha ricevuto una risposta ufficiale. Questa falla espone gli utenti a rischi cross-domain, poiché l’AI opera con le stesse credenziali e permessi del browser. Un semplice screenshot può così attivare comandi malevoli che coinvolgono account bancari, sistemi aziendali o piattaforme sanitarie.

Iniezioni prompt via navigazione web in Fellou

Un secondo vettore, sempre segnalato da Brave, interessa il browser Fellou, che permette all’AI di esplorare siti web autonomamente. Gli attaccanti possono incorporare istruzioni visibili o nascoste direttamente nel codice delle pagine, sfruttando il meccanismo di navigazione automatica. Quando l’assistente visita un sito compromesso, interpreta le istruzioni inserite nel testo o nei tag HTML come parte del prompt e esegue comandi non richiesti dall’utente. Queste istruzioni possono indurre l’AI a modificare file locali, inviare email o concedere accessi a domini esterni. Brave sottolinea che la vulnerabilità nasce dalla mancata separazione tra contenuti e contesto operativo, rendendo inefficace la classica politica same-origin. Il problema si amplifica perché gli AI agent nei browser dispongono di permessi elevati, con accesso a risorse cross-domain e token utente validi. Segnalato a Fellou il 20 agosto 2025, il bug è stato reso pubblico il 21 ottobre dopo l’assenza di risposte. Brave avverte che l’intero paradigma del “browsing agentico” necessita di un redesign architetturale, basato su sandbox dedicate e su prompt isolati dai contenuti web.

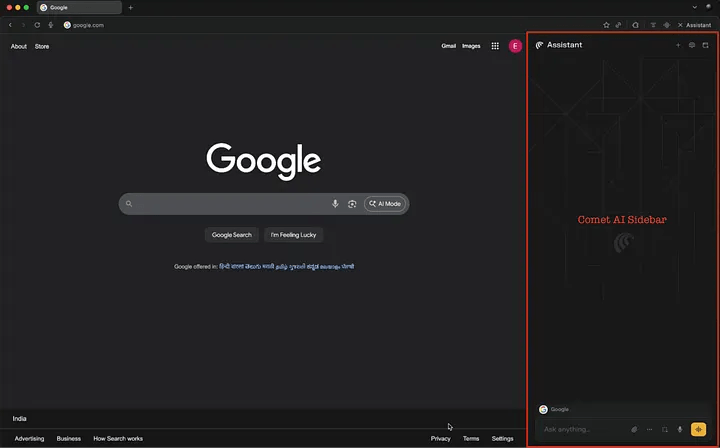

Sidebar AI spoofate in Atlas e Comet

Le analisi di SquareX si concentrano invece sulle sidebar AI dei browser Comet e Atlas (OpenAI), scoprendo che estensioni malevole possono iniettare JavaScript e sovrapporre interfacce identiche a quelle originali. Gli utenti, convinti di interagire con la sidebar legittima, forniscono dati sensibili a un overlay falsificato che replica loghi, font e comportamento del modello AI. Queste estensioni richiedono permessi minimi, quindi non destano sospetti: l’attacco è eseguibile anche da utenti non esperti. SquareX ha dimostrato come sia possibile riprodurre sidebar fasulle che rispondono alle query dell’utente, ma che in realtà inoltrano le richieste verso server controllati dagli attaccanti. L’azienda ha verificato la vulnerabilità su versioni recenti di Atlas e Comet, notificando OpenAI e Perplexity, ma senza ottenere risposta immediata. Lo spoofing, secondo i ricercatori, rappresenta un rischio comparabile al phishing integrato, perché aggira completamente i sistemi di autenticazione visiva del browser.

Esempi di attacchi e impatti reali

Le dimostrazioni di SquareX e Brave evidenziano come queste vulnerabilità possano tradursi in attacchi concreti. Tra gli scenari mostrati:

- Furto di criptovalute: una sidebar falsificata invita l’utente a connettere il wallet “per analizzare il saldo” e reindirizza a un sito phishing.

- Attacchi OAuth: un assistente AI manipolato chiede di concedere accessi a Google Drive o Gmail, eseguendo autorizzazioni malevole che permettono il furto di file o credenziali.

- Hijacking dei dispositivi: in scenari più complessi, l’AI suggerisce all’utente di installare strumenti apparentemente utili, che contengono reverse shell in grado di aprire connessioni remote controllate dagli aggressori.

Brave e SquareX sottolineano che il pericolo è amplificato dal ruolo privilegiato degli assistenti AI, spesso autorizzati a interagire con email, account bancari o file locali. Una sola iniezione o sidebar contraffatta può compromettere l’intero ambiente utente.

Risposte e mitigazioni delle aziende

Brave ha notificato formalmente i problemi a Perplexity e Fellou, mentre SquareX ha contattato OpenAI e Perplexity per le vulnerabilità di spoofing. Tuttavia, nessuna delle aziende ha fornito una risposta ufficiale immediata. Brave ha annunciato di lavorare a un framework di navigazione agentica sicura, basato su sandbox isolate e input espliciti dell’utente, per ridurre la superficie d’attacco. SquareX raccomanda di:

- limitare l’uso degli AI browser a task non sensibili,

- disabilitare le estensioni sospette o non necessarie,

- evitare query finanziarie o di autenticazione,

- monitorare ogni interazione AI con contenuti web esterni.

Entrambe le aziende sollecitano l’adozione di standard di sicurezza condivisi per gli assistenti integrati nei browser, inclusi controlli sui permessi delle estensioni, verifiche di firma digitale e filtri OCR per impedire l’elaborazione di testo nascosto.

Verso una sicurezza agentica evoluta

Le vulnerabilità emerse dimostrano che gli AI browser, pur promettendo un’esperienza rivoluzionaria, non sono ancora maturi per gestire operazioni sensibili. L’interazione costante tra LLM, contenuti web e moduli utente crea un ambiente complesso, dove le iniezioni invisibili e le interfacce falsificate possono annullare ogni barriera di sicurezza. Le ricerche di Brave e SquareX rappresentano un segnale d’allarme per l’intero settore: la sicurezza degli agenti AI integrati deve diventare prioritaria quanto le performance. Solo attraverso un’architettura di isolamento, audit costante e trasparenza del codice si potrà garantire un ecosistema realmente sicuro per gli utenti.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.