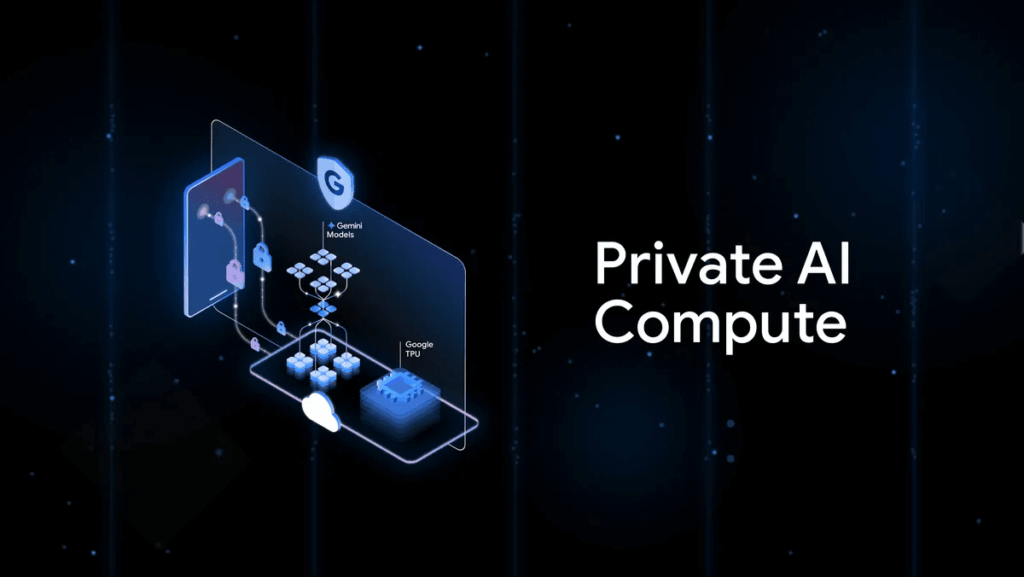

Google annuncia Private AI Compute, una piattaforma che inaugura una nuova era per l’AI sicura e rispettosa della privacy, con l’obiettivo di offrire le prestazioni del cloud mantenendo le garanzie tipiche dell’elaborazione locale. Basata su modelli Gemini avanzati e su un’infrastruttura cloud fortificata, la tecnologia debutta sui Pixel 10, migliorando funzionalità come Magic Cue e Recorder. Private AI Compute elabora dati sensibili in ambienti sigillati e crittografati, garantendo che nemmeno Google o soggetti terzi possano accedervi. L’iniziativa risponde alla crescente richiesta di AI potente ma privata, ponendo le basi di un nuovo paradigma per la sicurezza dei dati personali.

Cosa leggere

Architettura tecnica e principi di funzionamento

Alla base di Private AI Compute c’è un’infrastruttura proprietaria costruita su Tensor Processing Units (TPU) personalizzate, le stesse utilizzate nei data center di Google per servizi come Search e Gmail, ma ora ottimizzate per i modelli Gemini. La piattaforma integra le Titanium Intelligence Enclaves (TIE), spazi hardware isolati che creano ambienti “a tenuta stagna” per l’elaborazione delle richieste AI. Ogni dispositivo si connette al cloud attraverso attestazione remota e canali crittografati end-to-end, certificando che i dati vengano processati unicamente in enclave verificate. Questo approccio permette di superare i limiti hardware dei dispositivi mobili — come nella generazione di riassunti multilingue, trascrizioni o suggerimenti contestuali complessi — senza sacrificare la riservatezza. Tutte le richieste vengono eseguite in ambienti isolati, con chiavi di accesso generate e conservate localmente sul dispositivo. Gli utenti mantengono il pieno controllo delle informazioni inviate e possono revocare in qualsiasi momento l’autorizzazione al processamento remoto.

Un cloud sigillato per la privacy assoluta

Private AI Compute è progettato per emulare il modello di sicurezza del processamento on-device, ma con capacità computazionali ampliate. Le informazioni vengono elaborate in enclave cloud dedicate, dove i dati non lasciano mai il perimetro sicuro dell’utente. Né ingegneri né amministratori Google possono accedervi: i workload sono crittografati durante tutto il ciclo, dall’invio alla distruzione automatica al termine del processo. Ogni sessione AI avviene sotto verifica continua di integrità e autenticità. I Pixel 10 verificano l’identità delle enclave tramite attestazione remota verificabile prima di stabilire la connessione, assicurando che solo i nodi certificati possano partecipare al calcolo. La struttura hardware-based riduce drasticamente i rischi di intercettazione o compromissione, offrendo livelli di sicurezza paragonabili a infrastrutture governative o bancarie.

Feature e implementazioni sui Pixel 10

Le prime applicazioni pratiche di Private AI Compute appaiono su Magic Cue e sull’app Recorder dei Pixel 10. Magic Cue fornisce suggerimenti in tempo reale basati sul contesto — come risposte rapide durante riunioni o scrittura di messaggi — mentre Recorder ora è in grado di riassumere trascrizioni in più lingue, sfruttando la potenza cloud per elaborazioni linguistiche complesse. Ogni operazione avviene in modo trasparente per l’utente: il sistema verifica che i dati siano elaborati in enclave sigillate e, terminato il processo, non conserva log né contenuti. Questa architettura consente ad Android di offrire prestazioni da supercomputer senza rinunciare alla privacy personale, portando la filosofia del computo privato distribuito al livello consumer.

Struttura di sicurezza multilivello

Google dichiara che Private AI Compute adotta un modello di sicurezza a più strati, combinando hardware, software e controlli di fiducia crittografici. Le TPU personalizzate e le TIE garantiscono l’integrità fisica dei dati; i canali TLS rinforzati impediscono intercettazioni; mentre la validazione delle enclave assicura che nessun codice non autorizzato venga eseguito. Il sistema è sottoposto a test di penetrazione e audit indipendenti, e incorpora principi di AI responsabile per prevenire bias o usi impropri. Google ha implementato meccanismi di auditing automatico che verificano costantemente la conformità con le proprie policy di privacy e con i regolamenti internazionali, come il GDPR e l’AI Act europeo.

Differenze e analogie con Apple Private Cloud Compute

Private AI Compute è la risposta diretta di Google al Private Cloud Compute introdotto da Apple. Entrambe le architetture condividono l’obiettivo di eseguire l’AI nel cloud senza compromettere la privacy, ma si differenziano per approccio tecnico: Google utilizza TPU con enclave TIE, mentre Apple si affida ai propri chip siliconici personalizzati. Le due piattaforme garantiscono l’isolamento hardware delle sessioni, ma Google enfatizza l’integrazione verticale con l’ecosistema Gemini, che include modelli linguistici, visivi e multimodali. Questa sinergia consente una maggiore flessibilità per sviluppatori e OEM Android, i quali potranno sfruttare l’infrastruttura per creare applicazioni ibride che uniscono elaborazione locale e cloud privato.

Privacy verificabile e audit pubblico

Per rafforzare la fiducia degli utenti, Google pubblica un brief tecnico dettagliato e promette la verifica pubblica delle enclave tramite chiavi di attestazione open-source. Gli utenti potranno consultare i certificati delle istanze cloud utilizzate dai propri dispositivi, controllando che la versione software sia autentica e non manomessa. Inoltre, Google implementa un sistema di log temporanei criptati che consente audit indipendenti senza esporre dati sensibili. Tutte le operazioni vengono registrate con hash verificabili, offrendo una tracciabilità trasparente e compatibile con standard internazionali di sicurezza.

Implicazioni per sviluppatori e futuro dell’AI privata

Private AI Compute apre nuove prospettive per gli sviluppatori Android, che potranno integrare funzioni AI avanzate in applicazioni sensibili — come app sanitarie, traduttori o assistenti vocali aziendali — senza gestire direttamente dati personali. La piattaforma fornirà API specifiche per creare feature ibride in cui il dispositivo decide autonomamente se elaborare in locale o nel cloud, in base alla complessità del compito. A livello di mercato, questa tecnologia segna l’inizio di una nuova competizione sulla privacy AI, dove le aziende dovranno garantire potenza di calcolo senza rinunciare alla sicurezza. Google posiziona Private AI Compute come un pilastro strategico dell’AI responsabile, combinando performance da data center con controlli utente totali.

Disponibilità e prospettive di espansione

Private AI Compute debutta ufficialmente sui Pixel 10, ma verrà esteso a futuri dispositivi Android di fascia alta e ai servizi cloud di Google nel 2026. La compagnia prevede di integrarlo anche in Workspace e Android Auto, offrendo un’AI più contestuale ma sempre protetta da garanzie di isolamento hardware. Con questa mossa, Google ridefinisce il rapporto tra cloud e privacy, dimostrando che l’intelligenza artificiale può essere al tempo stesso potente, trasparente e sicura.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.