L’adozione dell’intelligenza artificiale da parte dei criminali informatici sta trasformando ransomware e malware in armi più subdole e veloci. Il gruppo LunaLock minaccia di usare dati rubati per addestrare modelli IA in caso di mancato pagamento, spingendo la doppia estorsione verso nuove leve psicologiche. In parallelo, la campagna EvilAI impiega codice generato da IA per confezionare trojan con interfacce realistiche e persistence automatizzata che elude controlli tradizionali. Le vittime includono manifatturiero, governativo e sanità; le tecniche combinano ingegneria sociale, app fake e C2 in tempo reale con canali AES cifrati per esfiltrazione di credenziali e dati sensibili. Le organizzazioni devono rafforzare protezione dei dati, monitoraggio del traffico anomalo e tool anti-IA malevola, coordinandosi con CERT-AGID per alert e IOC. La risposta passa da MFA resistente al phishing, zero trust, segmentazione, EDR e SIEM con analisi comportamentale, fino a piani IR maturi e forensics rapide che riducano MTTR e impatto reputazionale.

Cosa leggere

Panoramica: l’IA come moltiplicatore di minacce

La convergenza tra automazione e social engineering alimenta campagne che scalano con pochi operatori. Modelli generativi producono varianti di codice su richiesta, testano anti-analisi, generano phishing kit coerenti con branding reali e orchestrano catene d’infezione ottimizzate. L’IA rende i trojan più verosimili a livello di UI, scrive loader polymorphic, migliora obfuscation, e accelera la ricognizione su profili pubblici per creare esche iper-personalizzate. Il risultato è una riduzione drastica del time-to-compromise e una crescita del tasso di conversione degli attacchi.

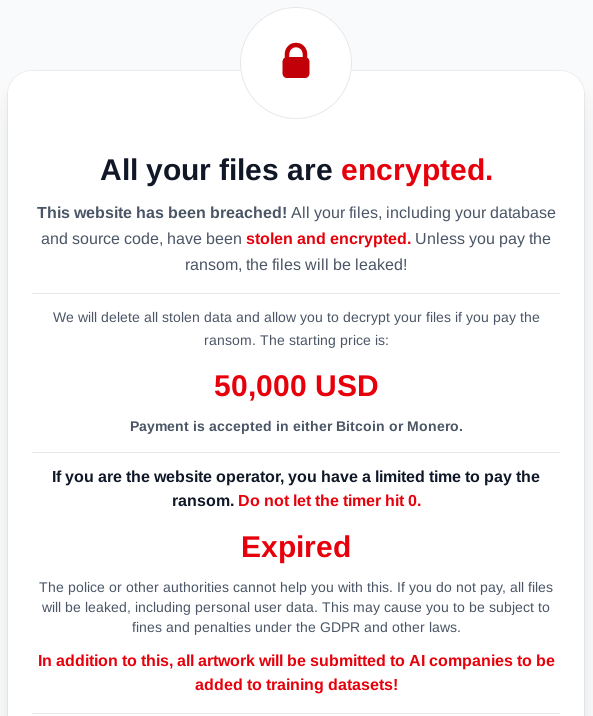

LunaLock: dalla doppia estorsione alla minaccia IA

La strategia di LunaLock aggiunge una leva inedita alla doppia estorsione: oltre a pubblicare i dati rubati, il gruppo minaccia di addestrare modelli IA con opere d’arte digitali, portafogli e progetti sottratti. La pressione psicologica cresce perché la contaminazione del dataset compromette nel lungo periodo valore e unicità dell’IP creativo. Creator e studi temono derivazioni non autorizzate, perdita di royalties e svalutazione del brand. L’uso pubblico di un Data Leak Site amplifica l’impatto, mentre richieste in criptovalute e countdown aggressivi spingono decisioni affrettate. In risposta, i proprietari di piattaforme creative attivano backup offsite, notifiche GDPR, rotazione delle chiavi, e verificano eventuali accessi API anomali usati per esfiltrare contenuti ad alta risoluzione.

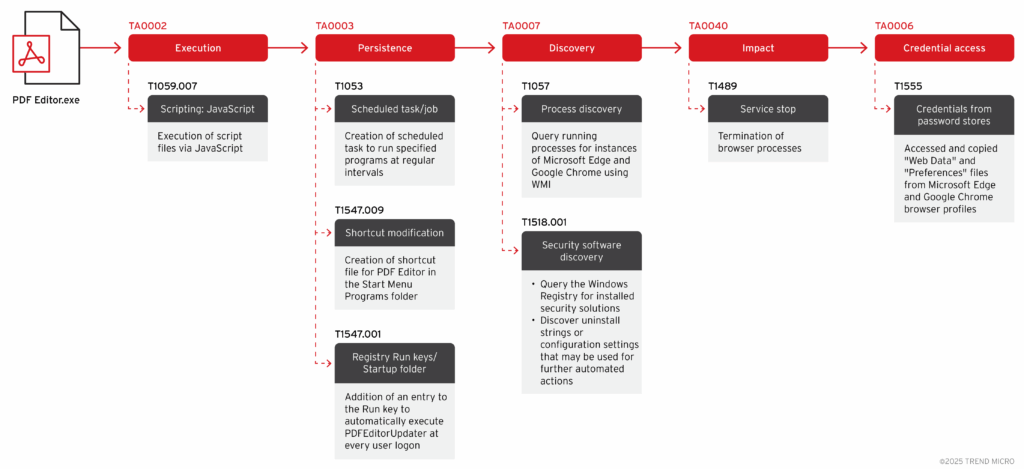

EvilAI: trojan camuffati da app legittime

La campagna EvilAI dimostra come i gruppi criminali impieghino codice generato da IA per creare eseguibili con interfacce plausibili, descrizioni localizzate e telemetria fasulla. Gli installer imitano software popolari o tool “crack”, quindi depositano un backdoor che interpreta payload JSON inviati dal C2 su canali AES. L’esfiltrazione colpisce credenziali dei browser, cookie di sessione e token di single sign-on, con funzioni per screenshot e keylogging che si attivano on-demand. L’automazione IA genera mutazioni giornaliere del codice, compila varianti con packing alternato e cambia stringhe e import per confondere EDR e antivirus basati su firme.

Tecniche di evasione e persistenza potenziate dall’IA

Gli attaccanti integrano anti-VM e anti-sandbox più evoluti. L’IA aiuta a riconoscere pattern di analisi e a rimandare l’attivazione finché non emergono segnali di uso reale: movimenti mouse naturali, apertura documenti, login a SaaS. La persistence sfrutta scheduled tasks, Run keys, DLL search order hijacking e, in ambienti aziendali, abuso di agent legittimi. La componente C2 scala su infrastrutture cloud che ruotano domini e IP con DGA e Fast Flux, mentre modelli IA selezionano orari di esfiltrazione meno rumorosi, riducendo la probabilità di allerta su SIEM mal sintonizzati.

Impatto settoriale: manifatturiero, PA e sanità

| Industria | Contare |

| Produzione | 58 |

| Governo | 51 |

| Assistenza sanitaria | 48 |

| Tecnologia | 43 |

| Vedere al dettaglio | 31 |

| Istruzione | 27 |

| Servizi finanziari | 22 |

| Costruzione | 20 |

| Non-profit | 19 |

| Utilità | 9 |

Nel manifatturiero, il furto di IP e distinte base consente cloni di prodotto e spionaggio industriale, oltre a blocchi di MES/MOM tramite ransomware. Nella PA, l’accesso a portali cittadini e repository documentali mette a rischio privacy e continuità dei servizi. Nella sanità, la sottrazione di cartelle cliniche unita a ricatti viola dignità e confidenzialità dei pazienti, con impatti legali e reputazionali amplificati. La campagna EvilAI colpisce in particolare catene dove app fake si travestono da software di produttività o da viewer di immagini diagnostiche.

Protezione dei dati e proprietà intellettuale

Il caso LunaLock evidenzia la necessità di classificare i dati per sensibilità e imporre controlli di accesso coerenti. Repository di asset creativi richiedono watermark invisibili, fingerprinting dei file, tokenization e cifratura at-rest con HSM per la protezione delle chiavi. I contratti devono prevedere clausole contro l’uso dei dati in training IA non autorizzato, con audit trail che documenti l’accesso e la catena di custodia. Meccanismi di opt-out e consenso tracciato difendono creator e aziende da addestramento improprio di modelli.

Rilevamento e risposta: strumenti e telemetrie

Un EDR moderno con analisi comportamentale e modelli IA difensivi individua sequence di eventi anomali più che singole firme. Il SIEM deve ricevere telemetria ricca: process tree, modifiche al registry, aperture di socket insoliti, DNS generati, uso anomalo di API critiche, e log da proxy e CASB per correlare download sospetti. L’NDR osserva lateral movement e trasferimenti TLS con JA3/JA4 atipici. I playbook IR devono includere contenimento rapido, revoca dei token, isolamento della macchina, acquisizione volatile, scansione di rete mirata e ripristino da backup immutabili con test periodici.

Governance, compliance e quadro normativo

La risposta operativa deve allinearsi a GDPR su notifica entro 72 ore, minimizzazione dei dati e responsabilizzazione dei ruoli. L’AI Act europeo impone trasparenza e controlli per sistemi high-risk; le aziende che impiegano IA devono documentare dataset e processi di addestramento, includendo valutazioni d’impatto (DPIA) quando il trattamento incide su diritti degli interessati. Le autorità e CERT-AGID diffondono alert e indicatori per accelerare patch e rotazioni di segreti. L’inadempienza espone a sanzioni e danni d’immagine difficili da recuperare.

Architetture difensive e zero trust

L’adozione di zero trust riduce la superficie utile agli attaccanti. Ogni richiesta deve essere autenticata, autorizzata e ispezionata in base al contesto. La MFA resistente al phishing (FIDO2/U2F) va estesa a ruoli privilegiati e account di servizio, rimuovendo MFA via SMS nei flussi critici. La segmentazione rete tramite SDN e micro-segmentation limita il lateral movement. I segreti passano per vault con rotazione automatica, scope minimi e scadenze brevi. La cifratura in-transit e at-rest con TLS 1.3, AES-GCM e gestione chiavi centralizzata preserva confidenzialità e integrità.

Preparazione organizzativa e formazione

La consapevolezza è decisiva contro vishing e app fake. Programmi di awareness basati su simulazioni realistiche allenano il personale a riconoscere segnali deboli: richieste di approvazione OAuth, installazioni fuori processo, urgenza artificiale. I runbook stabiliscono chi fa cosa nei primi minuti, dettagliano contatti legali e PR, distinguono tra incident e breach. La funzione HR coordina sostegno alle vittime interne, mentre il Comitato Rischi allinea priorità e budget sulla base di metriche oggettive.

Roadmap operativa 0–90 giorni

Nei primi trenta giorni, le aziende devono inventariare i flussi di installazione, eliminare app non firmate, imporre allowlist per software e abilitare telemetria avanzata su endpoint e proxy. Tra 30 e 60 giorni, occorre espandere i casi d’uso SIEM con rilevazioni comportamentali, introdurre sandbox cloud per analisi di payload e completare la MFA FIDO2 sui ruoli chiave. Entro 90 giorni, la segmentazione deve essere operativa, i backup devono risultare testati con ripristini cronometrici, e i contratti con fornitori devono includere clausole IA e SLA su revoca token e notifiche.

Proprietà intellettuale e creativi digitali: difese pratiche

Per piattaforme e studi creativi è essenziale convertire asset in formati con watermark, distribuire preview degradate e custodire i master in storage segregati con accesso Just-In-Time. I progetti collaborativi devono passare per spazi isolati con policy di esportazione e registri di download. Gli smart contract e la blockchain possono attestare paternità e licenze, mentre filtri AI interni verificano somiglianze sospette tra output e database proprietari.

Difesa con IA: quando l’algoritmo aiuta davvero

L’uso di IA difensiva è efficace se alimentato da telemetria pulita e feedback umano. Modelli per anomaly detection individuano beaconing a bassa frequenza, DGA e sequenze di eventi atipiche su processi e rete. Model governance e explainability consentono audit e riducono falsi positivi. Il SOC deve integrare IA nell’orchestrazione per contenimenti automatici a basso impatto, lasciando ai threat hunter la ricerca di TTP emergenti.

Ecosistema e collaborazione pubblico-privato

Le alleanze tra ISAC, vendor e CERT favoriscono condivisione di indicatori, strumenti gratuiti e playbook aggiornati. Le aziende che partecipano attivamente ricevono segnali precoci, riducono il tempo di reazione e beneficiano di analisi forensi condivise. La trasparenza su leak e timeline preserva fiducia di clienti e regolatori, soprattutto quando la campagna mediatica rischia di amplificare l’impatto.

Prospettive e tendenze a breve

Nei prossimi mesi, l’IA generativa alimenterà deepfake per BEC e truffe più convincenti; l’uso di modelli locali renderà più semplice automatizzare post-exploitation e movement in rete. Lato difesa, crescerà l’adozione di scanner IA per rilevare pattern di codice sospetti, la tokenization a protezione dei dati sensibili e l’interesse per crittografie post-quantum per future migrazioni. La maturità si misurerà sulla capacità di ridurre attrito nelle difese senza sacrificare l’esperienza utente. La riduzione del rischio richiede tre pilastri coordinati. Il primo è l’identity hardening: MFA FIDO2 per admin e owner di integrazioni, policy IP restrittive, rotazione dei token con scadenze brevi e least privilege su ruoli e permessi. Il secondo è la telemetria utile: EDR con analisi comportamentale, SIEM popolato da log endpoint, proxy, DNS, CASB e cloud, NDR su dorsali critiche e sandbox per analisi di payload e URL. Il terzo è l’architettura: zero trust, segmentazione con micro-segmenti, vault dei segreti, backup immutabili e piani DR testati. Per i casi LunaLock ed EvilAI le azioni immediate sono bloccare installazioni non firmate, vietare approvazioni OAuth al telefono, validare hash e firma di ogni aggiornamento, rimuovere persistence note e bonificare workstation con immagini golden. La combinazione di prevenzione, rilevamento comportamentale e risposta orchestrata consente di troncare la catena di attacco e proteggere IP, dati personali e operatività anche contro avversari che sfruttano IA su larga scala.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.