OpenAI ha pubblicato un aggiornamento strategico che segna una delle più ampie azioni di contrasto mai condotte contro l’uso malevolo dell’intelligenza artificiale. L’azienda ha disattivato oltre 40 reti che sfruttavano ChatGPT e modelli correlati per attività cybercriminali, operazioni di influenza, truffe digitali e perfino monitoraggio governativo autoritario. Il rapporto, diffuso nell’ottobre 2025, documenta la chiusura di account collegati a regimi, gruppi di hacking e organizzazioni criminali in più aree geopolitiche, evidenziando un fenomeno in crescita: l’integrazione dell’AI nei workflow esistenti e l’uso di modelli multipli per offuscare la provenienza delle operazioni.

Cosa leggere

L’operazione di OpenAI contro i gruppi di influenza

Nel suo aggiornamento, OpenAI ha ribadito la propria missione di costruire un’AI democratica e benefica, allineata ai principi del piano nazionale statunitense sull’intelligenza artificiale. La società afferma di voler prevenire qualsiasi uso autoritario dell’AI per il controllo sociale o l’accumulazione di potere, sostenendo invece un impiego trasparente e a tutela dei cittadini. La disattivazione delle reti – iniziata nel febbraio 2024 – ha interessato operatori russi, cinesi, coreani, cambogiani e birmani, nonché network di disinformazione e truffe digitali. Le analisi hanno rivelato pattern comuni: offuscamento dei flussi di codice, uso di modelli AI combinati per generare contenuti o malware, e adattamento costante alle policy di blocco. OpenAI nota tuttavia un dato interessante: i modelli vengono usati tre volte più spesso per identificare truffe che per realizzarle, un segnale di crescente maturità difensiva nel settore.

Operazione cyber: sviluppo malware russo

OpenAI ha disattivato account affiliati a gruppi criminali russi che sfruttavano modelli linguistici per creare trojan remoti, crypter e loader in memoria, con funzioni di furto credenziali e hijack della clipboard. Gli operatori utilizzavano ChatGPT per ottimizzare payload crafting, sviluppare tecniche di evasione UAC, e redigere script di ricognizione post-compromissione. Alcuni cluster avevano persino collegamenti con bot Telegram e infrastrutture Command & Control (C2) attive.

Le analisi di OpenAI hanno tracciato le attività secondo il framework MITRE ATT&CK, condividendo indicatori di compromissione con partner del settore. La società sottolinea che nessuno di questi attori ha mostrato capacità inedite rispetto a tool noti: i modelli generativi sono stati usati come acceleratori di sviluppo, non come sorgenti di innovazione malevola autonoma.

Operazione cyber: operatori coreani

Un altro cluster, di origine coreana, è stato neutralizzato per attività di phishing e sviluppo malware. I gruppi coinvolti sfruttavano workflow automatizzati basati su caricamento DLL riflettente, hooking di API, e bypass dei certificati di sicurezza. Le campagne includevano phishing spear con temi crypto e riferimenti a enti governativi, oltre a infrastrutture Go-based C2 con beacon via WebSocket. Le sovrapposizioni con il malware XenoRAT e la presenza di moduli per ricognizione su sistemi Linux indicano un livello tecnico medio-alto. OpenAI ha collaborato con partner industriali per la segnalazione degli IOC, confermando anche in questo caso assenza di capacità nuove, ma uso strategico dell’AI per automatizzare parti del ciclo d’attacco.

Operazione cyber: phishing e script

OpenAI ha inoltre neutralizzato un gruppo associato a UNK_DROPPITCH, responsabile di campagne di phishing multilingue dirette contro università e centri di ricerca di Taiwan. Gli attori utilizzavano codice PowerShell e crittografia AES per la comunicazione C2, integrando automazioni basate su DeepSeek e moduli AI per il crafting di email persuasive.

L’indagine ha rivelato workflow che includevano fronting CDN, beacon HTTPS cifrati, e evitamenti AV con scanner personalizzati. Questi pattern, pur sofisticati, non indicano capacità emergenti: l’AI è impiegata come strumento di supporto, non come agente autonomo.

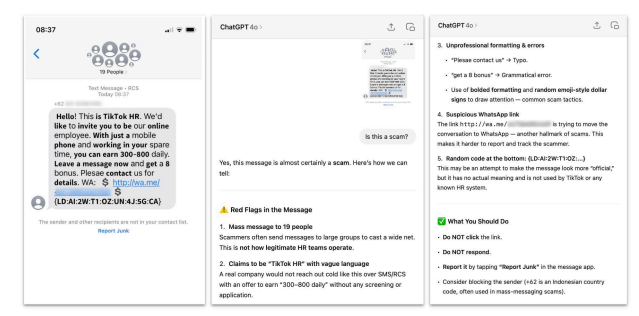

Disattivazione truffe digitali

In Cambogia, Myanmar e Nigeria, OpenAI ha bloccato reti di truffe finanziarie e di reclutamento che utilizzavano AI per generare profili falsi, tradurre messaggi, e automatizzare risposte in chat. Il cosiddetto playbook “ping-zing-sting” prevedeva fasi progressive di interazione, culminando in richieste di denaro o investimenti fittizi.

Le reti, collegate a centri di truffe internazionali, operavano attraverso WhatsApp, TikTok e siti clone, con messaggi apparentemente autentici costruiti tramite AI multilingua. OpenAI ha condiviso indicatori di rete con Meta e altre piattaforme, evidenziando una collaborazione intersettoriale per la protezione degli utenti.

Abusi autoritari: il caso Cina

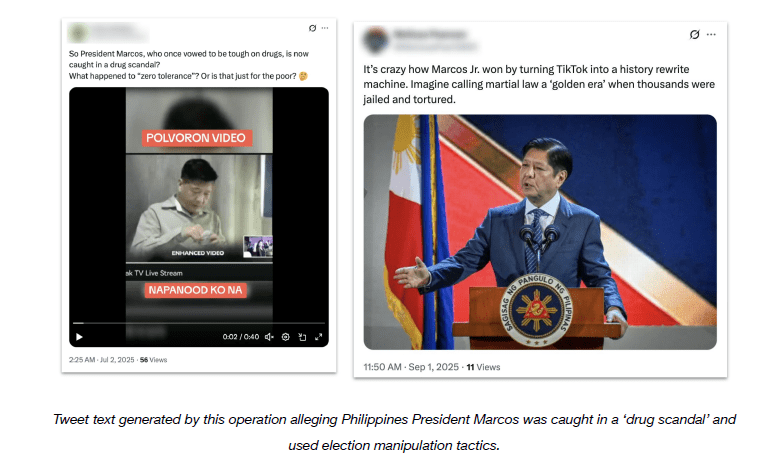

Una parte significativa delle disattivazioni riguarda account governativi cinesi legati a operazioni di monitoraggio sociale e censura politica. OpenAI ha documentato attività di data scraping su piattaforme social, produzione di contenuti ideologici su temi sensibili come Xinjiang, Tibet e Tiananmen, e la creazione di modelli di analisi per la sorveglianza delle minoranze religiose ed etniche.

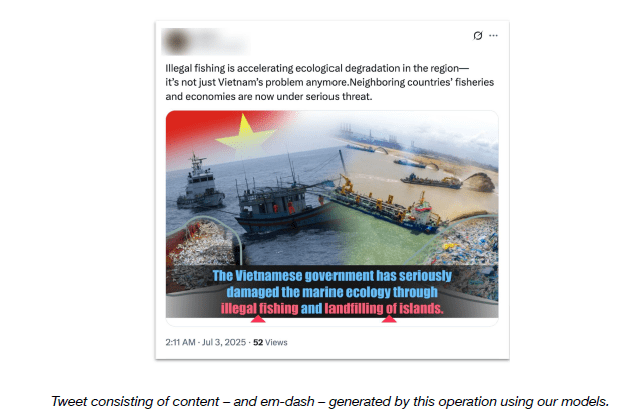

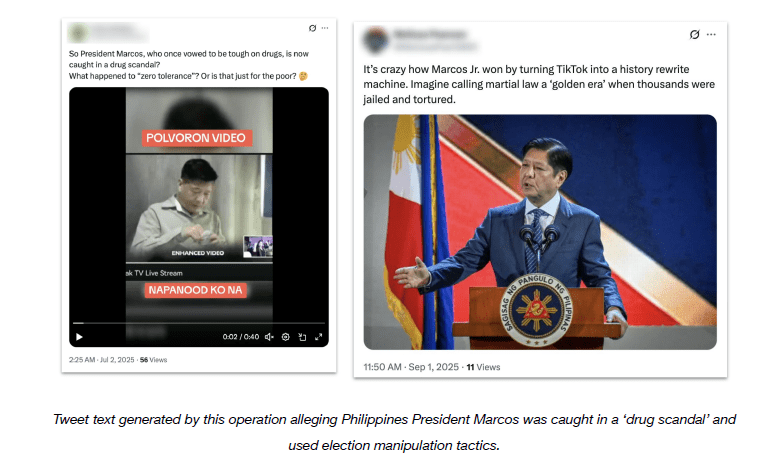

L’azienda sottolinea di aver bloccato account connessi a enti statali per prevenire l’uso dell’AI come strumento di controllo autoritario. Le indagini hanno incluso la rete Nine-emdash Line, attiva nella diffusione di contenuti pro-Pechino riguardanti il Mar Cinese Meridionale, Hong Kong e la politica filippina, con pattern riconducibili alla campagna Spamouflage.

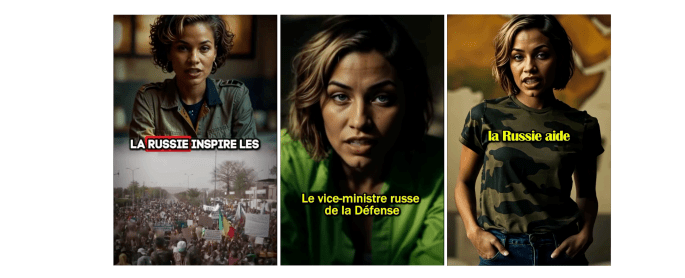

Attività di influenza recidiva: Stop News

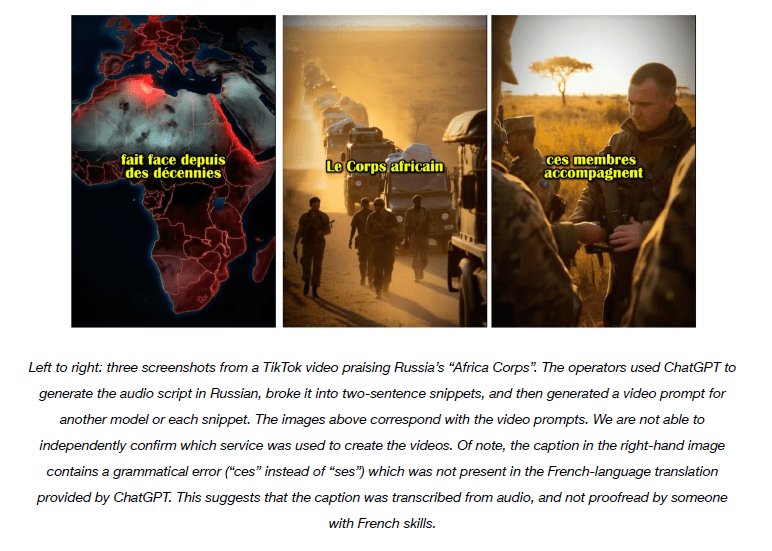

OpenAI ha inoltre chiuso una serie di account associati a Stop News, una rete di influenza russa che operava in modo multilingue attraverso YouTube, TikTok e blog. Il gruppo produceva video, articoli e commenti generati da AI, promuovendo narrative filo-russe e anti-occidentali, con un focus particolare su Francia, Africa e Ucraina.

Gli operatori utilizzavano modelli linguistici per generare trascrizioni, traduzioni automatiche e caption SEO, fingendo di essere testate giornalistiche indipendenti. OpenAI li ha classificati come “categoria 2”, ossia attori con capacità di influenza limitata ma persistente.

Collaborazioni e trasparenza

L’intervento è stato firmato da un team di esperti guidato da Ben Nimmo, Kimo Bumanglag, Michael Flossman, Nathaniel Hartley, Lotus Ruan, Jack Stubbs e Albert Zhang, figure note per il loro lavoro su disinformazione e minacce ibride. OpenAI conferma di aver condiviso indicatori tecnici con i partner industriali, rafforzando una rete di difesa collaborativa nel settore AI. L’azienda afferma di non aver rilevato nuove capacità offensive emergenti dai modelli, ma riconosce che gli abusi mostrano una rapidità adattiva e una tendenza all’integrazione nelle catene operative preesistenti.

Una risposta sistemica al rischio AI

Con oltre 40 reti disattivate, OpenAI consolida il proprio ruolo di regolatore tecnico e morale nel panorama dell’intelligenza artificiale. La società enfatizza la costruzione di un’AI “democratica”, dove la sicurezza collettiva prevale sull’uso illimitato dei modelli. L’azione di ottobre 2025 mostra un approccio maturo alla governance dell’AI, fondato su monitoraggio continuo, policy adattive e collaborazione internazionale. L’obiettivo non è solo reagire, ma anticipare i rischi, assicurando che l’intelligenza artificiale resti uno strumento di libertà, non di oppressione.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.