Sicurezza Informatica

Intelligenza Artificiale e guerra: come si muove il mondo

Tempo di lettura: 3 minuti. I Paesi devono risolvere le sfide dell’ondata di intelligenza artificiale per vincere guerre e conflitti negli anni 2030 e oltre.

Negli ultimi trent’anni le operazioni informatiche si sono evolute nell’ambito di guerre e conflitti importanti. Tuttavia, i militari moderni hanno faticato ad allineare le capacità informatiche avanzate con il potere militare convenzionale. Se le forze armate riusciranno a sfruttare appieno la prossima rivoluzione informatica nei potenziali punti di conflitto, potrebbero esserci enormi implicazioni per il futuro della guerra.

La principale fonte di vantaggio strategico nei prossimi 10 anni risiederà nella capacità delle organizzazioni militari di integrare pienamente le innovazioni in materia di intelligenza artificiale (AI), cyber power e scienza dei dati, scienza cognitiva e robotica a tutti i livelli delle operazioni militari. Questo processo darà il via alla prossima rivoluzione militare guidata dall’IA (AI RMA). L’AI RMA sarà fondamentalmente diversa dalle precedenti tecnologie informatiche o IT-RMA, in cui le capacità informatiche aumentavano ma non alteravano l’uso della forza.

I primi segnali dell’ondata di AI si stanno già manifestando. Il Data Analytics Centre dell’Unità 8200 della Forza di Difesa israeliana utilizza algoritmi di apprendimento automatico per automatizzare il rilevamento delle minacce e identificare le anomalie in grandi serie di dati. Il Project Maven dell’esercito statunitense utilizza sistemi di IA per il supporto alle decisioni, il targeting e la pianificazione operativa. Possono elaborare una grande quantità di dati provenienti da diversi sensori di intelligence, sorveglianza e ricognizione. Le Forze Armate di Singapore (SAF) hanno recentemente istituito il Digital and Intelligence Service per integrare le capacità di intelligence militare, di difesa informatica e di operazioni informatiche della SAF in un ramo a servizio completo. L’armamento della guerra algoritmica probabilmente si evolverà ulteriormente con i rapidi progressi della scienza e della tecnologia. Le scienze dei dati e dell’informatica si stanno fondendo sempre più con le scienze comportamentali e si sovrappongono a quasi tutti gli aspetti della sicurezza informatica. La Defence Advanced Research Projects Agency (DARPA) statunitense ha investito ingenti risorse nel Next-Generation Nonsurgical Neurotechnology Programme. L’investimento mira a sviluppare interfacce cervello-macchina che consentano il controllo di veicoli aerei senza pilota e di sistemi di difesa informatica attiva.

Nei conflitti futuri, i militari moderni impareranno ad applicare diverse capacità informatiche abilitate dall’intelligenza artificiale per colpire le infrastrutture critiche dell’avversario. Si infiltreranno anche nelle reti e nei centri dati dei concorrenti per manipolare gli algoritmi o corrompere i dati. La ricerca sulle capacità dell’IA avversaria è in crescita e si concentra su come ingannare i sistemi di IA e indurli a fare previsioni sbagliate generando dati falsi. Gli algoritmi saranno sempre più utilizzati per rilevare la disinformazione e l’informazione errata nei social media, individuare i bot intelligenti, i falsi profondi e le vulnerabilità della sicurezza biometrica. L’ondata di AI sarà applicabile in quasi tutti gli aspetti della guerra. L’IA può essere applicata al supporto decisionale di comando e controllo, consigliando opzioni in tempi ristretti. Può essere utilizzata per il supporto all’intelligence, alla sorveglianza e alla ricognizione attraverso capacità di data mining e per rilevare e contrastare attacchi informatici avanzati. L’IA può essere integrata nella robotica e nei sistemi autonomi, come i droni, che combinano le diverse piattaforme con e senza equipaggio.

Mentre l’ondata dell’IA potrebbe colpire in modo sproporzionato alcuni Paesi e militari, il suo impatto sull’uso della forza potrebbe essere significativo ma difficile da prevedere nelle fasi iniziali. Tuttavia, l’impatto strategico a lungo termine dell’ondata di intelligenza artificiale nei conflitti futuri è sufficientemente ampio da richiedere un ripensamento della pianificazione e della gestione della politica di difesa, compreso lo sviluppo e la ricerca e sviluppo di armi. La direzione e il carattere dell’ondata di IA saranno modellati principalmente dal modo in cui le tecnologie emergenti interagiranno con le strutture operative e le forze armate attuali e future. Lo dimostrano le sfide che l’esercito russo ha dovuto affrontare nell’uso dei suoi sistemi militari abilitati all’IA, comprese le capacità informatiche, nella guerra in Ucraina.

La sfida principale per l’attuazione dell’ondata di IA è una riprogettazione totale delle strategie e delle dottrine di comando, controllo, comunicazione, computer, intelligence, sorveglianza e ricognizione (C4ISR). Un ambiente operativo completamente nuovo e nuove tecnologie richiederanno una nuova mentalità ad ogni livello dell’organizzazione militare. Le forze armate devono anche confrontarsi con le implicazioni legali ed etiche delle nuove tecnologie di armamento e con i problemi di codifica dei diversi valori di sicurezza, etica e governance in questi sistemi. L’integrazione dei flussi di dati e dei sistemi di intelligenza artificiale in diverse piattaforme militari richiederà algoritmi affidabili, in grado di adattarsi ai cambiamenti dell’ambiente e di imparare da eventi imprevisti. Inoltre, sarà necessario progettare codici etici e salvaguardie per questi sistemi.

Costruire una tabella di marcia valida per le forze armate tradizionali per incorporare le tecnologie dirompenti sarà un compito difficile. Sebbene molti eserciti avanzati possano sforzarsi di progettare e implementare diversi percorsi di digitalizzazione, solo alcuni avranno la visione, le risorse e la volontà di riuscirci. Il divario tra “chi ha” e “chi non ha” nelle capacità militari dei vari Paesi probabilmente aumenterà ulteriormente. Questo divario avrà un impatto sulla futura interoperabilità all’interno delle alleanze militari e dei partenariati di sicurezza, a seconda di come le nuove tecnologie interagiranno con le interfacce operative e le strutture delle forze attuali ed emergenti.

Sicurezza Informatica

Apple estende riparazione Zero-Day di iOS ai vecchi iPhone

Tempo di lettura: 2 minuti. Apple ha esteso le patch di sicurezza per un zero-day di iOS ai vecchi modelli di iPhone e iPad, affrontando una vulnerabilità critica nel kernel.

Apple ha recentemente esteso le patch di sicurezza, originariamente rilasciate a marzo, ai modelli più vecchi di iPhone e iPad, affrontando una vulnerabilità zero-day nel kernel di iOS. Questo aggiornamento riguarda una falla critica nel sistema operativo in tempo reale RTKit di Apple, che era stata segnalata come attivamente sfruttata in attacchi.

Dettagli sulla Vulnerabilità

La vulnerabilità, identificata come CVE-2024-23296, è una questione di corruzione della memoria che permette agli aggressori di leggere e scrivere arbitrariamente nella memoria del kernel, eludendo le protezioni della memoria del kernel. Inizialmente, questa patch era stata applicata solo ai nuovi modelli di iPhone, iPad e Mac il 5 marzo. Ora, Apple ha esteso queste importanti aggiornate di sicurezza anche ai dispositivi più datati, come iPhone 8, iPhone 8 Plus, iPhone X, e alcuni modelli di iPad.

Aggiornamenti implementati

Le versioni aggiornate, iOS 16.7.8 e iPadOS 16.7.8, insieme a macOS Ventura 13.6.7, includono miglioramenti nella validazione degli input per mitigare questa vulnerabilità. Apple ha consigliato a tutti gli utenti dei dispositivi interessati di installare immediatamente gli aggiornamenti per proteggersi da potenziali tentativi di sfruttamento.

Implicazioni e consigli

Nonostante Apple non abbia rivelato chi ha scoperto la vulnerabilità né dettagli sugli attacchi che la sfruttavano, è noto che le vulnerabilità zero-day di iOS sono spesso utilizzate in attacchi di spyware sponsorizzati da stati contro individui ad alto rischio, come giornalisti o politici dell’opposizione. Data la natura mirata di questi attacchi, è cruciale che tutti gli utenti interessati aggiornino i loro dispositivi il prima possibile.

L’iniziativa di Apple di applicare queste patch di sicurezza ai dispositivi più vecchi dimostra un impegno continuo a mantenere la sicurezza across tutte le versioni del suo ecosistema. Gli utenti di vecchi dispositivi Apple possono ora beneficiare delle stesse protezioni dei modelli più recenti, assicurando che la loro sicurezza digitale rimanga robusta contro minacce emergenti. Questo aggiornamento sottolinea l’importanza della vigilanza e della prontezza nella gestione della sicurezza informatica, ribadendo il bisogno di risposte rapide e efficaci a minacce che evolvono costantemente.

Sicurezza Informatica

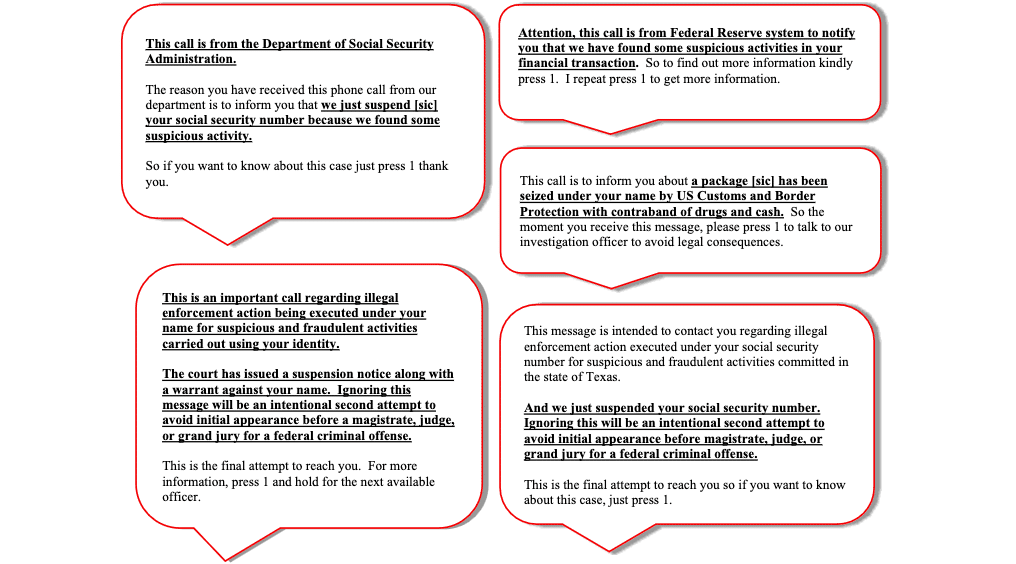

FCC etichetta “Royal Tiger” come primo attore di minaccia Robocall

Tempo di lettura: 2 minuti. La FCC ha designato “Royal Tiger” come primo attore di minaccia robocall, sottolineando il suo ruolo in frodi e campagne di truffa

La Federal Communications Commission (FCC) ha identificato “Royal Tiger” come primo attore di minaccia ufficialmente etichettato nel contesto delle campagne di robocall dannose. Questo gruppo, operativo tra India, Regno Unito, Emirati Arabi Uniti e Stati Uniti, è noto per le sue chiamate automatisate che impersonano enti governativi e banche, spesso ingannando i consumatori con false promesse legate a riduzioni dei tassi delle carte di credito.

Dettagli sull’Operazione di Royal Tiger

Royal Tiger è stato condotto da Prince Jashvantlal Anand e il suo associato Kaushal Bhavsar. Questo gruppo gestisce entità multiple negli Stati Uniti, incluse compagnie di VoIP come Illum Telecommunication Limited, PZ Telecommunication LLC e One Eye LLC. Queste organizzazioni hanno collaborato con la Great Choice Telecom, basata in Texas, che in precedenza è stata oggetto di un ordine di confisca di $225 milioni e di lettere di cessazione e desistenza sia dalla FCC che dalla Federal Trade Commission (FTC) per le sue attività illegali di robocall.

Sistema di Classificazione dei Bad Actors della FCC

La FCC ha sviluppato il sistema di classificazione Consumer Communications Information Services Threat (C-CIST) per aiutare le controparti regolatorie statali, federali e internazionali, oltre alle forze dell’ordine, a identificare e tracciare gli attori di minaccia che abusano delle infrastrutture di telecomunicazioni. Questo sistema facilita l’adozione di azioni appropriate contro tali minacce.

Potenziali Azioni di Enforcement

Le azioni di enforcement contro gruppi come Royal Tiger possono includere lettere di cessazione e desistenza, rimozione dal Robocall Mitigation Database e ordini di confisca. Queste misure sono essenziali per prevenire l’accesso di questi gruppi di minacce allo spazio delle telecomunicazioni degli Stati Uniti e proteggere i consumatori dalle frodi.

Con l’identificazione di Royal Tiger, la FCC rafforza il suo impegno a combattere le frodi legate ai robocall, mirando a eliminare queste molestie e truffe che colpiscono milioni di americani ogni anno. Questa classificazione aiuta anche le forze dell’ordine e il settore a considerare Royal Tiger una minaccia significativa per i servizi di informazione delle comunicazioni. Questo sforzo della FCC dimostra un passo importante verso l’eliminazione delle pratiche fraudolente che sfruttano le telecomunicazioni per perpetrare vasti schemi di truffa e abuso.

Sicurezza Informatica

Nuovo attacco malware via steganografia su PyPI

Tempo di lettura: 2 minuti. Un attacco malware su PyPI nasconde un binario malevolo in un’immagine PNG, mettendo in evidenza nuove tecniche di steganografia e rischi di sicurezza.

Un recente attacco malware su Python Package Index (PyPI) ha sollevato preoccupazioni sulla sicurezza delle librerie open source. Il pacchetto in questione, requests-darwin-lite, è stato scoperto da Phylum, utilizzando un approccio sofisticato di steganografia per nascondere un binario Go malevolo all’interno di un’immagine PNG.

Dettagli dell’Attacco

Il pacchetto requests-darwin-lite mirava specificamente agli utenti di macOS, modificando il processo di installazione per eseguire codice arbitrario tramite una classe PyInstall modificata nel file setup.py. Questa classe era programmata per decodificare e eseguire comandi nascosti in una stringa codificata in base64, solamente se il sistema corrispondeva a un UUID specifico. Il binario Go era nascosto all’interno di un’immagine PNG sovradimensionata, apparentemente innocua, che era molto più grande del normale.

Tecniche di Steganografia Usate

L’attacco utilizzava tecniche di steganografia, nascondendo dati binari all’interno di un file immagine PNG senza alterarne la visualizzazione normale. L’immagine, pur funzionando come un logo legittimo, conteneva dati malevoli alla fine del file, che venivano estratti e eseguiti durante l’installazione del pacchetto.

Risposta e Misure di Sicurezza

Phylum ha immediatamente segnalato la scoperta a PyPI, che ha prontamente rimosso il pacchetto e tutte le sue versioni. Questo incidente sottolinea l’importanza di un’attenta verifica del codice e delle dipendenze, soprattutto in ambienti open source dove il codice può essere facilmente manipolato da attori malevoli.

Questo attacco evidenzia una crescente sofisticatezza nelle tecniche utilizzate dagli attaccanti per sfruttare le piattaforme di distribuzione di software. Gli sviluppatori e gli utenti di sistemi basati su pacchetti devono essere estremamente vigilanti e implementare robuste misure di sicurezza e verifiche per proteggere le infrastrutture software dai malware. Questo caso di malware tramite PyPI è un chiaro promemoria dei rischi associati alle librerie e dipendenze open source e della necessità di adottare pratiche di sicurezza informatica avanzate e continue verifiche del codice.

Editoriali2 settimane fa

Editoriali2 settimane faChip e smartphone cinesi ci avvisano del declino Occidentale

Inchieste1 settimana fa

Inchieste1 settimana faRansomware in Italia: come cambia la percezione del fenomeno nell’IT

Economia2 settimane fa

Economia2 settimane faInternet via satellite: progetto europeo IRIS² in grande difficoltà

Editoriali1 settimana fa

Editoriali1 settimana faAnche su Giovanna Pedretti avevamo ragione

L'Altra Bolla1 settimana fa

L'Altra Bolla1 settimana faJack Dorsey getta la spugna e lascia Bluesky

Inchieste1 settimana fa

Inchieste1 settimana faPerchè il motore di ricerca OpenAI fa paura ai giornalisti?

Smartphone1 settimana fa

Smartphone1 settimana faRichiesta di Class Action contro Samsung per il Galaxy S24 Ultra

L'Altra Bolla7 giorni fa

L'Altra Bolla7 giorni faMeta arriva l’intelligenza artificiale per la Pubblicità