Sommario

Samsung Electronics, leader mondiale nella tecnologia dei semiconduttori, ha introdotto due nuovi sensori della serie ISOCELL Vizion: il sensore time-of-flight (ToF) ISOCELL Vizion 63D e il sensore a otturatore globale ISOCELL Vizion 931. Questi sensori sono stati progettati specificamente per migliorare le capacità visive in un’ampia gamma di applicazioni mobili, commerciali e industriali di nuova generazione.

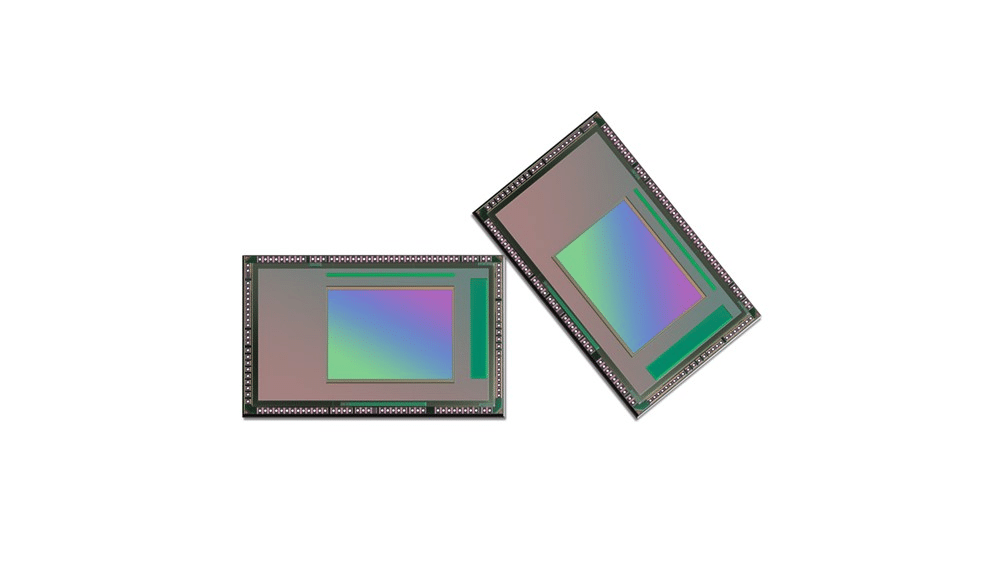

ISOCELL Vizion 63D: Sensore ToF per Immagini 3D ad Alta Risoluzione

Il sensore ISOCELL Vizion 63D è un sensore iToF (indirect ToF) che misura lo spostamento di fase tra la luce emessa e quella riflessa per rilevare gli oggetti in tre dimensioni. Con una precisione e chiarezza eccezionali, il Vizion 63D è ideale per robot di servizio e industriali, dispositivi XR e autenticazione facciale, dove sono cruciali misurazioni di profondità precise e ad alta risoluzione.

Il Vizion 63D è il primo sensore iToF del settore con un processore di segnale di immagine (ISP) integrato per la rilevazione della profondità, consentendo una riduzione fino al 40% del consumo energetico del sistema rispetto al precedente prodotto ISOCELL Vizion 33D. Il sensore può elaborare immagini fino a 60 fotogrammi al secondo in risoluzione QVGA (320×240), una risoluzione molto richiesta nei mercati commerciali e industriali.

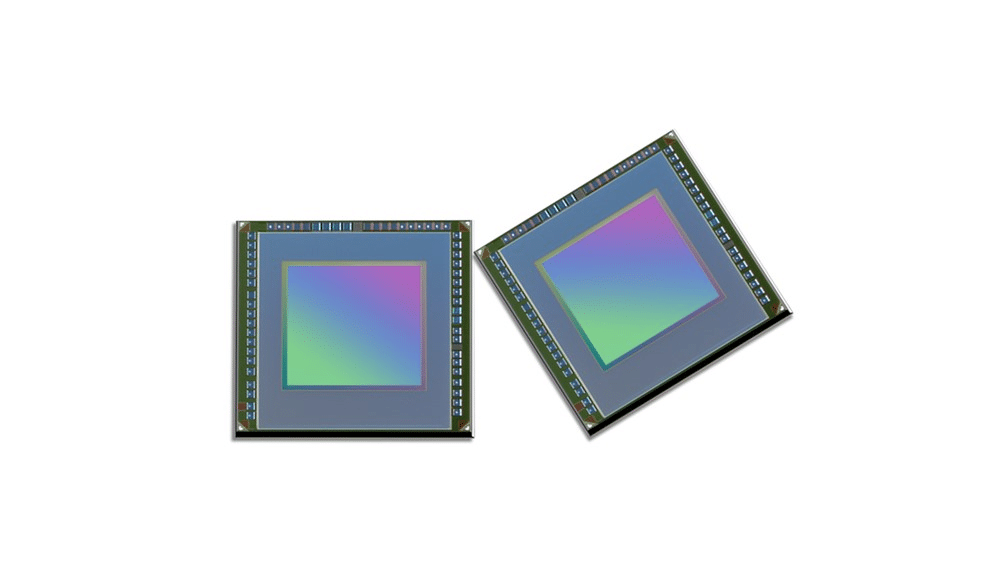

ISOCELL Vizion 931: Sensore a Otturatore Globale per Movimenti Dinamici

Il sensore ISOCELL Vizion 931 è un sensore a otturatore globale progettato per catturare movimenti rapidi senza distorsioni. A differenza dei sensori a otturatore rotante, che acquisiscono la scena linea per linea, l’otturatore globale cattura l’intera scena contemporaneamente, consentendo al Vizion 931 di catturare immagini nitide e non distorte di oggetti in movimento. Questo lo rende adatto per il tracciamento dei movimenti in dispositivi XR, sistemi di gioco, robot di servizio e logistica, nonché droni.

Progettato con una risoluzione VGA (640 x 640) in un rapporto uno a uno, il Vizion 931 è ottimale per il riconoscimento dell’iride, il tracciamento degli occhi e il rilevamento facciale e gestuale in dispositivi come gli headset XR. Il Vizion 931 raggiunge anche il livello più alto di efficienza quantica del settore, con un impressionante 60% a una lunghezza d’onda della luce infrarossa di 850 nm.

Conclusione e Disponibilità

I sensori Samsung ISOCELL Vizion 63D e ISOCELL Vizion 931 sono attualmente in fase di campionamento per gli OEM in tutto il mondo, promettendo di rivoluzionare il campo della robotica e delle applicazioni XR con le loro capacità avanzate di cattura delle immagini.