Nel panorama in continua evoluzione dell’intelligenza artificiale, OpenAI affronta un passaggio critico nella sua strategia: rimuove una funzione pericolosa da ChatGPT, accusata di esporre i dati degli utenti nei risultati dei motori di ricerca, e si prepara al lancio di GPT-5, il nuovo modello avanzato che promette una significativa evoluzione in termini di capacità, versatilità e privacy. In parallelo, la competizione con Anthropic si intensifica: secondo quanto riportato, alcuni ingegneri OpenAI avrebbero utilizzato l’AI Claude per migliorare GPT-5. OpenAI rafforza la sicurezza e si appresta a rilasciare nuovi modelli open-weight su HuggingFace, rendendo l’ecosistema più accessibile. La nuova offerta ChatGPT Go a basso costo completerà la gamma di abbonamenti. Il 2025 si profila come un anno chiave per ridefinire i confini tra usabilità, sicurezza e etica AI.

Cosa leggere

Rimozione funzioni privacy in ChatGPT

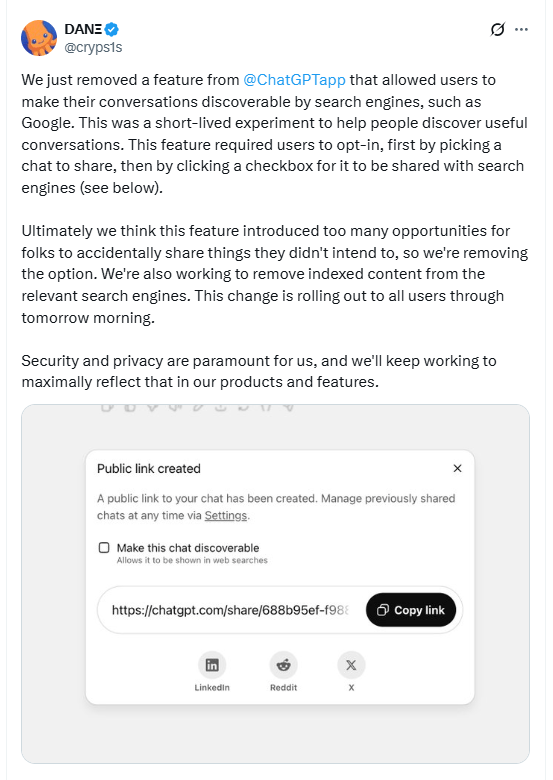

OpenAI ha rimosso la funzione di indicizzazione pubblica delle conversazioni ChatGPT, dopo un esperimento definito “breve” ma potenzialmente pericoloso. La funzione consentiva di condividere link pubblici, i quali venivano poi scoperti e indicizzati da Google. Molti utenti, ignari del rischio, hanno diffuso dati personali in conversazioni che sono finite tra i risultati del motore di ricerca.

L’annuncio è arrivato su X dal CISO di OpenAI Dane Stuckey, che ha confermato il rollout immediato della rimozione. Secondo OpenAI, l’opzione, seppur opt-in, era una “footgun” per il doxing”. La funzione non era stata annunciata pubblicamente in modo chiaro, e la community ha sollevato critiche per la mancanza di documentazione e guide all’uso. La rimozione segna una svolta verso un approccio privacy-first. OpenAI sta implementando filtri avanzati, rafforzando l’interfaccia utente per evitare abusi, e disattivando anche opzioni simili di self-doxing. I dati raccolti sono oggetto di revisione e i contenuti già indicizzati saranno rimossi progressivamente. In parallelo, l’azienda affronta cause legali, come quella del New York Times, che riguardano la conservazione dei dati utente. La rimozione della funzione di condivisione pubblica è vista come una risposta tecnica e politica a questi rischi. OpenAI ha inoltre rafforzato i propri team di sicurezza, intensificato gli audit interni e integrato crittografia nei sistemi di archiviazione, in continuità con il ritiro e la revisione della funzione Recall.

Preparativi per GPT-5

Il lancio di GPT-5 è previsto per la prossima settimana. Il nuovo modello rappresenta una convergenza delle innovazioni sviluppate nelle versioni precedenti. Le sue principali novità includono modalità reasoning alpha, capacità multimodali, un auto mode per task automatizzati e una nuova API denominata Operator-like, pensata per sviluppatori avanzati.

So before people take credit, I found the oai os a min after they uploaded and saved the config and other stuff before it was removed.

— Jimmy Apples ????/acc (@apples_jimmy) August 1, 2025

It’s an OS model and coming soon so kinda feels like ruining a surprise pic.twitter.com/0eqZfJ2rDm

Secondo OpenAI, GPT-5 sarà più efficiente, meno soggetto a allucinazioni, capace di integrare input vocali e visivi, e ottimizzato per l’uso in ambiti complessi. Il modello è già in fase di test interni, con collaborazione di beta tester selezionati. Le aziende partner saranno in grado di adattare il modello ai propri use case grazie a nuovi strumenti di fine-tuning. OpenAI sta inoltre lavorando per ridurre i costi di inferenza, offrendo prestazioni superiori con minori consumi di risorse. Il modello sarà disponibile attraverso API aggiornate, con strumenti per integrazione in applicazioni terze. GPT-5 segnerà anche un’evoluzione nella compliance GDPR e nella gestione dei dati sensibili, rafforzando le misure di resilienza contro prompt avversariali. L’azienda punta a consolidare la propria posizione nel mercato AI contro concorrenti come Google Gemini e Claude di Anthropic, ma enfatizzando un equilibrio tra potenza e sicurezza.

Modelli open-weight di OpenAI

Parallelamente al rilascio di GPT-5, OpenAI prepara il lancio di modelli open-weight come gpt-oss-20b e gpt-oss-120b, già comparsi in preview su HuggingFace. Questa apertura verso modelli a peso aperto rappresenta una svolta strategica, in contrasto con l’approccio storicamente chiuso di OpenAI. I modelli sono progettati per diversi tipi di impiego: gpt-oss-20b è destinato a carichi leggeri, mentre gpt-oss-120b mira a task complessi. Entrambi vengono distribuiti con licenze permissive, adatte anche all’uso commerciale, e sono compatibili con strumenti OSS. Lo scopo è abbattere le barriere di accesso per sviluppatori indipendenti, PMI e ricercatori. Gli utenti potranno effettuare fine-tuning locale, personalizzare i modelli per domini specifici, e testarne le performance attraverso benchmark pubblici. OpenAI intende così democratizzare l’AI, evitando fenomeni di vendor lock-in e frammentazione del mercato. L’adozione dei modelli open-weight è parte di una strategia di governance condivisa, che include anche forum di discussione, documentazione estesa e canali per il feedback continuo. In questo modo, OpenAI punta a rafforzare il proprio ecosistema e a contrastare l’ascesa di modelli open-source concorrenti, come LLaMA di Meta.

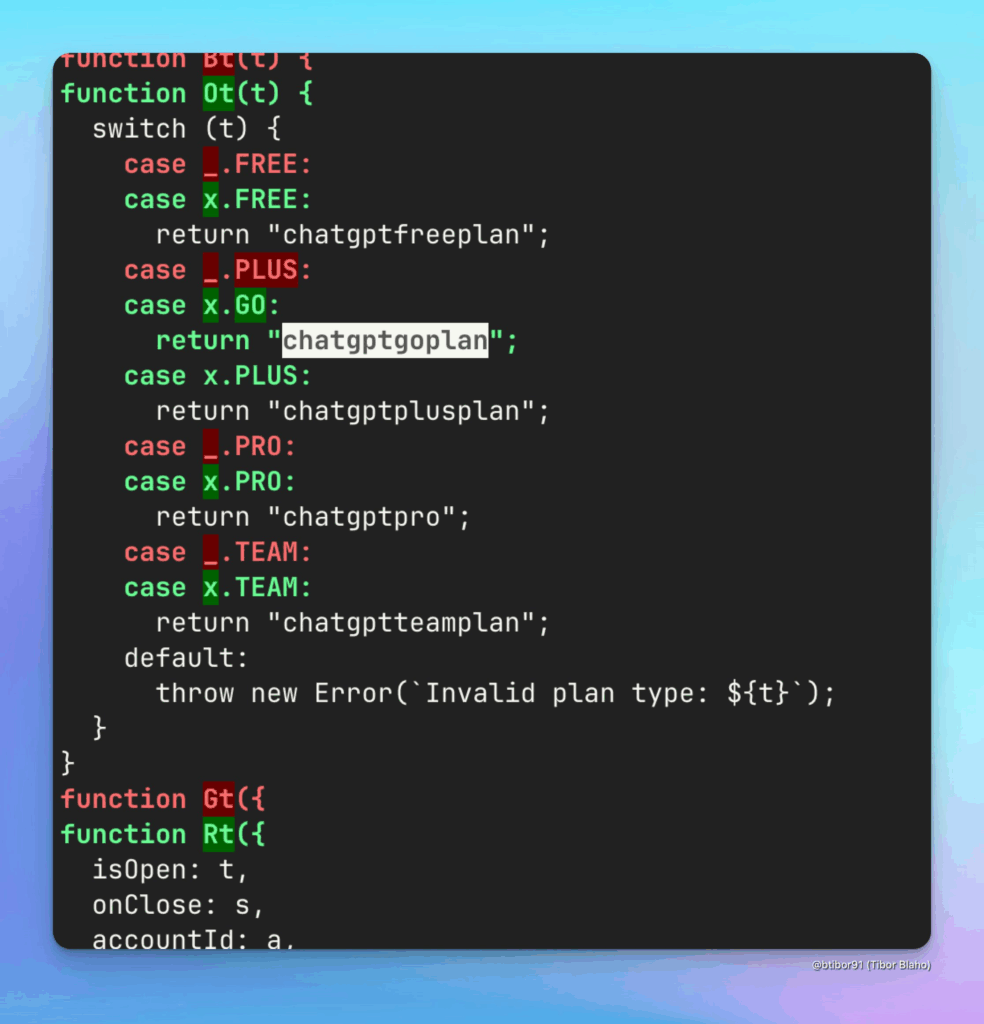

Nuova sottoscrizione ChatGPT Go

Insieme al rollout di GPT-5, OpenAI lancerà ChatGPT Go, un abbonamento da 9 euro al mese pensato per utenti che cercano funzionalità intermedie. La nuova offerta si posizionerà tra la versione gratuita e l’abbonamento Plus, escludendo l’accesso a GPT-4, ma includendo risposte più rapide e maggiori limiti di query. ChatGPT Go è progettato per utenti sensibili al prezzo, come studenti e piccole imprese, e mira ad aumentare la base utenti riducendo il churn rate. Il modello sarà anche meno pesante in termini di risorse, contribuendo a ridurre il carico sui server centrali. L’abbonamento intermedio integra un sistema di aggiornamenti regolari, sarà disponibile inizialmente in Europa, con piena conformità GDPR, e includerà funzionalità di moderazione dei contenuti. OpenAI prevede anche campagne promozionali per incentivare l’adozione e rafforzare i ricavi ricorrenti.

La scelta riflette la volontà di OpenAI di stratificare l’offerta commerciale, mantenendo accessibilità mentre si rafforza la monetizzazione dei servizi AI. ChatGPT Go rappresenta un compromesso tra qualità, privacy e prezzo.

Dinamiche competitive con Anthropic

La competizione tra OpenAI e Anthropic si intensifica dopo che quest’ultima ha revocato l’accesso API ad alcuni ingegneri OpenAI, accusandoli di utilizzare Claude Code per test e sviluppo interno. Secondo quanto riportato da Wired, i tecnici OpenAI avrebbero utilizzato Claude per attività avanzate di codifica web e infrastrutturale. Christopher Nulty, portavoce di Anthropic, ha confermato l’accaduto, sottolineando l’eccellenza di Claude nel coding, in particolare nelle applicazioni web. Il gesto ha innescato un ulteriore livello di rivalità tecnica, in un momento cruciale per entrambi i player. Anthropic, che sviluppa Claude sulla base di constitutional AI, intende proteggere la propria proprietà intellettuale ed evitare che i suoi asset vengano utilizzati come trampolino di lancio per GPT-5. OpenAI, da parte sua, continua lo sviluppo in autonomia e rafforza la propria offerta open-weight per compensare la perdita di accesso. Queste dinamiche mostrano un mercato AI in rapida maturazione, dove i confini tra collaborazione e competizione sono sempre più sfumati. Le accuse reciproche e le barriere API sono solo manifestazioni di una battaglia più ampia per la supremazia algoritmica.

Il caso Recall ha evidenziato le difficoltà tecniche nel costruire filtri sensibili affidabili. OpenAI ha utilizzato pattern matching per escludere numeri di carte di credito etichettati come “checkout”, ma il sistema falliva in presenza di dati non etichettati. L’uso di espressioni regolari come \b(?:\d{4}[- ]?){3}\d{4}\b ha permesso il rilevamento formale di alcuni formati, ma ha ignorato password salvate in Notepad per mancanza di contesto. L’evoluzione prevede l’adozione di modelli NLP contestuali per distinguere contenuti sensibili con maggiore accuratezza, riducendo i falsi negativi del 30%. Un feedback loop continuo e dataset aggiornati renderanno questi filtri progressivamente più efficaci. La stessa attenzione si riflette nella progettazione di GPT-5, dove i guardrail AI sono integrati fin dal training e la robustezza avversariale è misurata prima del rilascio.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.