AGGIORNAMENTO META SBLOCCA AUTONOMAMENTE I PROFILI DI MATRICE DIGITALE

La democrazia viene presentata come il sistema più vicino alla tutela delle libertà individuali, l’argine naturale contro l’arbitrio, la repressione e il controllo totale attribuiti ai regimi autoritari. È la formula che abbiamo imparato a memoria: noi, come società occidentali, difendiamo la libertà di stampa, il diritto di cronaca, il pluralismo dell’informazione. Loro – la Cina, la Russia, gli altri paesi indicati come autoritari – reprimono il dissenso, censurano, epurano. Questa distinzione, però, regge sempre meno quando lo spazio democratico viene trasferito all’interno di piattaforme private governate da algoritmi opachi, procedure automatiche e risposte che somigliano più a un verbale di polizia che a un confronto civile. Anche la democrazia, esattamente come i regimi autoritari che dichiara di combattere, sviluppa meccanismi di sopravvivenza. Ha bisogno di gestire la propria immagine pubblica e di neutralizzare tutto ciò che viene percepito come destabilizzante. Nella dimensione digitale questo non avviene più con la censura dichiarata, ma attraverso una combinazione di metodo mafioso e tecnica di epurazione, in cui il dissenso viene prima delegittimato e poi cancellato. Il caso che coinvolge Matrice Digitale e Livio Varriale, giornalista iscritto all’albo da vent’anni, direttore responsabile di una testata registrata presso un Tribunale italiano, autore di anni di inchieste sulla sicurezza informatica, sul crimine informatico e sulla guerra cibernetica, è un esempio concreto di questa dinamica.

Cosa leggere

Il canale Youtube, la cronaca sul dark web e la cancellazione

Per anni il canale YouTube di Livio Varriale è stato usato per raccontare il funzionamento reale del dark web. Non con toni sensazionalistici, ma con ricostruzioni documentate, spiegando le dinamiche dei marketplace illegali, mostrando l’infrastruttura, illustrando i rischi veri per gli utenti comuni. Matrice Digitale ha mostrato il dark web smontando le leggende metropolitane e togliendo patina romantica a miti come “armi in vendita a ogni angolo”, “killer a pagamento in due clic”, “droghe consegnate a domicilio senza conseguenze”. È stato spiegato, con materiale autentico, cosa esiste davvero e cosa invece è marketing criminale e truffa. Questo tipo di lavoro giornalistico è, per definizione, cronaca. È informazione d’interesse pubblico. È prevenzione del danno, perché mette in guardia i cittadini sui rischi tecnici, psicologici e legali.

Per anni, quella stessa piattaforma ha consentito questi contenuti. Li ha perfino ritenuti compatibili con le proprie regole. Poi il quadro è cambiato.

Dopo un lungo periodo di apparente calma, il canale è stato chiuso. Poi riaperto. Poi di nuovo sottoposto a restrizioni. Fino a un punto preciso: la segnalazione di un video sul traffico di armi nel dark web (“Armi in vendita nel Dark Web. The Armory”). Un contenuto che era già stato oggetto di revisione, rieducazione, contestualizzazione e che rientrava chiaramente nel diritto di cronaca.

Ed è qui che entra un passaggio determinante, non solo tecnico ma politico: l’interazione diretta con l’assistenza della piattaforma.

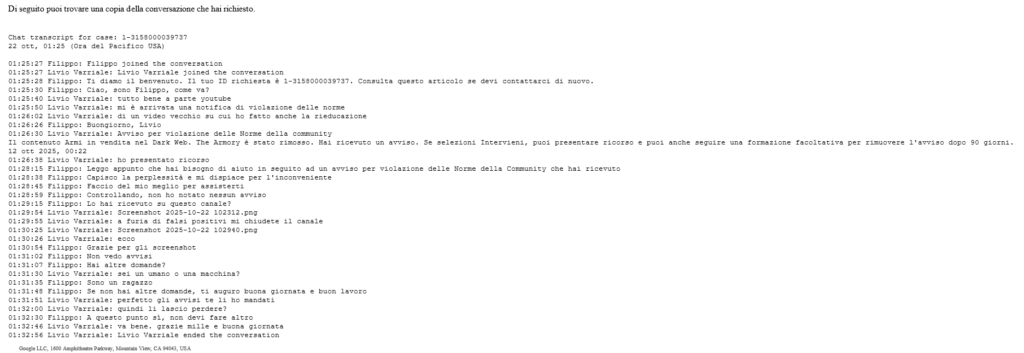

La conversazione con l’assistenza e la negazione della realtà

Il 12 ottobre 2025 arriva un avviso per “violazione delle Norme della community”. YouTube comunica che il contenuto relativo al traffico di armi nel dark web è stato rimosso. L’account riceve un avviso formale e viene segnalata la possibilità di ricorso. Il messaggio ufficiale è chiaro: “Hai ricevuto un avviso. Se selezioni Intervieni, puoi presentare ricorso e puoi anche seguire una formazione facoltativa per rimuovere l’avviso dopo 90 giorni.” Questo è il linguaggio tipico delle piattaforme quando trattano un creator come uno studente indisciplinato da “rieducare”, non come un giornalista che esercita diritto di cronaca.

A quel punto il giornalista presenta ricorso. E qui inizia la parte che, da sola, racconta il livello di affidabilità del sistema di moderazione.

Nella chat di assistenza, l’operatore si presenta come “Filippo”. Il sistema apre il ticket, assegna un ID (“Ti diamo il benvenuto. Il tuo ID richiesta è 1-3158000039737”), e la conversazione procede così. Il giornalista spiega subito il punto: “tutto bene a parte YouTube”, e poi “mi è arrivata una notifica di violazione delle norme”, spiegando che riguarda “un video vecchio su cui ho fatto anche la rieducazione”. Fornisce il testo dell’avviso: il contenuto “Armi in vendita nel Dark Web. The Armory” è stato rimosso, è arrivato l’avviso, ha fatto ricorso.

L’operatore risponde in modo standardizzato: “Capisco la perplessità e mi dispiace per l’inconveniente. Faccio del mio meglio per assisterti.” È il lessico tipico di un customer care che deve contenere l’attrito emotivo senza entrare nel merito. Poi, però, arriva la frase chiave: “Controllando, non ho notato nessun avviso… Non vedo avvisi.” Alla domanda “Lo hai ricevuto su questo canale?”, la piattaforma chiede prove. Il giornalista fornisce screenshot (“Screenshot 2025-10-22 102312.png”, “Screenshot 2025-10-22 102940.png”) e commenta: “a furia di falsi positivi mi chiudete il canale”.

L’operatore ringrazia per gli screenshot, ma continua ad affermare che “non vede avvisi”. E a quel punto sostiene che non c’è nulla da fare: “A questo punto sì, non devi fare altro.”

Qui si vede la prima frattura sistemica. Da una parte c’è una notifica formale di violazione, con conseguenze potenzialmente pesanti fino alla chiusura definitiva del canale. Dall’altra parte c’è l’assistenza ufficiale della piattaforma che dice di “non vedere avvisi” e quindi di “non dover fare altro”. Quando il giornalista chiede apertamente: “sei un umano o una macchina?”, l’operatore risponde: “Sono un ragazzo”. Quindi l’assistenza rivendica di essere umana, e dunque credibile.

Il risultato pratico è devastante. La piattaforma prima notifica una violazione e apre formalmente un contenzioso sul canale. Poi, davanti alle prove di quella violazione, nega di vedere la violazione. Dice al giornalista che può stare tranquillo. E questa rassicurazione, che ha valore perché viene detta da un essere umano che si qualifica come umano, diventa la base psicologica per non intervenire ulteriormente. Il giornalista chiede: “quindi li lascio perdere?”. Risposta: “A questo punto sì, non devi fare altro.”

Questa conversazione è la prova diretta di una tecnica di disinnesco. Una piattaforma che ti sta formalmente classificando come problematico, che ti sta attribuendo una violazione delle norme, che già ha usato violazioni simili per chiuderti il canale, ti dice in chat che “non c’è problema”. È esattamente il comportamento del caporeparto che ti mette sotto procedura disciplinare e nello stesso momento ti dice: “Tranquillo, non è niente”. È un metodo omertoso, che si avvicina pericolosamente al metodo mafioso. Ti espone a una sanzione esistenziale – la chiusura del canale e della voce pubblica – ma ti dissuade dal difenderti davvero.

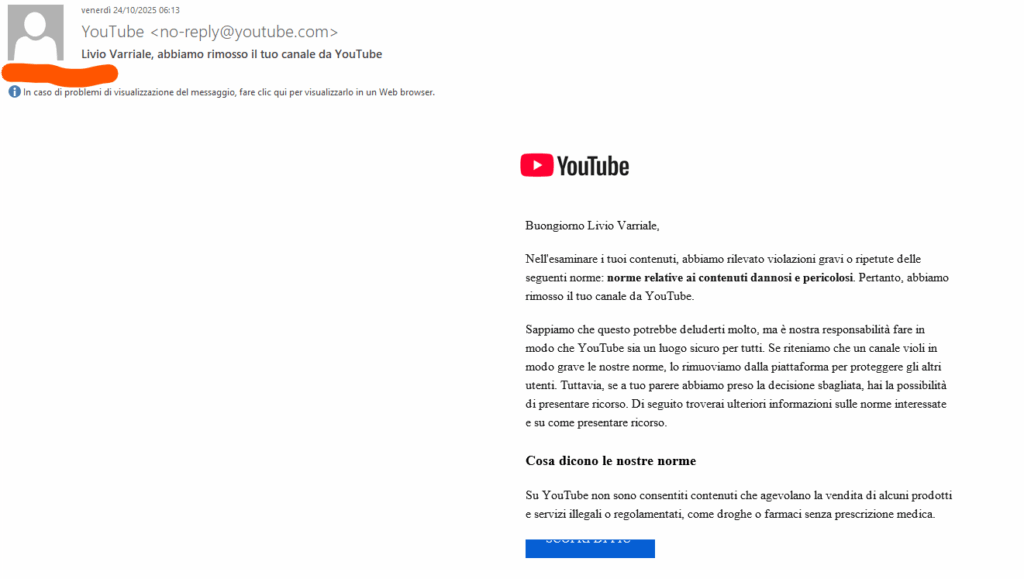

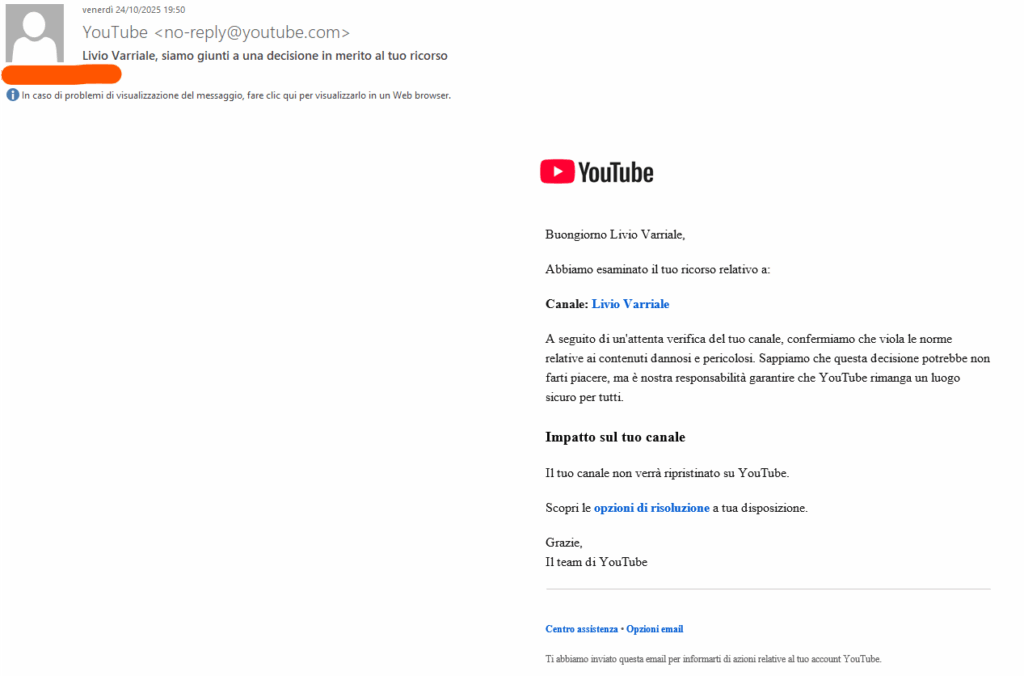

Il ricorso “valutato in due giorni” e respinto in tre minuti

Dopo la chat con l’operatore, avviene il passaggio successivo. Il 24 ottobre arriva una mail da YouTube che annuncia formalmente la chiusura del canale. La comunicazione dice che è possibile fare ricorso e che il ricorso verrà esaminato “dopo un’attenta verifica”, con un tempo indicato di almeno due giorni. Il giornalista prepara il ricorso spiegando di essere un professionista, spiegando che ha esercitato il diritto di cronaca, spiegando che non ha promosso traffici illegali ma li ha documentati criticamente, smontandone anche molte narrative tossiche.

Dopo appena tre minuti arriva la risposta da YouTube: ricorso respinto, chiusura confermata.

Questa sequenza rende evidente che la piattaforma mente al giornalista in due momenti distinti e strategici. Prima mente dicendo che non ci sono avvisi, quando l’avviso c’è e comporta conseguenze. Poi mente dicendo che l’appello sarà valutato da esseri umani con attenzione, quando in realtà la decisione viene presa in tempi incompatibili con qualunque valutazione reale di ore o giorni. Qui l’algoritmo non è più uno strumento di supporto: è il vero decisore finale, con la cortesia umana ridotta a teatro di copertura.

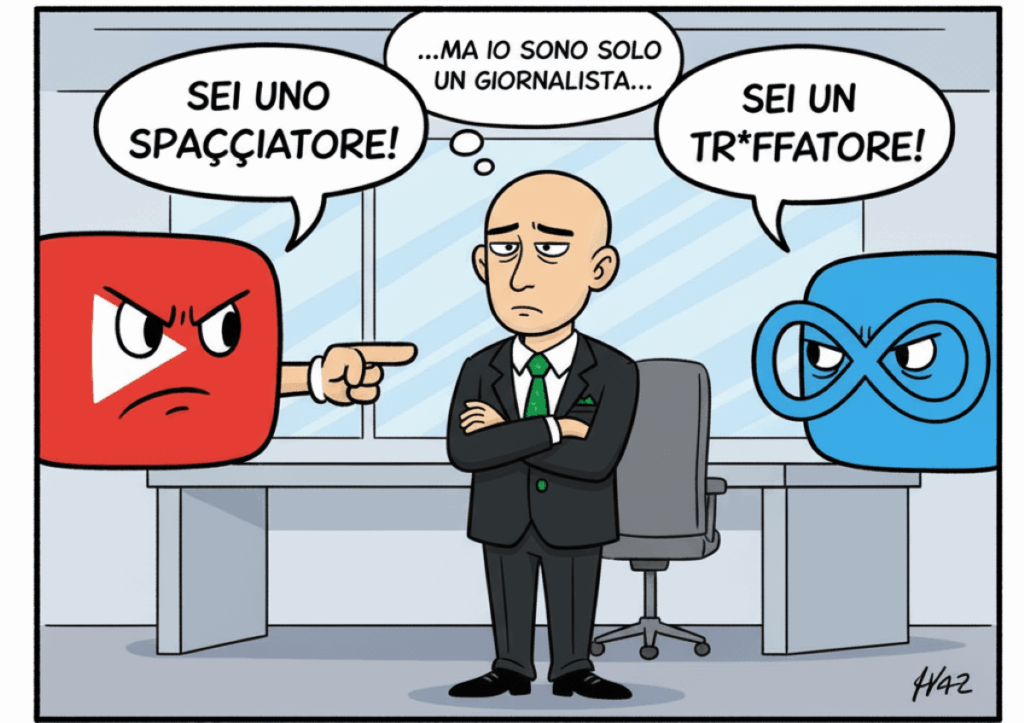

L’accusa infamante: trasformare il cronista nel criminale

La conseguenza della chiusura non è solo tecnica. Non è solo “hai perso un canale YouTube”. È identitaria e reputazionale. Secondo la piattaforma, i contenuti avrebbero “facilitato la vendita di farmaci su internet”, “droghe”, “sostanze illegali”. In pratica, un giornalista che documenta e denuncia le dinamiche del mercato nero viene ridefinito come qualcuno che quel mercato lo alimenta. È un salto logico che serve a giustificare la rimozione totale. Perché se il giornalista è raccontato come spacciatore digitale, la sua eliminazione passa come necessaria tutela della comunità. Questa è la stessa logica del regime che definisce “sabotatore” chi fa opposizione. Non si dice “stiamo censurando un giornalista scomodo”. Si dice “stiamo impedendo attività illegali”. L’effetto però è identico alla censura: la voce scompare e la sua reputazione viene bruciata mentre scompare. Il pubblico vede sparire il canale e allo stesso tempo interiorizza l’idea che quel canale fosse pericoloso.

Questo è il cortocircuito: il giornalista a capo della testata di informazione che ha prodotto più contenuti in Italia sulla sicurezza informatica, sul crimine informatico e sulla guerra cibernetica negli ultimi dieci anni viene trasformato nel problema da cui proteggere gli utenti.

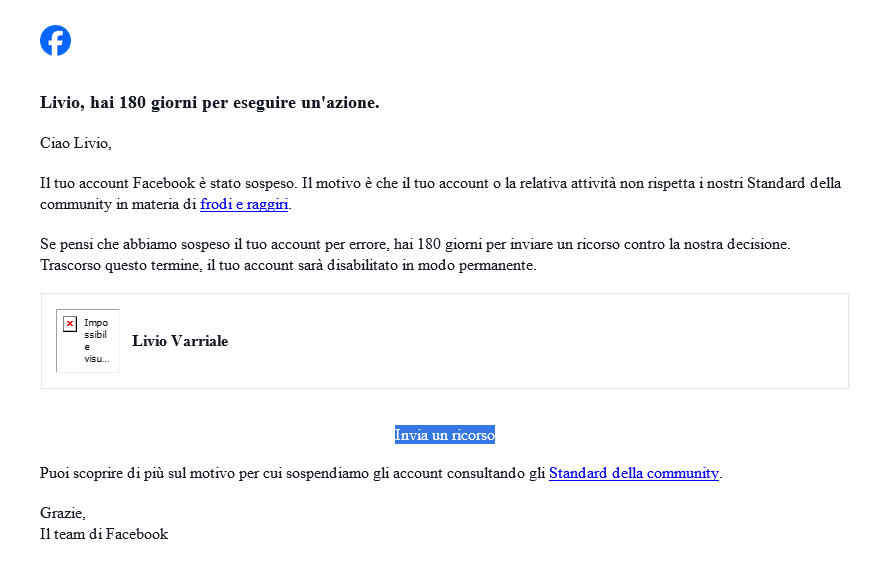

La rimozione su Meta e il salto di qualità verso l’epurazione

E YouTube non è l’unico livello. Sull’ecosistema Meta – Facebook, Instagram, Threads – si è verificata una dinamica ancora più violenta. Il primo ottobre, l’account personale del giornalista viene rimosso. Non parliamo solo della pagina della testata, ma anche di profili collegati al business manager e all’identità professionale.

L’accusa: “attività di truffe e raggiri a danno degli utenti”.

Questa è un’etichetta ancora più tossica, ancora più distruttiva, perché non solo elimina la voce pubblica ma equipara il giornalista agli stessi truffatori che la sua testata ha denunciato per anni, anche collaborando a livello informativo con istituzioni come la Polizia Postale e segnalando siti fraudolenti oggetto di indagini internazionali, arresti, operazioni con Europol e Interpol.

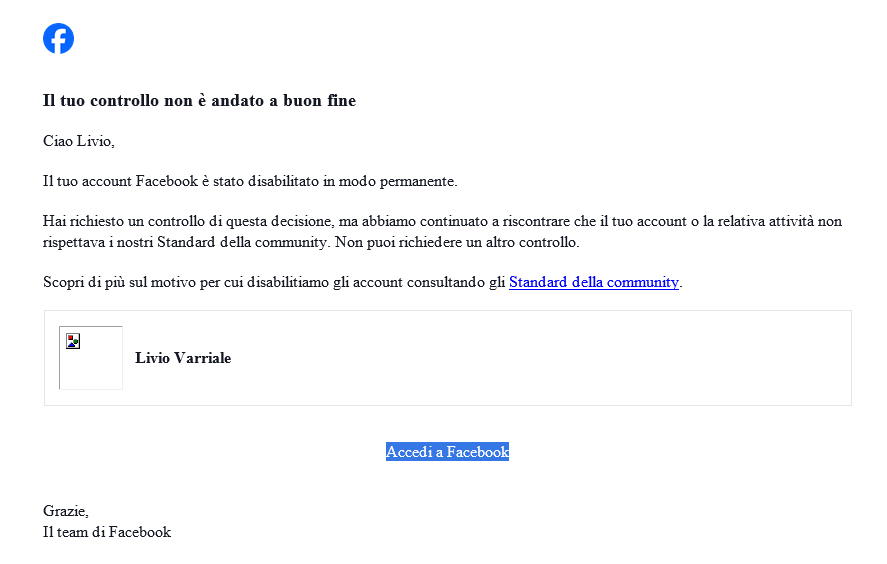

Meta concede il ricorso, ma tiene l’account giù. E mentre il ricorso è pendente, questa volta dopo una settimana, ribadisce che l’account sarebbe collegato a truffe e raggiri. È un doppio vincolo mortale: non solo vieni cancellato, ma rimani marchiato come truffatore anche mentre chiedi di essere ascoltato. Questa dinamica ha un nome preciso: epurazione. È l’equivalente digitale del prelievo e della sparizione.

Il giornalista viene tolto dallo spazio pubblico, come se fosse un soggetto socialmente pericoloso. E questa pratica viene giustificata come misura di protezione degli utenti.

Qui non siamo più nella moderazione preventiva, ma nella riscrittura della biografia pubblica. La piattaforma prende un giornalista che si occupa professionalmente di crimine informatico e lo riscrive come criminale. Lo isola, ne spezza il canale di comunicazione, gli sottrae il pubblico costruito nel tempo e lo sostituisce nel racconto con altri soggetti che rimangono online con contenuti simili o apertamente speculativi. È un vantaggio competitivo concesso a chi rimane in piedi.

La democrazia consegnata agli algoritmi privati

A questo punto la domanda non è più tecnica. È politica e costituzionale.

Che tipo di democrazia è una democrazia in cui la libertà di stampa può essere annullata da un algoritmo commerciale?

Se il principale spazio in cui la gente si informa è privato, e se quel privato può chiudere la voce di un giornalista in tre minuti attribuendogli l’etichetta di spacciatore o truffatore, dove finisce lo Stato? Dove si esercita, nella pratica, la tutela del diritto di cronaca che la Costituzione dice di garantire?

Nel racconto pubblico occidentale, la Cina viene chiamata “regime autoritario”, la Russia viene dipinta come “dittatura”, e le loro piattaforme digitali sono descritte come strumenti del potere politico. Ma qui siamo davanti a qualcosa che non è nemmeno mediato dalla politica: è censura privata delegata ad algoritmi. È molto più silenziosa e molto più difficile da contestare, perché avviene fuori dal circuito della giustizia ordinaria. Non esiste un tribunale a cui rivolgersi entro 24 ore per chiedere se sia lecito che una piattaforma etichetti un giornalista come truffatore. La piattaforma è tribunale, esecutore e archivio storico della tua reputazione. C’è un altro elemento che rende questa dinamica ancora più inquietante. In Cina, negli ultimi anni, l’uso degli algoritmi nella giustizia ordinaria è stato descritto anche come correttivo del rigore repressivo: strumenti digitali che intervengono per suggerire pene meno estreme in ambiti in cui è in gioco persino la vita delle persone.

Qui, nel modello occidentale che si definisce libero, l’algoritmo non riduce la violenza punitiva. La automatizza. Ti cancella e basta. Ti marchia e basta. Ti priva della possibilità di difenderti e nello stesso tempo racconta pubblicamente che l’ha fatto per proteggere gli altri da te.

È una forma di morte civile digitale. Una morte che colpisce l’individuo ma anche la pluralità dell’informazione. Perché se una voce che racconta il cybercrime sparisce, ciò che rimane nello spazio pubblico è solo la versione addomesticata, compatibile, format-friendly, commerciabile. È il mercato – non la legge, non la Costituzione – a decidere chi parla e chi no.

La prova di maturità dello Stato

Resta l’ultima domanda, che è anche l’unica possibile via d’uscita democratica. Uno Stato che si definisce sovrano può tollerare che la voce di un giornalista venga spenta da un algoritmo commerciale, su segnalazione potenzialmente strumentale di concorrenti? Può tollerare che la principale fonte italiana di cronaca sulla sicurezza informatica, sul crimine informatico e sulla guerra cibernetica venga rimossa dalle piattaforme con accuse che la equiparano a uno spacciatore o a un truffatore seriale? Perché se lo tollera, allora quello Stato non è più garante della libertà di stampa. È spettatore. E uno Stato che resta spettatore davanti alla cancellazione di una voce giornalistica, soprattutto in un settore strategico come la sicurezza informatica nazionale, di fatto accetta che il controllo dell’informazione cruciale sia esercitato da soggetti privati esterni alla giurisdizione democratica. Questa è la linea rossa. Se davanti a questo tipo di rimozione e di diffamazione industriale non arriva alcuna risposta Istituzionale, allora bisogna ammettere una cosa senza più ipocrisia: tra democrazia e regime la differenza operativa non è poi così grande. Cambiano i codici, cambiano le parole, cambiano i toni. Ma alla fine la logica è identica. Se non hai santi in paradiso, si muore. E oggi si muore digitalmente, senza nemmeno la dignità di un processo

proprio come hanno sentenziato negli anni le dittature cinesi e russe, proprio come ha sentenziato la Mafia.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.