Matrice Digitale aveva intercettato due fronti sensibili prima che diventassero oggetto di clamore nazionale: la questione legata ad AWS e le sue implicazioni sulla sovranità digitale italiana, e il dossier fantasma sul Garante per la protezione dei dati personali, circolato in modo carsico tra redazioni e studi legali. In entrambi i casi, una testata indipendente ha toccato prima degli altri un’area istituzionale delicata e, poco dopo, ha visto restringersi gli spazi di visibilità sui social e sulle piattaforme video. La coincidenza tra cronaca anticipata e limitazione algoritmica ha reso evidente un problema più profondo: la fragilità del pluralismo digitale in un ecosistema mediatico sempre più condizionato da rapporti istituzionali e da logiche di reputazione.

Cosa leggere

Il caso AWS e la sovranità digitale

Sul fronte AWS la vicenda andava oltre la semplice cronaca tecnologica. Riguardava un fornitore straniero che lavora a stretto contatto con la pubblica amministrazione italiana, in un momento in cui il tema della sicurezza dei dati nazionali era cruciale. Matrice Digitale aveva raccontato la presenza di criticità infrastrutturali e di un sistema dipendente da logiche di outsourcing che mettono in discussione la reale autonomia tecnologica del Paese. Portare alla luce una simile anomalia significava incrinare il racconto rassicurante sulla cybersicurezza nazionale, costruito attorno all’immagine di un apparato “sotto controllo” e ben finanziato. Ma quando una voce indipendente mostra una crepa nel sistema, la comunicazione istituzionale spesso non risponde nel merito: lascia che siano le piattaforme a rimuovere la dissonanza. Da non sottovalutare anche le altre notizie scomode fornite sull’ACN quando c’è stato l’avvicendamento tra Baldoni e Frattasi e la scoperta in esclusiva del vizietto della nostra cibersicurezza di avere parte della struttura informatica su server USA.

Il dossier fantasma e il ruolo del Garante Privacy

La stessa dinamica si è ripetuta con il dossier fantasma sul Garante Privacy. Matrice Digitale aveva rivelato che non si trattava di un documento di gossip, ma di un testo che conteneva nomi, relazioni e passaggi sensibili per la credibilità dell’Autorità. La testata aveva anche evidenziato che il tema non si esauriva nella sanzione a una trasmissione televisiva, ma investiva i rapporti strutturali tra Autorità e sistema editoriale nel periodo in cui dominava il modello “pay or consent”. Quando il caso è arrivato in televisione, la narrazione è stata trasformata in uno scontro politico, tagliando fuori proprio la parte che mostrava le connessioni più delicate. Di conseguenza, la testata che aveva pubblicato per prima la notizia è stata marginalizzata, mentre i media generalisti hanno ripreso la vicenda adattandola alle proprie esigenze di audience e visibilità.

La coincidenza tra pubblicazioni scomode e restrizioni algoritmiche

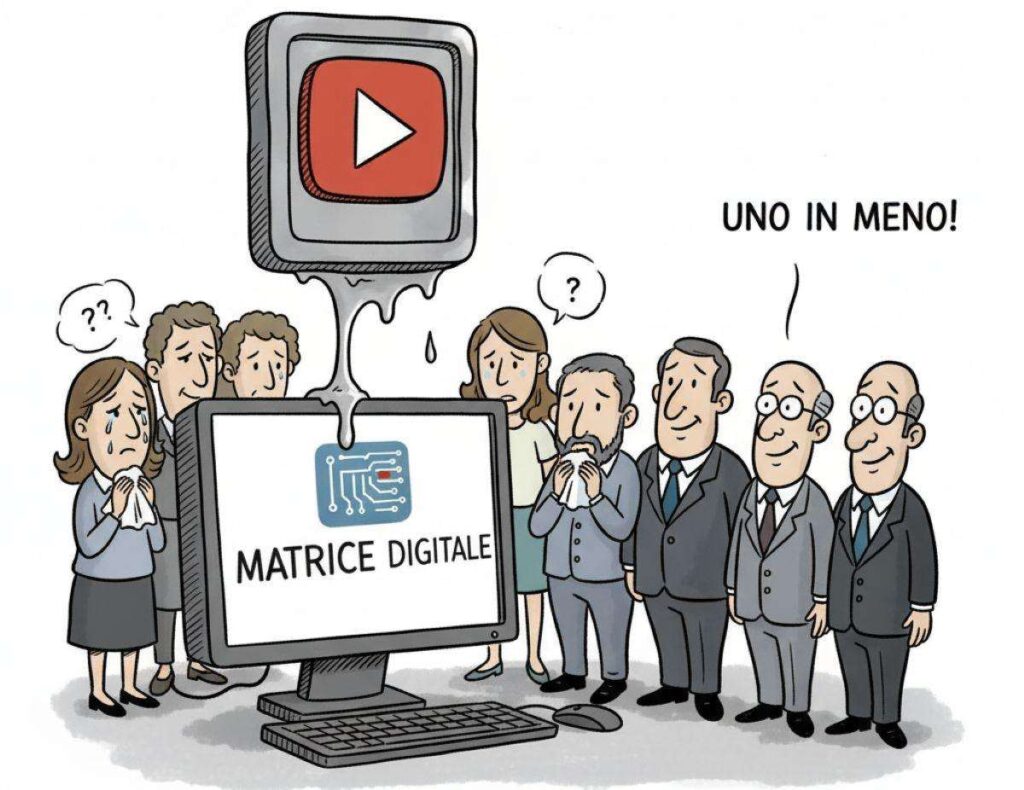

L’analisi della sequenza temporale rende evidente un punto: ogni volta che Matrice Digitale ha pubblicato un contenuto scomodo, è seguita una restrizione di visibilità. Prima la ricostruzione di un’anomalia sul fronte cloud, poi il richiamo al dossier quando nessuno ancora lo citava, infine la chiusura dei canali social e YouTube con motivazioni generiche e non attinenti al diritto di cronaca.

Questo schema descrive la condizione tipica di una voce che anticipa il mainstream: nel momento in cui la stessa notizia viene ripresa da soggetti più forti, la fonte originaria diventa ingombrante. E la soluzione più rapida per chi detiene potere comunicativo è silenziare la voce che è arrivata prima, lasciando intatta la versione più utile alla narrativa dominante che diventa appetibile anche con strumentalizzazioni politiche utili al dibattito, ma non sempre alla risoluzione dei problemi.

Il ban come strumento di gestione delle crisi comunicative

Il ban di una voce scomoda può diventare un’operazione di convenienza per chi gestisce una crisi istituzionale o reputazionale. Se una testata indipendente mostra per prima un conflitto, la reazione più semplice è depotenziare la fonte originaria. Non serve che l’istituzione si esponga direttamente: basta che un consulente di comunicazione o un referente esterno utilizzi i meccanismi di segnalazione delle piattaforme. Così la narrazione rimane coerente e chi detiene il controllo dell’informazione può ridefinire la storia senza contraddittorio. In questo contesto, l’episodio di Matrice Digitale diventa un caso emblematico di interferenza indiretta nella libertà di stampa: non un atto esplicito di censura, ma un insieme di azioni coordinate che portano allo stesso risultato, adombrando la voce che aveva anticipato l’informazione, portando avanti influencer menestrelli spesso muniti di tesserino dell’Ordine.

La filiera invisibile della censura digitale

Oltre al piano istituzionale, esiste una filiera invisibile che agisce nel silenzio. Le piattaforme non hanno interesse a chiudere un canale giornalistico produttivo, ma subiscono l’effetto di segnalazioni multiple e coordinate. Dentro questa vulnerabilità operano tre attori principali: competitor editoriali, agenzie di personal branding e professionisti della reputazione. Un soggetto che si sente danneggiato da un’inchiesta può scegliere di non rispondere pubblicamente e di attivare una campagna di segnalazioni, sfruttando parole chiave che gli algoritmi considerano ad alto rischio. È una censura senza firma, che cancella i contenuti legittimi semplicemente saturando i sistemi di moderazione automatica.

Agenzie di reputation e concorrenza sleale

Le agenzie di reputation management non si limitano al monitoraggio dei commenti o ad eventuali anomalie di reputazione sul brand da cui sono ingaggiate, ma conducono vere operazioni di rimozione mirata. Se il committente è un ente pubblico che vuole evitare esposizione, l’agenzia agisce come filtro: individua i post più condivisi e li segnala finché non vengono rimossi. Se il cliente è un soggetto privato legato a contratti pubblici o temi di privacy, la strategia resta identica. I competitor editoriali, invece, hanno un obiettivo ancora più diretto: eliminare la visibilità della fonte che ha pubblicato per prima. In questo modo, la paternità della notizia viene riscritta, e l’autore originale sparisce dal racconto. È accaduto con contenuti sul dark web e inchieste su infrastrutture sensibili, rimossi senza violazioni effettive, segno di un’azione concertata da soggetti con accesso privilegiato ai sistemi di segnalazione.

Il precedente Ferragni

Un esempio emblematico riguarda il video di Matrice Digitale intitolato “La Ferragni del dark web”, rimosso senza possibilità di contraddittorio. Il contenuto, privo di elementi illeciti, affrontava un tema di interesse pubblico con taglio documentale. Ma la presenza di un nome mediaticamente sensibile è bastata per attivare la risposta automatica della piattaforma. È la prova che il potere simbolico di un brand può orientare l’algoritmo più della legalità o dell’interesse collettivo.

Oppure dell’attività di qualche censore pagato per monitorare il brand sulla rete?

La contro-narrazione come bersaglio

L’obiettivo principale di questa strategia non è la fake news, ma la contro-narrazione: un’informazione verificata che mette in discussione il discorso dominante. Poiché non può essere smentita, viene neutralizzata attraverso la visibilità, rendendola invisibile all’algoritmo e quindi al pubblico.

Il vantaggio per chi agisce è totale: non c’è tracciabilità, non c’è contraddittorio, non c’è un giudice terzo. La piattaforma emette una formula impersonale – “violazione delle norme” – e il giornalista resta senza strumenti di difesa. Così chi controlla la reputazione ottiene l’obiettivo: mantenere pulita la narrazione pubblica e silenziare la voce anticipatrice. Le piattaforme social operano secondo un principio economico: vendere attenzione e visibilità. In questo modello, la brand safety diventa priorità assoluta e trasforma la moderazione in uno strumento di gestione reputazionale più che di tutela giuridica. Una segnalazione anonima o un errore algoritmico bastano per bloccare un canale scomodo, soprattutto se i contenuti mettono in discussione istituzioni, sponsor o narrazioni ufficiali.

È in questa intersezione che nasce la figura del cyberbully di piattaforma, un attore che agisce all’interno delle regole per colpire un concorrente mediatico e manipolare il campo dell’informazione.

Un sistema che premia chi segnala

Oggi esistono almeno tre categorie di soggetti che traggono vantaggio dal silenziamento delle voci indipendenti: chi è stato oggetto dell’inchiesta e vuole sottrarsi al dibattito; chi compete nello stesso segmento informativo e vuole cancellare il primato temporale altrui; chi lavora sulla reputazione e sa che una segnalazione ben orchestrata è più efficace di qualsiasi replica. Finché le piattaforme continueranno a trattare tutte le segnalazioni in modo indifferenziato, senza percorsi di verifica riservati alle testate registrate, questa forma di censura privata resterà un metodo efficace, rapido e soprattutto conveniente per chi ha interesse a controllare la visibilità del giornalismo indipendente.

Gli interessi dietro la censura algoritmica

La domanda cruciale è: chi beneficia del silenzio imposto a una voce di contro-narrazione? Ne beneficiano le istituzioni che evitano il confronto pubblico, gli editori conformisti che non rischiano di perdere rapporti economici e gli influencer allineati che guadagnano visibilità nell’assenza di concorrenti. A perdere è il giornalismo d’inchiesta, cioè la parte dell’informazione che protegge il cittadino dai poteri forti. Nel settore della cybersecurity, dove la velocità delle minacce supera quella delle risposte ufficiali, silenziare una voce indipendente significa indebolire l’intera catena di difesa sociale.

L’effetto non è solo comunicativo ma industriale: si cancellano investimenti, competenze e pubblico costruiti in anni di lavoro, sostituiti da contenuti neutri e monetizzabili.

A prova di quanto si sostiene, c’è un post pubblicato su LinkedIn dal prof. Andrea Lisi che ha raccontato la censura su YouTube partendo dai 700 video censurati ad ONG citando il caso di Matrice Digitale che da sola ne ha persi circa 1000.

Nonostante tra i contatti di Andrea Lisi ci siano giornalisti ed operatori Istituzionali, l’analisi delle interazioni ha restituito un dato interessante sulla partecipazione professionale alle tematiche espresse nel post scomode della censura di fonti scomode all’occidente e ad un giornalista-redazione che nulla ha a che vedere il conflitto israelopalestinese.

| Settore professionale | Numero | % sul totale | Descrizione sintetica |

|---|---|---|---|

| Giuridico / Privacy / DPO / Compliance | 21 | 40% | Avvocati, consulenti legali, DPO, esperti GDPR e diritto digitale |

| ICT / Cybersecurity / Data / AI | 10 | 19% | Esperti di sicurezza informatica, data protection, AI, ICT manager |

| Accademico / Docente / Ricerca | 5 | 10% | Docenti universitari, ricercatori, formatori |

| Manageriale / Corporate / Consulenza | 6 | 12% | Manager, consulenti aziendali, account e principal partner |

| Pubblica Amministrazione / Enti pubblici | 4 | 8% | Funzionari PA, Dipartimenti Finanze, Regione, Comune |

| Comunicazione / Media / Marketing / Creatività | 4 | 8% | Professionisti in marketing, comunicazione digitale, scrittura |

| Altro (studenti, professionisti vari) | 2 | 3% | Studenti, professionisti di settori non classificabili |

L’assenza di giornalisti e influencer:

“uno in meno” oppure, se esiste la buonafede, “meglio non esporsi potremmo essere i primi”

Il diritto di cronaca nell’infrastruttura privata

La chiusura di un profilo giornalistico rappresenta una distruzione di capitale informativo. Le piattaforme, vendendo fiducia agli inserzionisti, dovrebbero garantire continuità e responsabilità, ma offrono invece opacità e arbitrio. Gli strumenti di ricorso sono inefficaci e i criteri di moderazione restano segreti. L’assenza di tutele procedurali per le testate registrate mina la stessa idea di sovranità informativa nazionale, poiché decisioni con impatto pubblico vengono prese da società estere senza controllo democratico. In questo scenario, la resilienza della filiera informativa non può esistere se il nodo centrale – la piattaforma – non risponde alle regole del diritto. Ogni chiusura non motivata diventa un atto di censura economica che danneggia imprese editoriali e inserzionisti allo stesso tempo.

Una democrazia senza voci scomode

L’esclusione di Matrice Digitale priva il pubblico di inchieste tecniche su sicurezza informatica e cybercrime, elementi fondamentali per comprendere la realtà digitale. Una piattaforma che sopprime questi contenuti si trasforma in palinsesto promozionale, dove il cittadino non è più partecipante, ma target commerciale. La posta in gioco è più ampia di un singolo canale: riguarda il diritto di cronaca all’interno di infrastrutture private. Servono regole certe, canali di ricorso indipendenti e tracciabilità delle segnalazioni, così che la libertà d’informazione non sia subordinata alla logica del profitto. In assenza di tali garanzie, la democrazia digitale si riduce a una vetrina regolata da algoritmi, dove il dissenso viene filtrato in nome della sicurezza, e la sicurezza coincide con la conformità commerciale. Una piattaforma che espelle la cronaca e accoglie la pubblicità non è neutrale; un Paese che accetta questa condizione cede sovranità informativa.

Ne deriva un doppio standard: tolleranza per gli abusi commerciali, ma rigore assoluto verso la critica strutturata.

La vera domanda non è quanto convenga restare in silenzio, ma se si possa ancora chiamare democrazia un sistema in cui l’algoritmo decide chi resta e la segnalazione decide chi scompare che sia un individuo, un’impresa o una testata giornalistica.

Iscriviti alla Newsletter

Non perdere le analisi settimanali: Entra nella Matrice Digitale.

Matrice Digitale partecipa al Programma Affiliazione Amazon EU. In qualità di Affiliato Amazon, ricevo un guadagno dagli acquisti idonei. Questo non influenza i prezzi per te.