Robotica

AI Generativa imita il movimento umano per la robotica

Tempo di lettura: 2 minuti. Scopri come la nuova AI generativa sviluppata da un team internazionale imita il movimento umano, migliorando l’adattabilità e la stabilità in robotica.

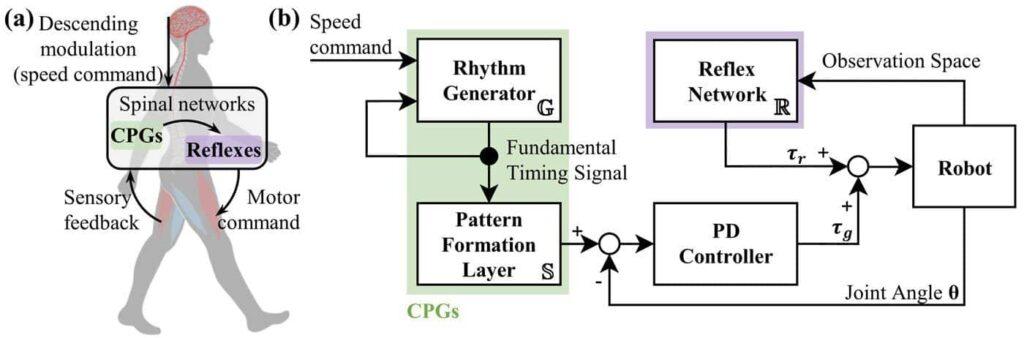

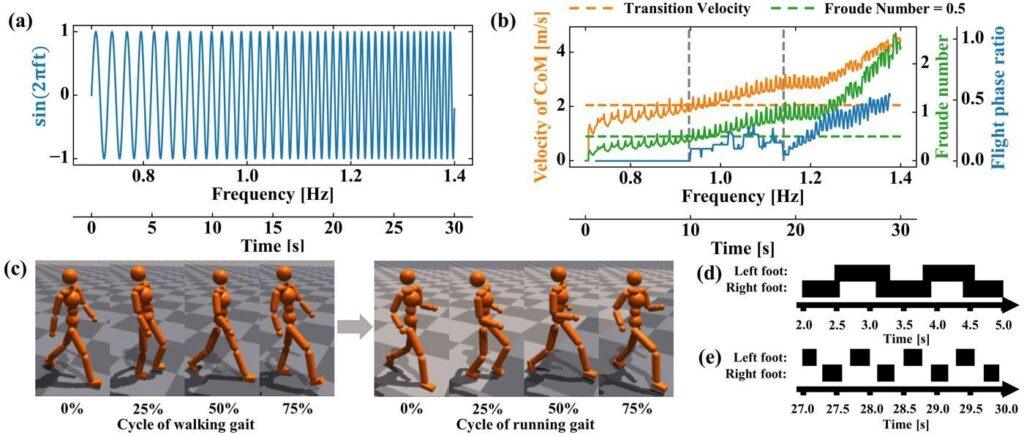

Un gruppo internazionale di ricercatori ha sviluppato un nuovo metodo per imitare il movimento umano nella robotica, combinando generatori di pattern centrali (CPG) e apprendimento profondo per rinforzo (DRL). Questa innovazione non solo replica i movimenti di camminata e corsa, ma genera anche movimenti per frequenze di dati assenti, permette transizioni fluide tra camminata e corsa, e si adatta a superfici instabili.

Dettagli della Ricerca

Pubblicati sulla rivista IEEE Robotics and Automation Letters il 15 aprile 2024, i dettagli di questa ricerca segnano un progresso significativo nella robotica e nell’intelligenza artificiale. Camminare e correre sono attività complesse che coinvolgono ridondanze biologiche, consentendo agli esseri umani di adattarsi agli ambienti variabili. Riprodurre questi movimenti in modo realistico nei robot ha presentato notevoli sfide, soprattutto quando i modelli devono operare in ambienti sconosciuti o complessi.

Innovazioni tecnologiche

I CPG sono circuiti neurali situati nel midollo spinale che, come un direttore d’orchestra biologico, generano schemi ritmici di attività muscolare. In natura, un circuito riflesso lavora in tandem con i CPG per fornire feedback adeguato, permettendo agli animali di regolare la loro velocità e il movimento in base al terreno.

L’approccio dei ricercatori ha combinato l’apprendimento per imitazione, dove un robot apprende imitando i dati di movimento umano, con l’apprendimento profondo per rinforzo, che utilizza reti neurali profonde per gestire compiti più complessi e apprendere direttamente da input sensoriali grezzi. Questo metodo ha superato molti limiti degli approcci esistenti, grazie all’uso di una rete neurale riflessa che supporta i CPG, aumentando significativamente la stabilità e l’adattabilità del movimento generato.

Applicazioni e implicazioni future

Questa ricerca non solo stabilisce nuovi standard per il movimento robotico umanoide, ma apre anche la strada a future applicazioni in vari settori, dalla robotica assistiva all’industria manifatturiera, e potenzialmente alla ricerca e soccorso in ambienti pericolosi o inaccessibili. La capacità di adattarsi e reagire a situazioni dinamiche in tempo reale rappresenta un salto significativo verso robot più autonomi e funzionali.

Il metodo AI-CPG rappresenta un passo avanti significativo nello sviluppo di tecnologie AI generative per il controllo dei robot, con potenziali applicazioni che attraversano diverse industrie. Questo progresso non solo migliora la nostra comprensione dei sistemi biologici complessi ma anche come questi principi possono essere emulati in sistemi artificiali per realizzare robot più efficienti e adattabili.

Robotica

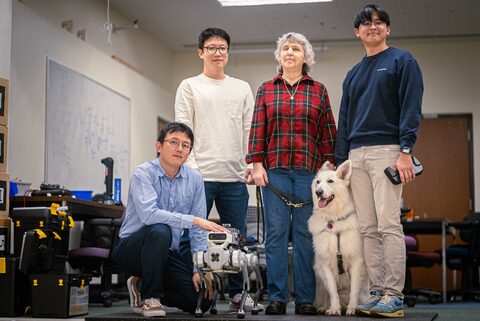

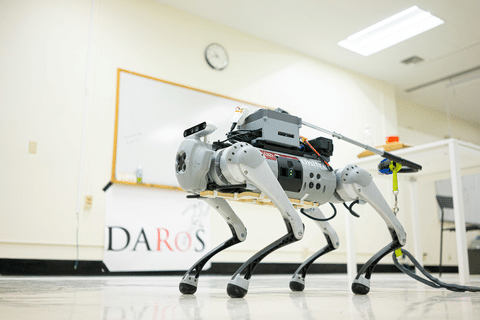

Robot guida addestrati dai cani per non vedenti

Tempo di lettura: 2 minuti. Ricercatori di UMass Amherst sviluppano robot guida per non vedenti, equilibrando autonomia del robot e controllo umano

Un team di ricercatori dell’Università del Massachusetts Amherst ha ricevuto il Best Paper Award alla conferenza CHI 2024 per il loro studio su come sviluppare robot guida per persone non vedenti: il team, guidato da Donghyun Kim, ha condotto interviste e sessioni di osservazione con utenti di cani guida e addestratori per identificare le caratteristiche necessarie per rendere i robot guida efficaci e accettati dagli utenti finali.

Limiti dei cani guida e potenziale dei robot

I cani guida offrono una grande autonomia ai loro conduttori, ma solo una piccola parte delle persone non vedenti può permettersene uno, a causa dei costi elevati di addestramento ($40.000) e altre limitazioni come allergie e incapacità fisiche di prendersi cura di un cane. I robot guida potrebbero colmare questa lacuna, ma solo se progettati con le giuste caratteristiche.

Ricerche precedenti e nuovi approcci

Mentre sono stati sviluppati vari robot guida negli ultimi 40 anni, nessuno è stato adottato su larga scala dagli utenti finali. Kim e il suo team hanno cercato di capire prima come le persone utilizzano i cani guida e quali tecnologie attendono, prima di sviluppare i robot stessi. Le loro ricerche hanno rivelato che gli utenti non vedono i cani guida come un sistema di navigazione globale, ma piuttosto come un aiuto per evitare ostacoli locali, con il conduttore che controlla il percorso generale.

Equilibrio tra autonomia del robot e controllo umano

Un tema emerso dalle interviste è stato il delicato equilibrio tra l’autonomia del robot e il controllo umano. I ricercatori hanno scoperto che i conduttori si sentono insicuri se il robot è completamente passivo o completamente autonomo. Invece, una collaborazione tra il robot e il conduttore sembra essere l’approccio preferito.

Caratteristiche chiave per i robot guida

Alcune delle caratteristiche chiave identificate per i robot guida includono una durata della batteria di almeno due ore, necessaria per i pendolari, più orientamenti delle telecamere per evitare ostacoli aerei, sensori audio per rilevare pericoli in arrivo da zone nascoste e la capacità di comprendere comandi come “marciapiede” per indicare di seguire la strada.

Importanza della ricerca e prospettive future

Il lavoro di Kim e del suo team non solo offre linee guida per lo sviluppo di robot guida, ma punta anche a ispirare altri ricercatori nel campo della robotica e dell’interazione uomo-robot. La loro speranza è che, anche se i robot guida non saranno disponibili nel breve termine, questa ricerca possa accelerare la loro realizzazione e implementazione.

Robotica

Il tatto dei Robot potrebbe essere veloce quanto quello umano

Tempo di lettura: < 1 minuto. Un sistema tattile artificiale sviluppato dall’Università di Uppsala permette ai robot di percepire il tatto con la rapidità degli umani.

Un sistema artificiale sviluppato dai ricercatori dell’Università di Uppsala potrebbe permettere ai robot di percepire il tatto con la stessa rapidità degli esseri umani. Questo sistema, ispirato dalla neuroscienza, utilizza impulsi elettrici per processare le informazioni tattili dinamiche nello stesso modo del sistema nervoso umano.

Componenti del sistema tattile artificiale

Il sistema ha tre componenti principali:

- Pelle Elettronica (e-skin): Dotata di sensori che possono rilevare la pressione al tatto.

- Neuroni Artificiali: Convertono i segnali tattili analogici in impulsi elettrici.

- Processore: Elabora i segnali e identifica l’oggetto.

I test hanno coinvolto 22 oggetti diversi per la presa e 16 superfici diverse per il tocco.

Applicazioni e prospettive future

- Protesi: Una mano protesica con questa tecnologia potrebbe sentirsi come parte del corpo del portatore.

- Interazioni Umano-Robot: Le interazioni diventerebbero più sicure e naturali grazie al feedback tattile.

- Monitoraggio Medico: Potrebbe essere utilizzata per monitorare disfunzioni motorie causate da malattie come il Parkinson e l’Alzheimer, o per aiutare i pazienti a recuperare funzionalità perse dopo un ictus.

Obiettivi futuri

I ricercatori stanno anche esplorando la possibilità di sviluppare il sistema in modo che possa percepire dolore e calore, nonché distinguere i materiali, ad esempio legno o metallo. Un altro obiettivo è produrre pelle artificiale per un intero robot, con un numero sufficiente di recettori per permettere una destrezza simile a quella della mano umana.

Finanziamenti e collaborazioni

La ricerca è stata finanziata dal programma di ricerca e innovazione Horizon 2020 dell’Unione Europea, il Consiglio delle Ricerche Svedese, la Fondazione Svedese per la Ricerca Strategica, il programma di ricerca eSSENCE (Svezia), AI4Research (Università di Uppsala), la Fondazione Margaretha af Ugglas e l’infrastruttura nazionale per il supercalcolo in Svezia presso UPPMAX.

Robotica

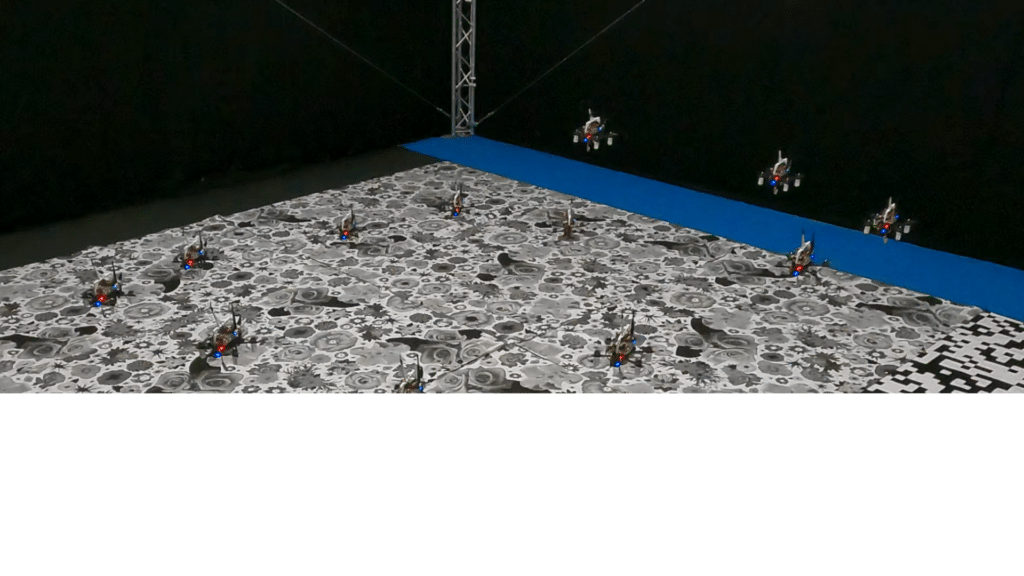

Robot autonomi con cervelli AI animali

Tempo di lettura: 2 minuti. Scopri come l’intelligenza artificiale ispirata al cervello animale sta rivoluzionando i droni autonomi, rendendoli più veloci ed efficienti dal punto di vista energetico.

Un team di ricercatori della Delft University of Technology ha sviluppato un drone che vola autonomamente utilizzando l’elaborazione delle immagini neuromorfica e il controllo basato sul funzionamento dei cervelli animali. I cervelli animali usano meno dati ed energia rispetto alle attuali reti neurali profonde che funzionano su GPU. I processori neuromorfici sono quindi molto adatti per piccoli droni poiché non necessitano di hardware e batterie pesanti. I risultati sono straordinari: durante il volo, la rete neurale profonda del drone elabora i dati fino a 64 volte più velocemente e consuma tre volte meno energia rispetto a una GPU.

Apprendimento dai cervelli animali: reti neurali a Spike

L’intelligenza artificiale può fornire ai robot autonomi l’intelligenza necessaria per le applicazioni nel mondo reale. Tuttavia, l’attuale AI si basa su reti neurali profonde che richiedono una notevole potenza di calcolo. I processori per eseguire le reti neurali profonde (GPU) consumano molta energia, un problema per piccoli robot come i droni volanti che possono trasportare risorse limitate.

I cervelli animali elaborano le informazioni in modo diverso dalle reti neurali su GPU. I neuroni biologici elaborano le informazioni in modo asincrono, comunicando principalmente tramite impulsi elettrici chiamati spike. L’invio di tali spike consuma energia, quindi il cervello minimizza gli spike, portando a un’elaborazione sparsa. I processori neuromorfici permettono di eseguire reti neurali a spike, risultando molto più veloci ed efficienti dal punto di vista energetico.

Prima Visione e controllo neuromorfici di un Drone Volante

In un articolo pubblicato su Science Robotics, i ricercatori dimostrano per la prima volta un drone che utilizza la visione e il controllo neuromorfici per il volo autonomo. Hanno sviluppato una rete neurale a spike che elabora i segnali da una fotocamera neuromorfica e fornisce comandi di controllo per determinare la posizione e la spinta del drone. La rete è stata implementata su un processore neuromorfico, il chip di ricerca neuromorfico Loihi di Intel, a bordo di un drone.

Con la sua visione e controllo neuromorfici, il drone può volare a diverse velocità in condizioni di luce variabili, da scure a luminose. Può persino volare con luci tremolanti, che fanno inviare alla fotocamera neuromorfica un gran numero di segnali non correlati al movimento.

Applicazioni future dell’AI Neuromorfica per Piccoli Robot

“L’AI neuromorfica permetterà a tutti i robot autonomi di essere più intelligenti,” afferma Guido de Croon, professore di droni bio-ispirati. “Ma è un fattore abilitante assoluto per piccoli robot autonomi.” All’Università di Tecnologia di Delft, i ricercatori lavorano su piccoli droni autonomi utilizzabili per applicazioni che vanno dal monitoraggio delle colture nelle serre al controllo delle scorte nei magazzini. I vantaggi dei piccoli droni includono sicurezza, capacità di navigare in ambienti stretti e costi ridotti, permettendo di essere dispiegati in sciami. La realizzazione di queste applicazioni dipenderà dall’ulteriore miniaturizzazione dell’hardware neuromorfico e dall’espansione delle capacità verso compiti più complessi come la navigazione.

Robotica1 settimana fa

Robotica1 settimana faCome controllare dei Robot morbidi ? MIT ha un’idea geniale

Inchieste6 giorni fa

Inchieste6 giorni faMelinda lascia la Bill Gates Foundation e ritira 12,5 Miliardi di Dollari

L'Altra Bolla7 giorni fa

L'Altra Bolla7 giorni faDiscord celebra il nono compleanno con aggiornamenti e Giveaway

Inchieste6 giorni fa

Inchieste6 giorni faTerrore in Campania: dati sanitari di SynLab nel dark web

Economia1 settimana fa

Economia1 settimana faBan in Germania per alcuni prodotti Motorola e Lenovo

Smartphone4 giorni fa

Smartphone4 giorni faSamsung Galaxy S25 Ultra: Quattro fotocamere in Arrivo

Smartphone1 settimana fa

Smartphone1 settimana faSamsung Galaxy S25 Ultra avrà una Fotocamera rispetto all’S24

Economia1 settimana fa

Economia1 settimana faCy4Gate: accordo da un milione con Innovery